⚠️ 以下所有内容总结都来自于 大语言模型的能力,如有错误,仅供参考,谨慎使用

🔴 请注意:千万不要用于严肃的学术场景,只能用于论文阅读前的初筛!

💗 如果您觉得我们的项目对您有帮助 ChatPaperFree ,还请您给我们一些鼓励!⭐️ HuggingFace免费体验

2024-12-17 更新

RAID-Database: human Responses to Affine Image Distortions

Authors:Paula Daudén-Oliver, David Agost-Beltran, Emilio Sansano-Sansano, Valero Laparra, Jesús Malo, Marina Martínez-Garcia

Image quality databases are used to train models for predicting subjective human perception. However, most existing databases focus on distortions commonly found in digital media and not in natural conditions. Affine transformations are particularly relevant to study, as they are among the most commonly encountered by human observers in everyday life. This Data Descriptor presents a set of human responses to suprathreshold affine image transforms (rotation, translation, scaling) and Gaussian noise as convenient reference to compare with previously existing image quality databases. The responses were measured using well established psychophysics: the Maximum Likelihood Difference Scaling method. The set contains responses to 864 distorted images. The experiments involved 105 observers and more than 20000 comparisons of quadruples of images. The quality of the dataset is ensured because (a) it reproduces the classical Pi'eron’s law, (b) it reproduces classical absolute detection thresholds, and (c) it is consistent with conventional image quality databases but improves them according to Group-MAD experiments.

图像质量数据库被用于训练预测主观人类感知的模型。然而,大多数现有的数据库侧重于数字媒体中常见的失真,而不是自然条件下的失真。仿射变换尤其值得关注,因为它们是日常生活中人类观察者最常遇到的。本数据描述符呈现了一组人类对超阈值仿射图像变换(旋转、平移、缩放)和高斯噪声的反应,作为与现有图像质量数据库进行比较的便捷参考。这些反应是通过已经建立的心理学测量方法——最大似然差异缩放法来测量的。该数据集包含对864张失真图像的反应。实验涉及105名观察者和超过2万张图像的四重比较。数据集的质量得到了保证,因为它(a)再现了经典的Piérons定律,(b)再现了经典的绝对检测阈值,(c)与常规图像质量数据库一致,但根据Group-MAD实验进行了改进。

论文及项目相关链接

Summary

本文介绍了用于训练预测主观人类感知模型的新图像质量数据库。不同于现有的大多数关注数字媒体畸变的数据库,该数据库主要研究现实生活中人类观察者最常遇到的仿射变换。该数据描述符展示了一组对超阈值仿射图像变换(旋转、平移、缩放)的响应数据,以及高斯噪声作为与现有图像质量数据库比较的参考。采用最大似差尺度法测量响应数据。数据集包含对864张失真图像的反应,实验涉及105名观察者和超过2万张图像的四重比较。数据集质量得到了保证,因为它符合经典的心理物理学定律,并与其他图像质量数据库一致但有所改进。

Key Takeaways

- 图像质量数据库主要用于训练预测主观人类感知的模型。

- 现有数据库大多关注数字媒体的常见畸变,而非自然条件下的畸变。

- 仿射变换在现实生活中是最常被人类观察者遇到的,本文重点研究其对图像质量的影响。

- 数据集包含对超阈值仿射图像变换(旋转、平移、缩放)的响应数据。

- 使用最大似差尺度法测量响应数据。

- 数据集质量得到了保证,符合经典的心理物理学定律。

点击展开 Cool Papers 详细信息

Q: 这篇论文试图解决什么问题?

A: 这篇论文试图解决的问题是如何创建一个包含人类对仿射图像变换(包括旋转、平移、缩放)和高斯噪声响应的图像质量数据库(RAID-Database),以补充现有的图像质量数据库。这些数据库主要用于训练模型,预测主观的人类感知,但大多数现有数据库集中于数字媒体中常见的失真,而不是自然条件下的失真。论文强调仿射变换在日常生活中非常普遍,因此对于研究人类视觉感知和改进图像处理模型具有重要意义。

具体来说,论文试图解决以下几个问题:

现有数据库的局限性:大多数现有的图像质量数据库集中于数字环境中的失真,而不是自然条件下的失真,如视角变化、物体运动和光照变化等。

仿射变换的重要性:仿射变换(旋转、平移、缩放)和光照变化是人们在日常生活中经常遇到的图像变换类型,但这些在现有数据库中未被充分考虑。

人类视觉感知模型的评估:通过创建一个新的数据库,可以评估和改进现有的图像质量评估模型,使其更好地与人类视觉感知一致。

数据集的质量验证:通过使用最大似然差异量表方法(MLDS)来测量响应,并验证数据集的质量,确保其与经典Piéron定律、绝对检测阈值和传统图像质量数据库的一致性。

数据集的实用性和兼容性:提供一个新的数据集,它不仅与现有的图像质量数据库兼容,而且通过Group-MAD实验表明,该数据库在描述人类行为方面更为准确。

综上所述,这篇论文旨在通过创建和验证一个新的图像质量数据库,来改进图像处理领域中人类视觉感知模型的设计和评估。

Q: 有哪些相关研究?

A: 根据这篇论文的内容,以下是一些与研究相关的工作和文献:

图像质量评估的数据库:

- TID2013数据库:这是一个广泛使用的图像质量数据库,包含了25个参考图像(24个自然图像和1个合成图像),24种失真类型和每种失真5个等级。这个数据库被用来与本文提出的RAID-Database进行比较和对比。

图像质量评估的方法:

- Mean Opinion Score (MOS):这是一种传统的图像质量评估方法,用于测量平均观察者对失真图像相对于未失真图像的评价。

心理物理学方法:

- Maximum Likelihood Difference Scaling (MLDS)方法:这是一种在经典心理物理学中使用的方法,用于获得对失真图像的响应。Maloney和Yang描述了这种方法,它通过比较同一参考图像和失类型别的刺激,生成每个刺激的响应曲线。

图像变换和人类视觉感知:

- 论文提到了Piéron定律,这是一个描述人类视觉敏感度的经典定律,与反应时间和难度相关。

- 论文还提到了绝对检测阈值的再生产,这是评估实验数据质量的一个方面。

图像质量评估的比较和验证:

- Group MAD (Maximum Differentiation) competition:这是一种新的方法,用于比较客观图像质量模型。这种方法通过识别图像对来比较两组值,其中一种方法预测几乎相同的响应,而另一种预测最大的感知差异。

图像质量评估的深度特征:

- Zhang等人的工作:他们研究了深度特征作为感知度量的有效性,这与图像质量评估相关。

其他数据库和工具:

- Kadid-10k数据库:这是一个大规模的人为失真图像质量评估数据库。

- PIPAL数据库:这是一个用于感知图像恢复的大规模图像质量评估数据集。

- TID2008数据库:这是一个用于评估全参考视觉质量评估度量的数据库。

这些相关研究和数据库为本文提出的RAID-Database提供了背景和对比,同时也展示了图像质量评估领域的研究进展和挑战。通过这些相关工作,本文旨在提供一个更符合自然条件下人类视觉感知的图像质量评估工具。

Q: 论文如何解决这个问题?

A: 论文通过以下几个步骤解决提出的问题:

创建新的数据库(RAID-Database):

- 收集了一组人类对仿射图像变换(旋转、平移、缩放)和高斯噪声的响应,以建立一个新的图像质量数据库。这个数据库包含了864张失真图像,涉及105名观察者和超过20000次图像比较。

使用心理物理学方法(MLDS):

- 使用最大似然差异量表方法(MLDS)来获得对失真图像的响应。这种方法比较同一参考图像和失真类型的刺激,生成每个刺激的响应曲线,并提供内部噪声的sigma值,用于调整每个曲线。

实验设计和数据收集:

- 设计实验以收集人类对失真图像的响应数据。实验涉及105名不同年龄的观察者,在控制条件下进行,以确保数据的一致性和可靠性。每个观察者在实验中对图像对进行比较,选择他们认为感知差异最大的一对。

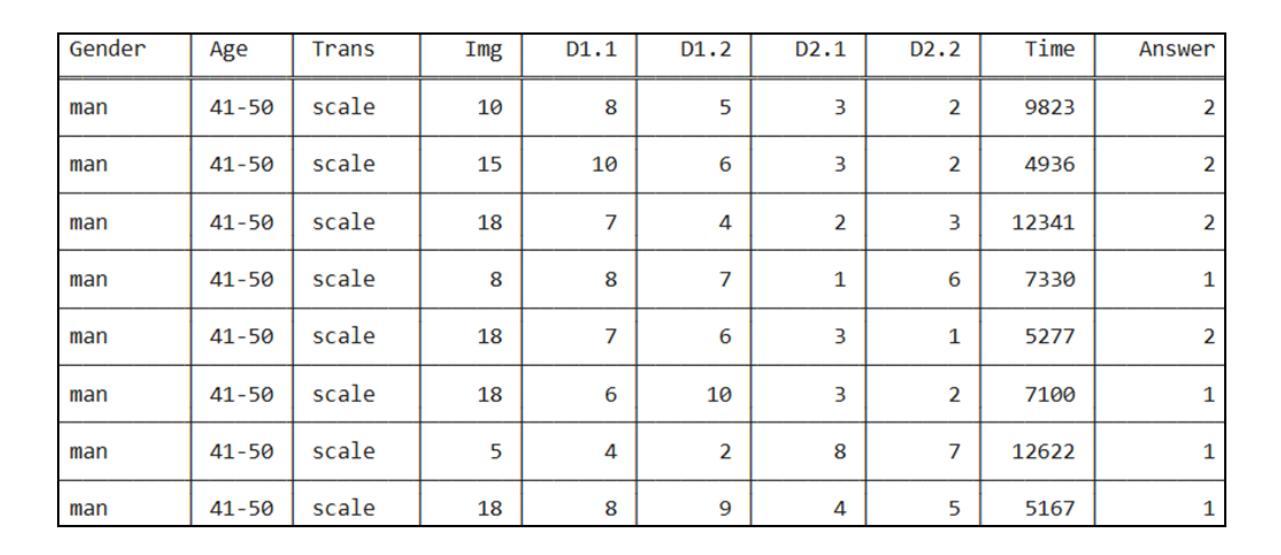

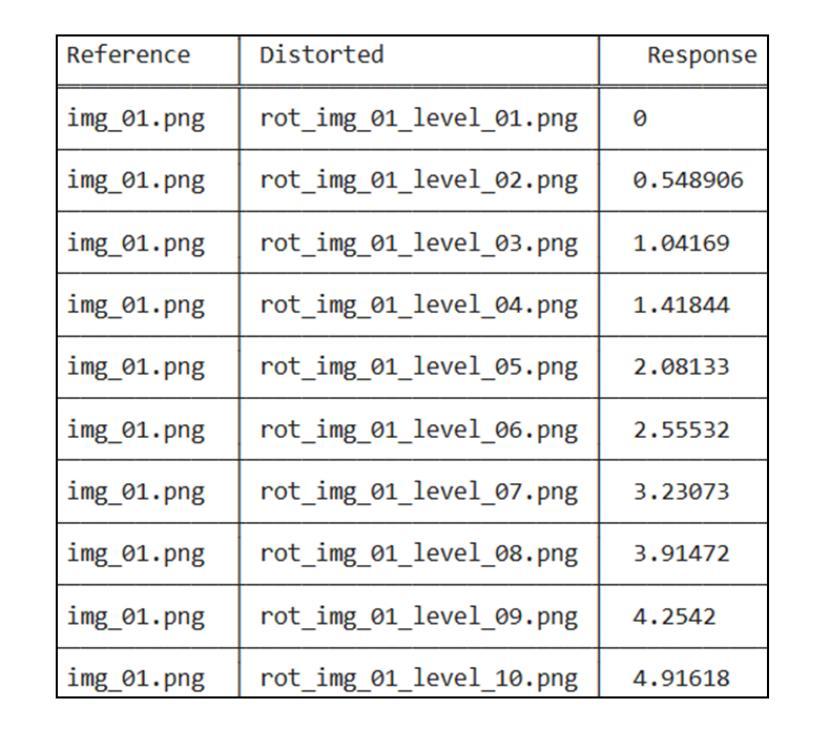

数据记录和处理:

- 提供了原始数据和MLDS处理后的数据。原始数据包括观察者的决策和特征,而MLDS数据则包含了标准化的响应曲线,使得不同曲线之间可以进行比较。

技术验证:

- 通过三种方式验证数据集的质量:

- 验证数据是否符合Piéron定律。

- 验证数据是否符合经典的绝对检测阈值。

- 验证数据与现有图像质量数据库(如TID2013)的一致性,并通过Group-MAD实验展示新数据库在描述人类行为方面的优越性。

- 通过三种方式验证数据集的质量:

代码和数据的公开:

- 提供了用于读取数据库和计算MLDS响应的Python代码,使得其他研究者可以利用和适应这些资源进行他们自己的研究。

对比和讨论:

- 将新数据库与现有的图像质量数据库进行对比,讨论其优势和潜在的应用,尤其是在描述人类对自然条件下失真的感知方面。

通过这些步骤,论文不仅提出了一个新的数据库来补充现有的图像质量评估工具,而且还通过严格的实验设计和技术分析来确保新数据库的质量和有效性。这为图像处理和人类视觉感知研究领域提供了一个宝贵的资源。

Q: 论文做了哪些实验?

A: 根据论文内容,作者进行了一系列实验来收集和验证人类对仿射图像变换(旋转、平移、缩放)和高斯噪声的响应。以下是实验的具体步骤和细节:

图像选择和失真应用:

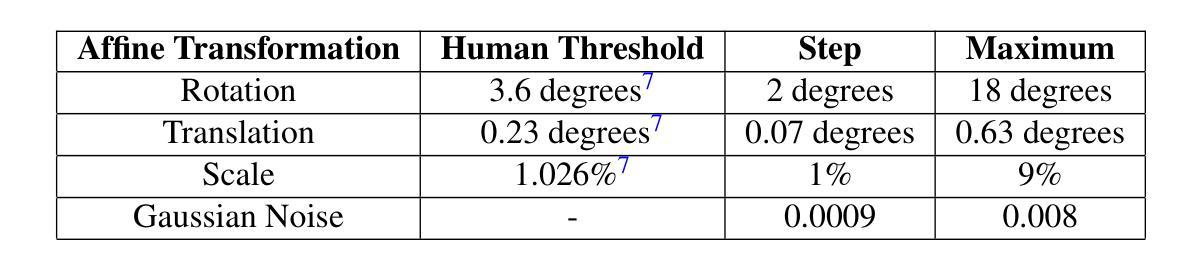

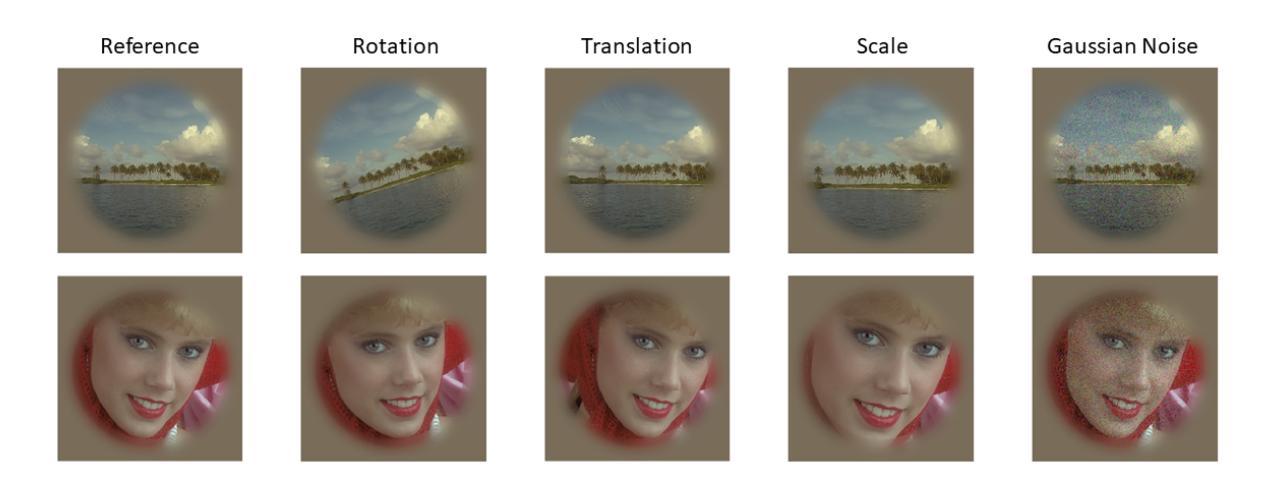

- 从Kodak Lossless True Color Image Suite中选取24张参考图像,并应用四种类型的失真:旋转、平移、缩放和高斯噪声。每种失真都有九个递增的级别,除了参考图像本身。

实验设计:

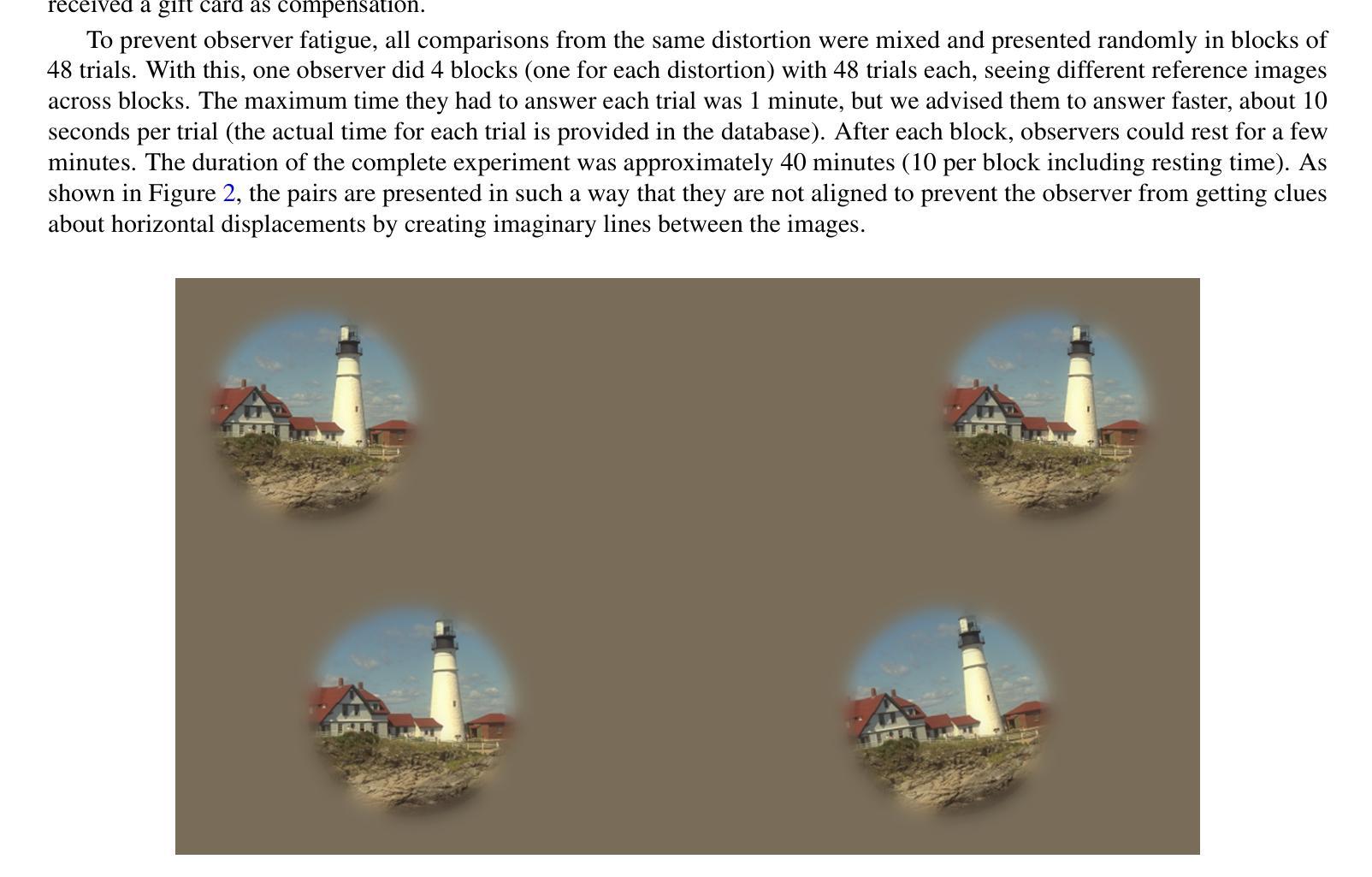

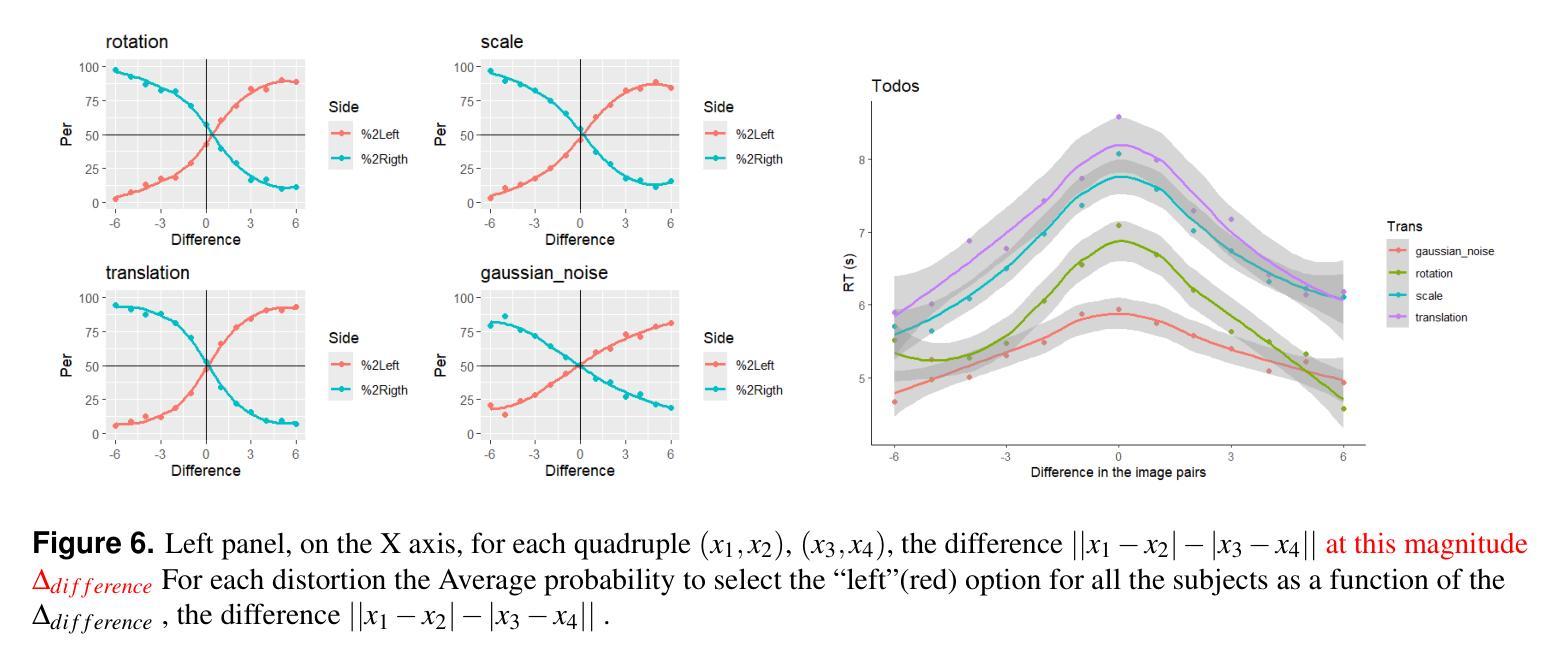

- 使用最大似然差异量表方法(MLDS)进行实验。在每次试验中,同时展示四张图像:两张在左边,两张在右边。观察者需要选择哪对(左边或右边)具有最大的感知差异。

参与者:

- 共有105名年龄在18至60岁之间的观察者参与实验。他们在实验室中进行测量,并在控制条件下(低外部照明和屏幕80厘米的距离)进行。

实验流程:

- 每个观察者完成了96个不同的曲线(每种失真和参考图像的组合),每个曲线包含210个四元组的比较。每个四元组由两对图像组成,一对图像的失真程度较低,另一对图像的失真程度较高。

- 为了避免组合过于明显,使得实验过于简单,规定任意两个图像之间的失真差异(记作∆difference)不能超过7。

- 每个观察者完成每个失真的48次试验,随机混合呈现,以防止观察者疲劳。

数据收集:

- 收集了每个观察者对每对图像的响应,包括选择哪对图像具有更大的感知差异,以及响应时间(以毫秒为单位)。

数据分析:

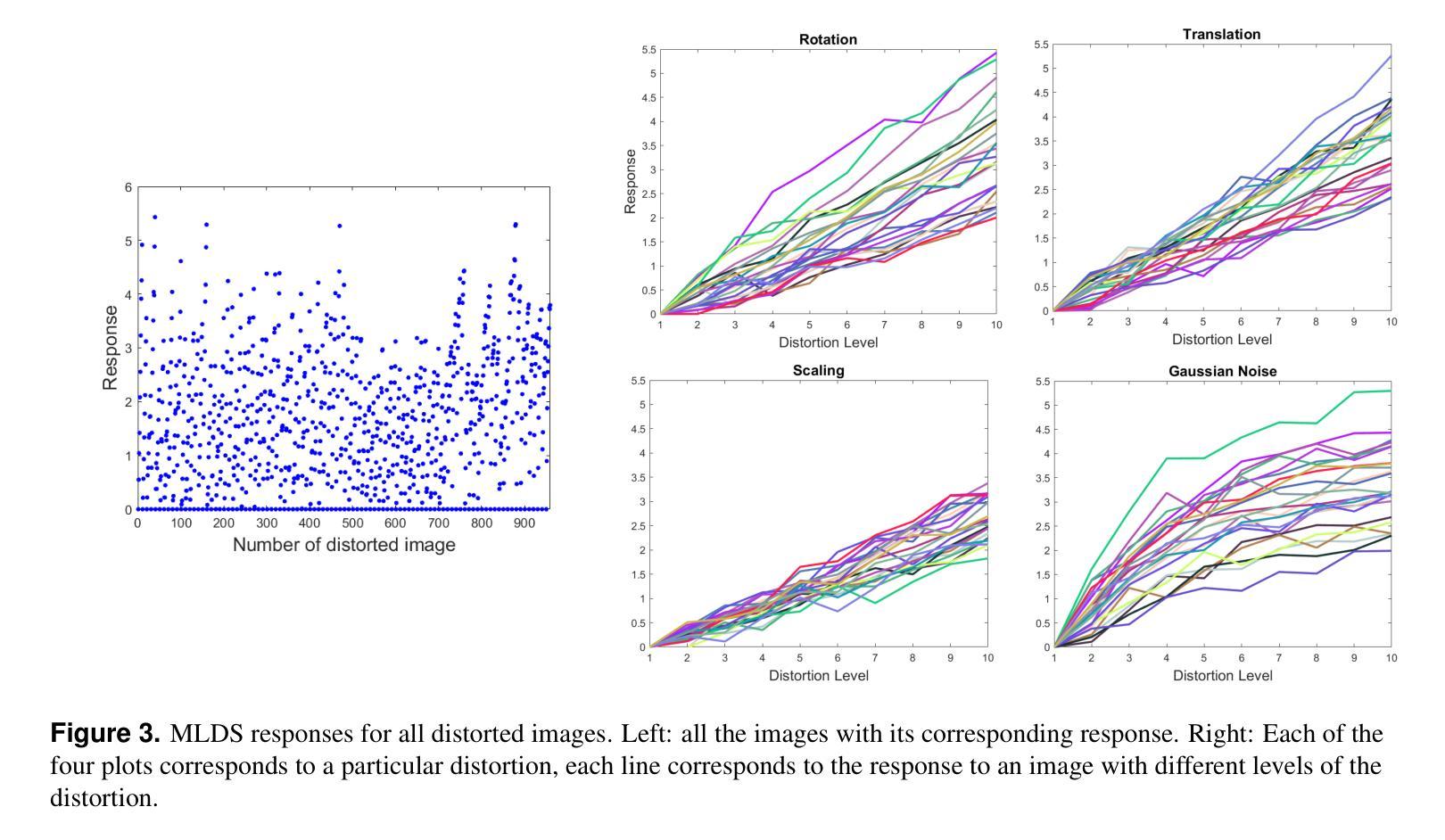

- 使用MLDS方法处理原始数据,以获得失真图像的响应曲线。这些曲线表示了不同失真水平下的人类感知响应,并进行了标准化处理,使得标准差为1,以便于比较。

技术验证:

- 验证了Piéron定律,即反应时间与任务难度之间的相关性。

- 验证了数据集是否能够复现经典的绝对检测阈值。

- 验证了新数据库与TID2013数据库的一致性,并通过Group-MAD实验比较了两种数据库的响应。

这些实验为RAID-Database提供了丰富的数据,并确保了其质量和有效性。通过这些实验,作者能够收集到人类对不同类型和程度的图像失真的感知响应,这对于图像质量评估和人类视觉感知研究具有重要意义。

Q: 有什么可以进一步探索的点?

A: 基于这篇论文的内容和结果,以下是一些可以进一步探索的点:

跨文化研究:

- 研究不同文化背景下人们对图像失真的感知是否存在差异,并探索这些差异的原因和影响。

更广泛的年龄和性别范围:

- 扩展实验参与者的年龄和性别范围,以更全面地了解不同人群对图像失真的感知。

不同类型的仿射变换:

- 除了旋转、平移和缩放外,研究其他类型的仿射变换(如剪切变换)对人类视觉感知的影响。

失真水平的进一步细分:

- 增加失真水平的细分程度,以更精细地捕捉人类对细微失真变化的感知。

长期实验跟踪:

- 进行长期跟踪实验,以研究人们对图像失真感知的变化和适应性。

结合眼动追踪技术:

- 使用眼动追踪技术来同步记录观察者的视觉注意力和图像失真感知之间的关系。

机器学习模型的改进:

- 利用RAID-Database训练和测试机器学习模型,以提高图像质量评估的准确性,并探索新的算法。

跨模态研究:

- 将图像失真感知研究扩展到其他感官模态,如声音或触觉,以了解不同模态间感知失真的相互作用。

应用研究:

- 将RAID-Database应用于实际问题,如图像压缩、图像增强、虚拟现实和增强现实等领域,以评估和改进这些技术。

心理物理学模型的深入研究:

- 深入研究和改进心理物理学模型,以更好地解释和预测人类对图像失真的感知。

对比不同评估指标:

- 对比Mean Opinion Score (MOS)和其他评估指标(如MLDS)在图像质量评估中的有效性和适用性。

数据库的扩展和更新:

- 定期更新RAID-Database,包括更多的图像、失真类型和参与者反馈,以保持数据库的时效性和相关性。

这些探索点可以帮助研究者更深入地理解人类对图像失真的感知机制,并推动图像处理和视觉感知研究的发展。

Q: 总结一下论文的主要内容

A: 这篇论文介绍了一个名为RAID-Database的新数据库,它包含了人类对仿射图像变换(旋转、平移、缩放)和高斯噪声的响应。以下是论文的主要内容总结:

背景与动机:

- 现有的图像质量数据库主要关注数字媒体中的失真,而忽视了自然条件下常见的仿射变换。

- 仿射变换在日常生活中非常普遍,对于研究人类视觉感知和改进图像处理模型具有重要意义。

数据库构建:

- 使用24张自然图像作为参考,应用旋转、平移、缩放和高斯噪声四种失真,每种失真有九个级别。

- 共收集了864张失真图像的数据,涉及105名观察者和超过20000次图像比较。

实验方法:

- 采用最大似然差异量表方法(MLDS)来获得对失真图像的响应。

- 观察者需要比较四张图像(两对),并选择感知差异最大的一对。

数据记录与处理:

- 提供了原始数据和MLDS处理后的数据,包括观察者的人口统计信息、失真类型、失真级别和响应时间。

- MLDS响应经过标准化处理,使得不同曲线之间可以比较。

技术验证:

- 验证了数据集是否符合Piéron定律、绝对检测阈值,并与TID2013数据库进行了对比。

- 通过Group-MAD实验,展示了新数据库在描述人类行为方面的优越性。

代码与数据公开:

- 提供了用于读取数据库和计算MLDS响应的Python代码,以便其他研究者使用和适应这些资源。

结论:

- RAID-Database是一个与现有图像质量数据库兼容且能更准确描述人类行为的新数据库。

- 它为图像处理和人类视觉感知研究提供了一个宝贵的资源。

这篇论文通过创建和验证一个新的图像质量数据库,为图像处理领域中人类视觉感知模型的设计和评估提供了新的视角和工具。

Q: 想要进一步了解论文

A: 以上只是了解一篇论文的几个基本FAQ。如果你还想与Kimi进一步讨论该论文,请点击 这里 为你跳转Kimi AI网页版,并启动一个与该论文相关的新会话。

点此查看论文截图

Synthetic to Authentic: Transferring Realism to 3D Face Renderings for Boosting Face Recognition

Authors:Parsa Rahimi, Behrooz Razeghi, Sebastien Marcel

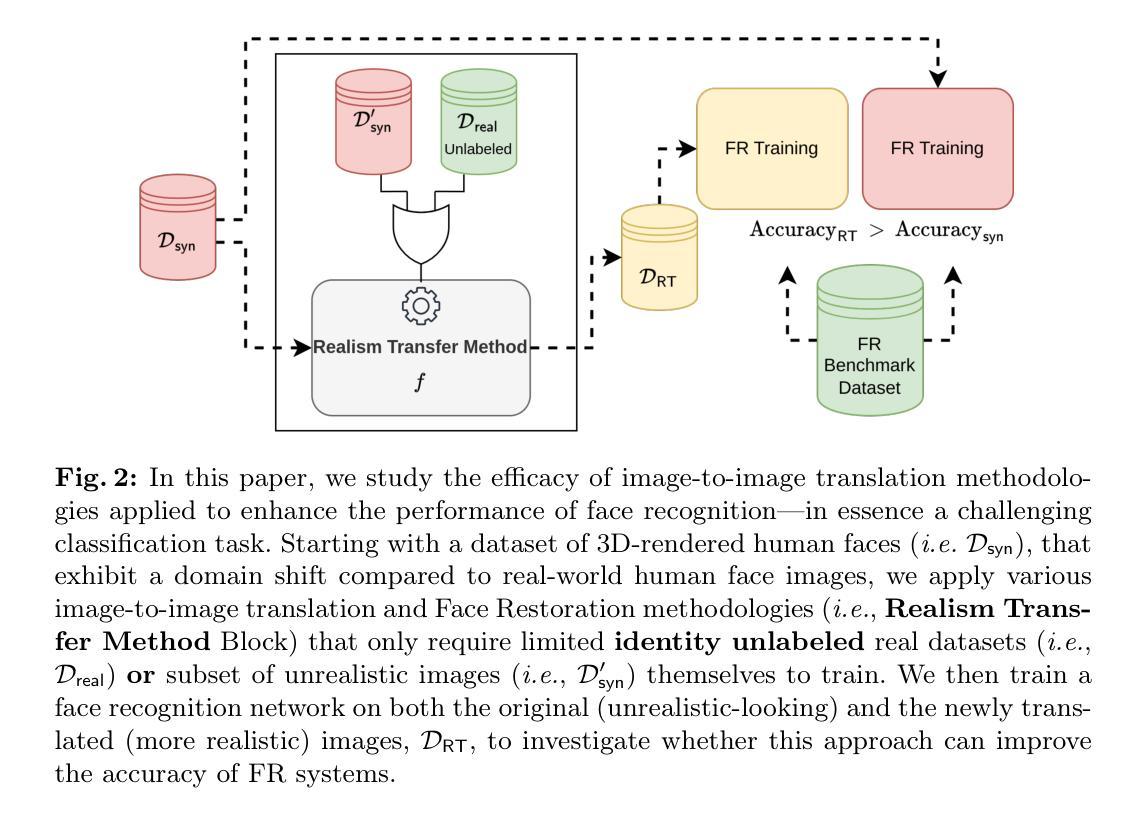

In this paper, we investigate the potential of image-to-image translation (I2I) techniques for transferring realism to 3D-rendered facial images in the context of Face Recognition (FR) systems. The primary motivation for using 3D-rendered facial images lies in their ability to circumvent the challenges associated with collecting large real face datasets for training FR systems. These images are generated entirely by 3D rendering engines, facilitating the generation of synthetic identities. However, it has been observed that FR systems trained on such synthetic datasets underperform when compared to those trained on real datasets, on various FR benchmarks. In this work, we demonstrate that by transferring the realism to 3D-rendered images (i.e., making the 3D-rendered images look more real), we can boost the performance of FR systems trained on these more photorealistic images. This improvement is evident when these systems are evaluated against FR benchmarks utilizing real-world data, thereby paving new pathways for employing synthetic data in real-world applications.

在这篇论文中,我们研究了图像到图像(I2I)翻译技术在人脸识别(FR)系统中将逼真度转移到3D渲染面部图像方面的潜力。使用3D渲染面部图像的主要动机在于,它们能够规避与收集大量真实面部数据集以训练人脸识别系统相关的挑战。这些图像完全由3D渲染引擎生成,促进了合成身份的生成。然而,人们已经观察到,与在真实数据集上训练的FR系统相比,在多种人脸识别基准测试中,在合成数据集上训练的FR系统的性能较差。在这项工作中,我们证明通过将这些逼真度转移到3D渲染的图像上(即让3D渲染的图像看起来更逼真),我们可以提高在这些更逼真的图像上训练的人脸识别系统的性能。当这些系统在与使用真实世界数据的FR基准测试中进行评估时,这一改进尤为明显,从而为人脸合成数据在真实世界应用中的使用开辟了新途径。

论文及项目相关链接

PDF ECCV24 Synthetic Data for Computer Vision (Oral)

Summary

本文探讨了图像到图像(I2I)翻译技术在人脸识别(FR)系统中将真实感转移到3D渲染面部图像上的潜力。使用3D渲染面部图像的主要动机在于它们能够克服在训练FR系统时收集大量真实面部数据集所面临的挑战。虽然FR系统在合成数据集上的性能落后于现实数据集上的性能,但通过将这些真实感转移到3D渲染图像上,可以提高在更逼真的图像上训练的FR系统的性能。这一改进在将系统评估为使用真实世界数据的FR基准测试时尤为明显,从而为在真实世界应用中使用合成数据开辟了新途径。

Key Takeaways

- 该研究关注于使用图像到图像(I2I)翻译技术在人脸识别(FR)系统中提升3D渲染面部图像的逼真度。

- 3D渲染面部图像主要用于训练FR系统,以规避收集大量真实面部数据集的挑战。

- 尽管在合成数据集上训练的FR系统性能有所下降,但通过增加3D渲染图像的逼真度,可以提高系统的性能。

- 提高的性能在针对使用真实世界数据的FR基准测试时尤为显著。

- 该研究展示了I2I翻译技术在提升合成数据逼真度方面的潜力。

- 通过将真实感转移到3D渲染图像上,可以改进FR系统的性能,这有助于推动合成数据在真实世界应用中的更广泛应用。

点击展开 Cool Papers 详细信息

Q: 这篇论文试图解决什么问题?

A: 这篇论文探讨了如何通过图像到图像的翻译(I2I)技术将3D渲染的人脸图像增加真实感,以提高面部识别(Face Recognition, FR)系统的性能。主要解决的问题是:

数据收集的挑战:当前的面部识别系统严重依赖于大量数据进行训练,这些数据的收集存在伦理和法律问题,尤其是在涉及个人隐私和敏感图像模态的情况下。

合成数据的应用:为了解决上述问题,研究者探索了合成数据作为真实数据的替代或补充的可能性。3D渲染的人脸图像可以完全由3D渲染引擎生成,从而避免了收集真实人脸数据的挑战。

性能差距:尽管合成数据提供了一种解决方案,但研究发现,仅使用这些合成数据训练的面部识别系统在性能上通常不如使用真实数据训练的系统。

现实感转移(Realism Transfer):论文的核心假设是,通过使3D渲染的人脸图像看起来更真实(即增加现实感),可以提高基于这些更逼真图像训练的面部识别系统的性能。

总结来说,论文试图通过增加3D渲染人脸图像的真实感来解决面部识别系统在合成数据上训练时的性能不足问题,进而推动合成数据在现实世界应用中的使用。

Q: 有哪些相关研究?

A: 论文中提到了多个与研究问题相关的领域和具体研究工作,以下是一些主要的相关研究:

合成数据在计算机视觉中的应用:

- 合成数据被广泛用于需要精确标注的任务,如语义图像分割、光流估计、面部解析和面部识别等。这些研究利用3D渲染引擎和物理模拟器来模拟真实世界的物理特性,以生成与真实数据分布相似的数据集。

无监督的图像到图像翻译(Unpaired Image-to-Image Translation):

- VSAIT (Vector Symbolic Architectures for Unpaired Image-to-Image Translation) [42]:使用向量符号架构(VSA)来最小化翻译图像中的内容不匹配问题。

- DECENT (Density Changing Regularized Unpaired Image Translation) [49]:基于密度变化的正则化方法,通过密度估计器来强制执行域间映射的密度保持。

- UNSB (Unpaired Neural Schrödinger Bridge) [20]:将薛定谔桥问题应用于图像到图像的任务,通过对抗学习和正则化技术来最小化维度诅咒。

逆问题和生成先验:

- StyleGANs:基于GAN的方法,通过在真实数据上训练并反转不真实图像到StyleGAN的潜在空间,以实现现实感增强。

- Diffusion Models:通过逐步添加噪声并尝试在逆过程中估计和去除噪声,从而实现从信号域到白高斯噪声的转换,并重建原始信号。

面部恢复方法:

- CodeFormer [54]:通过向量量化预训练量化自编码器,获得高质量的离散码本和相应的解码器,用于面部图像恢复。

- PGDiff [50]:引入部分引导的概念,其中扩散先验作为正则化,仅在所需属性上提供引导。

面部识别的合成数据生成:

- SYNFace [29]:利用DiscoFaceGAN创建具有特定属性控制的面部图像,以解决合成数据集中变化有限的问题。

- DigiFace-1M [6]:通过计算机图形学生成的大规模合成数据集,为面部识别提供训练数据。

- DCFace [22]:一个为面部识别设计的新型扩散模型,通过生成合成身份并混合“风格库”中的风格来创建独特多样的身份。

- IDiffFace [8]:利用条件潜在扩散模型(LDM)生成合成数据集,强调扩散模型在生成过程中对预训练FR系统的身份嵌入的依赖。

这些研究为本文提出的通过图像到图像翻译技术增强3D渲染人脸图像现实感的方法提供了理论和技术背景。

Q: 论文如何解决这个问题?

A: 论文通过以下步骤解决将3D渲染的人脸图像增加真实感以提高面部识别系统性能的问题:

问题表述:

- 论文首先定义了一个包含N个身份的3D渲染人脸图像数据集 (D_{syn}),每个身份有不同变化 (K_n)。

- 目标是使用少量的真实数据集 (D_{real}) 或者 (D_{syn}) 的子集 (D’{syn}) 来提高 (D{syn}) 的实用性。

数学公式化:

- 论文提出了一个数学公式来表达现实感转移的想法,定义了从源域(3D渲染图像)到目标域(真实世界图像)的映射函数 (f: X \rightarrow Y),以及反向映射 (g: Y \rightarrow X)。

- 优化问题旨在最小化源图像和目标图像分布之间的差异以及保留输入图像的特定特征。

应用通用公式于相关工作:

- 论文将提出的通用问题表述应用于相关工作,包括DECENT、VSAIT、UNSB和CodeFormer等方法,分析了每种方法如何适应于提出的框架。

实验验证:

- 论文通过实验验证了多种方法,包括CodeFormer、VSAIT、UNSB、DECENT、DDIM Inversion和StyleGAN Inversion等,来将不真实的图像((D_{syn}))转换为更真实的版本((D_{RT}))。

- 使用这些转换后的图像来训练面部识别系统,并在多个基准数据集上评估性能。

面部识别实验:

- 论文训练了一个包含ResNet50骨干网络和AdaFace头部的面部识别系统,并比较了使用原始DigiFace1M数据集和使用CodeFormer及VSAIT转换后的图像数据集训练得到的模型性能。

- 在LFW、CFPFP、CPLFW、CALFW、AgeDB和IJB-C等多个面部识别基准数据集上评估了模型性能。

结果分析:

- 论文发现,与原始DigiFace1M数据集训练的模型相比,使用CodeFormer和VSAIT转换后的图像训练的模型在所有基准上平均提高了2%到5%的性能。

- 特别是在更具挑战性的IJB-C基准测试中,现实感转移的性能提升更为显著。

结论与未来工作:

- 论文得出结论,通过使用不依赖于身份标签的转移模型,可以显著提高面部识别系统的性能,从而缩小与使用预训练FR数据生成的数据集的性能差距。

- 提出了未来工作的方向,包括探索质量评估指标,以预测在生成的数据集上训练的FR系统的性能。

通过上述步骤,论文展示了如何通过增加3D渲染人脸图像的真实感来提高面部识别系统的性能,并为未来的研究提供了新的方向。

Q: 论文做了哪些实验?

A: 论文中进行了一系列实验来验证所提出方法的有效性,具体实验包括:

方法探索:

- 论文首先探索了多种用于现实感转移的方法,包括CodeFormer、VSAIT、UNSB、DECENT、DDIM Inversion和StyleGAN Inversion。这些方法旨在将不真实的3D渲染人脸图像((D_{syn}))转换为更真实的版本((D_{RT}))。

实验设置:

- 对于CodeFormer,使用了作者提供的、仅在FFHQ数据集上训练的预训练模型,不包含任何身份标签。

- 对于VSAIT、UNSB和DECENT等无监督的图像到图像翻译方法,从DigiFace1M数据集中随机选取了5个shard作为源域数据,每个shard包含20,000张图像;同样地,从FFHQ数据集中随机选取了5个shard作为目标域数据。

性能评估:

- 选择了两种方法(CodeFormer和VSAIT)进行最终的面部识别实验,基于它们处理图像的时间和定性检查结果。

- 训练了一个包含ResNet50骨干网络和AdaFace头部的面部识别系统,并分别在原始DigiFace1M数据集和使用CodeFormer及VSAIT转换后的图像数据集上进行训练。

基准测试:

- 在多个面部识别基准数据集上评估了模型性能,包括LFW、CFPFP、CPLFW、CALFW、AgeDB和IJB-C。

- 报告了在不同固定假匹配率(FMR)下的真正接受率(TAR)以及在不同阈值下的TAR。

结果分析:

- 与原始DigiFace1M数据集训练的模型相比,使用CodeFormer和VSAIT转换后的图像训练的模型在所有基准上平均提高了2%到5%的性能。

- 在更具挑战性的IJB-C基准测试中,现实感转移的性能提升更为显著,平均提高了约3-5%。

ROC曲线分析:

- 论文还绘制了IJB-C基准测试的ROC曲线,进一步强调了与原始DigiFace1M基线相比,现实感转移相对于DigiFace1M的性能提升。

这些实验验证了通过增加3D渲染人脸图像的真实感可以有效地提高面部识别系统的性能,并为未来的研究提供了新的方向。

Q: 有什么可以进一步探索的点?

A: 论文在结论部分提出了一些未来可能的研究方向,以下是可以进一步探索的几个点:

质量评估指标:

- 开发一个质量评估指标,该指标能够与在生成的数据集上训练的面部识别系统的性能相关联,从而允许独立评估转移后数据集的潜力。

更高效的现实感转移方法:

- 探索更高效的图像到图像翻译方法,以减少将新转移方法应用于整个源数据集所需的重复训练和时间。

改进的合成数据生成技术:

- 研究和开发新的合成数据生成技术,以进一步缩小合成数据和真实数据之间的性能差距。

更广泛的数据集和场景:

- 在更广泛的数据集和场景下测试现实感转移方法的有效性,包括不同光照、姿态和表情的人脸图像。

无监督和半监督学习:

- 探索无监督和半监督学习技术,以减少对大量标记数据的依赖,并提高模型的泛化能力。

跨域适应性:

- 研究如何提高模型在跨域任务中的适应性,特别是在从合成数据到真实数据的迁移学习场景中。

伦理和隐私问题:

- 进一步探讨合成数据在面部识别中的应用对伦理和隐私问题的影响,以及如何设计符合伦理和隐私保护的面部识别系统。

模型鲁棒性:

- 研究如何提高面部识别系统在面对合成数据和真实数据差异时的鲁棒性。

更深入的数据分析:

- 对现实感转移前后的数据进行更深入的分析,以了解哪些特定的属性或特征对面部识别性能的提升最为关键。

多模态学习:

- 考虑将面部识别问题扩展到多模态学习框架中,结合视觉信息和其他模态(如深度信息、IR图像等)来提高识别准确性。

这些方向不仅可以推动面部识别技术的发展,还可能对计算机视觉和人工智能的其他领域产生积极影响。

Q: 总结一下论文的主要内容

A: 这篇论文的主要内容包括以下几个方面:

问题背景:

- 论文讨论了面部识别(FR)系统在训练时对大量真实人脸数据集的依赖性问题,以及收集这些数据集时涉及的隐私和法律挑战。

研究动机:

- 鉴于隐私和数据收集的挑战,论文探索了使用3D渲染生成的合成人脸图像来训练FR系统的可能性,并试图通过图像到图像的翻译(I2I)技术提高这些合成图像的真实感。

研究问题:

- 论文的核心研究问题是如何使现有的3D渲染人脸图像数据集更加真实,以提高基于这些数据训练的FR模型的准确性。

主要贡献:

- 提出了一个假设,即通过增强3D渲染人脸图像的真实感,可以提升基于这些图像训练的FR系统的性能。

- 通过大量实验验证了这一假设,并提出了一个数学框架来统一不同的现实感转移方法。

方法论:

- 论文提出了一个通用的图像到图像翻译问题表述,并将其应用于几种不同的方法,包括DECENT、VSAIT、UNSB和CodeFormer等。

- 通过实验比较了这些方法在提升3D渲染人脸图像真实感方面的效果,并选择了效果较好的方法用于FR实验。

实验设计和结果:

- 进行了面部识别实验,比较了使用原始DigiFace1M数据集和使用CodeFormer及VSAIT转换后的图像数据集训练得到的模型性能。

- 实验结果显示,使用转换后的图像训练的FR系统在多个基准数据集上平均提高了2%到5%的性能。

结论与未来工作:

- 论文得出结论,通过增强合成人脸图像的真实感可以显著提高FR系统的性能,并提出了未来可能的研究方向,包括开发质量评估指标和探索更高效的现实感转移方法。

总的来说,这篇论文为提高基于合成数据训练的面部识别系统的性能提供了新的视角和方法,并为未来的研究指明了方向。

Q: 想要进一步了解论文

A: 以上只是了解一篇论文的几个基本FAQ。如果你还想与Kimi进一步讨论该论文,请点击 这里 为你跳转Kimi AI网页版,并启动一个与该论文相关的新会话。

点此查看论文截图