⚠️ 以下所有内容总结都来自于 大语言模型的能力,如有错误,仅供参考,谨慎使用

🔴 请注意:千万不要用于严肃的学术场景,只能用于论文阅读前的初筛!

💗 如果您觉得我们的项目对您有帮助 ChatPaperFree ,还请您给我们一些鼓励!⭐️ HuggingFace免费体验

2025-01-30 更新

CSPCL: Category Semantic Prior Contrastive Learning for Deformable DETR-Based Prohibited Item Detectors

Authors:Mingyuan Li, Tong Jia, Hui Lu, Bowen Ma, Hao Wang, Dongyue Chen

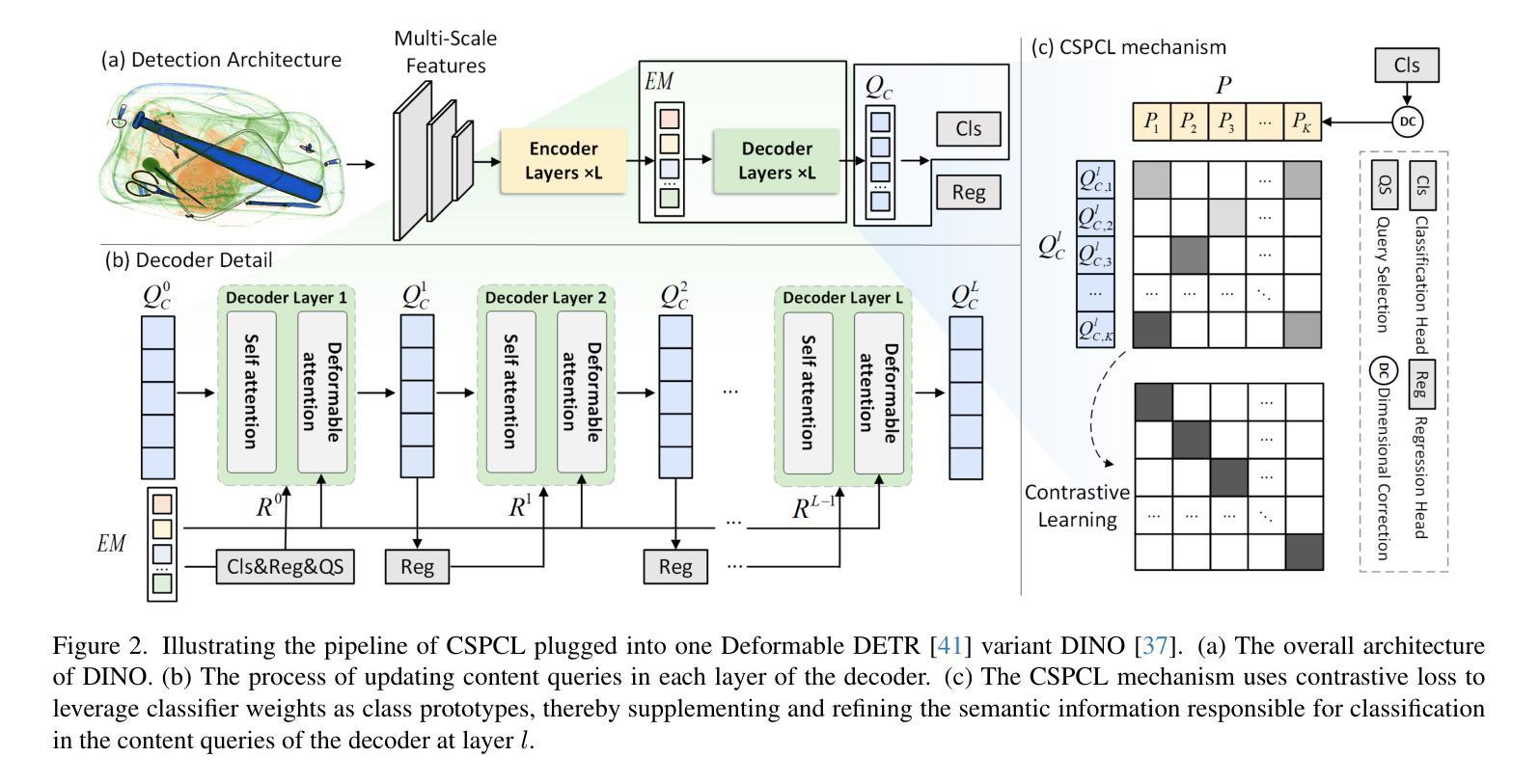

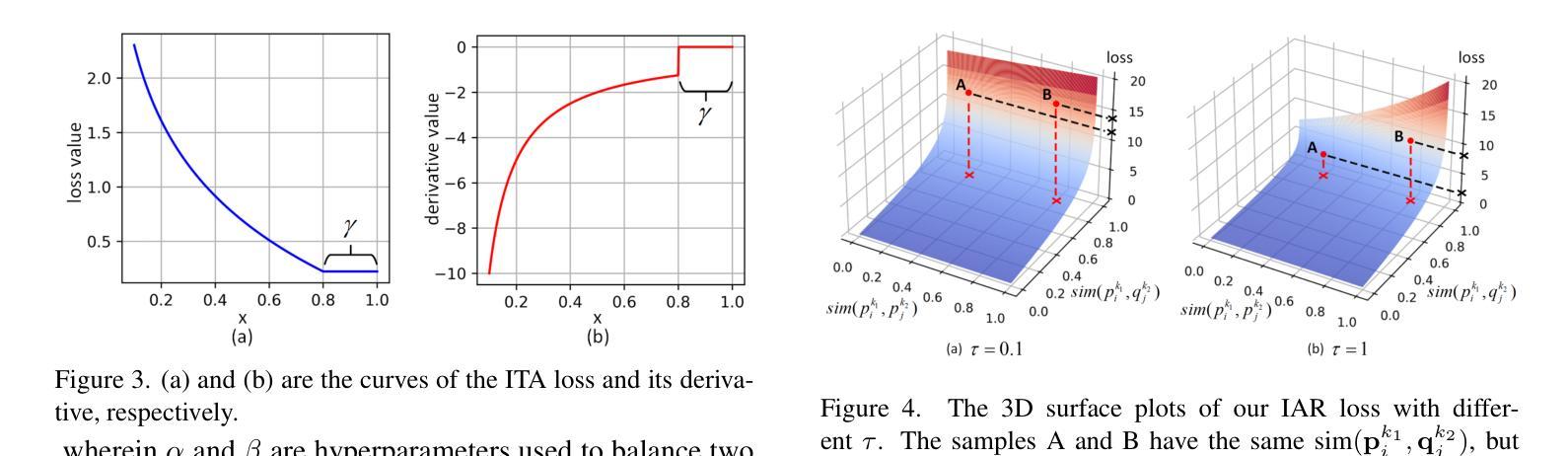

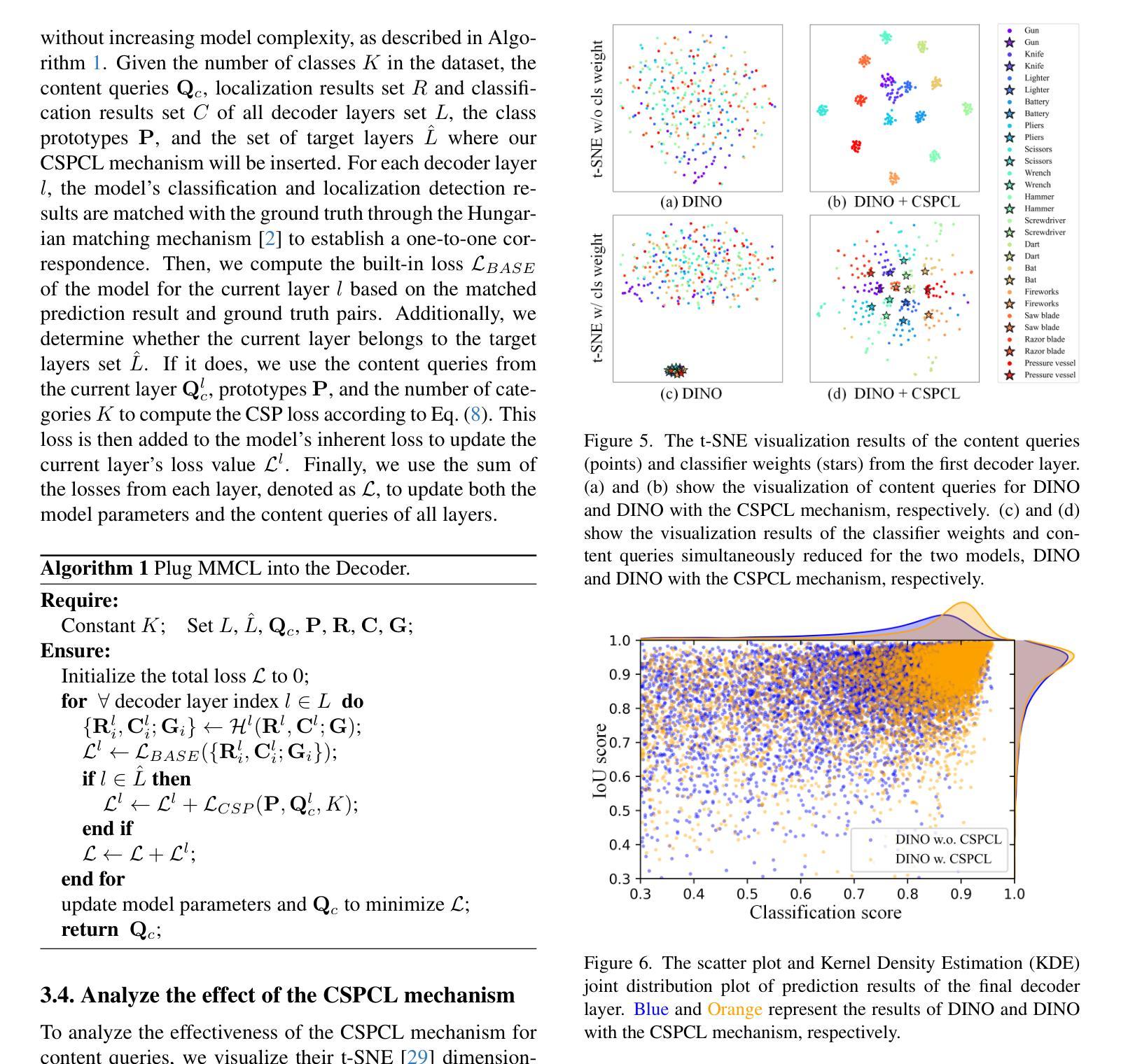

Prohibited item detection based on X-ray images is one of the most effective security inspection methods. However, the foreground-background feature coupling caused by the overlapping phenomenon specific to X-ray images makes general detectors designed for natural images perform poorly. To address this issue, we propose a Category Semantic Prior Contrastive Learning (CSPCL) mechanism, which aligns the class prototypes perceived by the classifier with the content queries to correct and supplement the missing semantic information responsible for classification, thereby enhancing the model sensitivity to foreground features.To achieve this alignment, we design a specific contrastive loss, CSP loss, which includes Intra-Class Truncated Attraction (ITA) loss and Inter-Class Adaptive Repulsion (IAR) loss, and outperforms classic N-pair loss and InfoNCE loss. Specifically, ITA loss leverages class prototypes to attract intra-class category-specific content queries while preserving necessary distinctiveness. IAR loss utilizes class prototypes to adaptively repel inter-class category-specific content queries based on the similarity between class prototypes, helping disentangle features of similar categories.CSPCL is general and can be easily integrated into Deformable DETR-based models. Extensive experiments on the PIXray and OPIXray datasets demonstrate that CSPCL significantly enhances the performance of various state-of-the-art models without increasing complexity.The code will be open source once the paper is accepted.

基于X射线图像的违禁物品检测是最有效的安全检查方法之一。然而,X射线图像特有的重叠现象导致的前景背景特征耦合,使得为自然图像设计的通用检测器表现不佳。为了解决这一问题,我们提出了一种类别语义先验对比学习(CSPCL)机制,该机制将分类器感知的类别原型与内容查询对齐,以纠正和补充负责分类的缺失语义信息,从而提高模型对前景特征的敏感性。为了实现这种对齐,我们设计了一种特定的对比损失函数CSP损失函数,它包括类内截断吸引力(ITA)损失和类间自适应排斥力(IAR)损失,并优于经典的N-pair损失和InfoNCE损失。具体来说,ITA损失利用类别原型吸引同一类别特定的内容查询,同时保持必要的区分性。IAR损失利用类别原型根据类别原型之间的相似性自适应地排斥不同类别特定的内容查询,有助于解开相似类别的特征。CSPCL是通用的,可以很容易地集成到基于可变形DETR的模型中。在PIXray和OPIXray数据集上的大量实验表明,CSPCL能显著提高各种最新模型的性能,而且不会增加复杂性。论文被接受后,代码将开源。

论文及项目相关链接

PDF 10 pages

Summary

基于X光图像的违禁品检测是有效的安检手段之一。但X光图像特有的重叠现象造成的前景背景特征耦合问题使得通用自然图像检测器表现不佳。为应对此问题,我们提出了类别语义先验对比学习(CSPCL)机制,该机制通过使分类器感知的类别原型与内容查询对齐,以修正并补充缺失的语义信息,从而提高模型对前景特征的敏感性。为实现这一对齐,我们设计了特定的对比损失函数CSP损失,包括类内截断吸引损失(ITA损失)和类间自适应排斥损失(IAR损失),其表现优于传统的N-pair损失和InfoNCE损失。CSPCL机制通用性强,可轻松融入基于可变形DETR的模型。在PIXray和OPIXray数据集上的实验表明,CSPCL能显著提升前沿模型的性能,且不会增加复杂度。论文被接受后,代码将开源。

Key Takeaways

- 基于X光图像的违禁品检测是有效的安全检测手段。

- X光图像中的前景背景特征耦合问题导致通用检测器性能下降。

- 提出了CSPCL机制,通过类别语义先验对比学习提高模型对前景特征的敏感性。

- CSPCL包括CSP损失,涵盖ITA损失和IAR损失,表现优于传统对比损失函数。

- CSPCL机制易于融入基于可变形DETR的模型。

- 在PIXray和OPIXray数据集上的实验表明CSPCL显著提升模型性能。

点此查看论文截图

Self-supervised Graph Transformer with Contrastive Learning for Brain Connectivity Analysis towards Improving Autism Detection

Authors:Yicheng Leng, Syed Muhammad Anwar, Islem Rekik, Sen He, Eung-Joo Lee

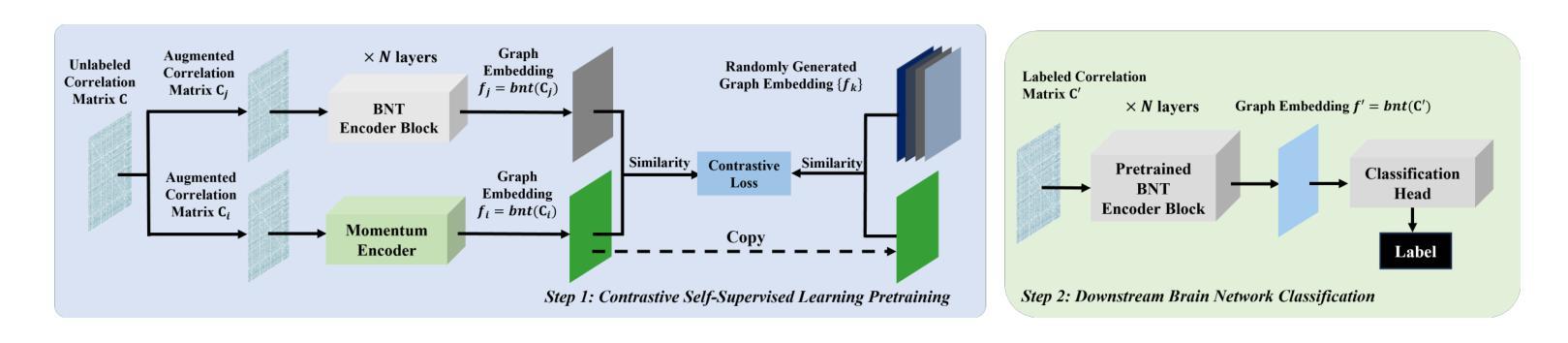

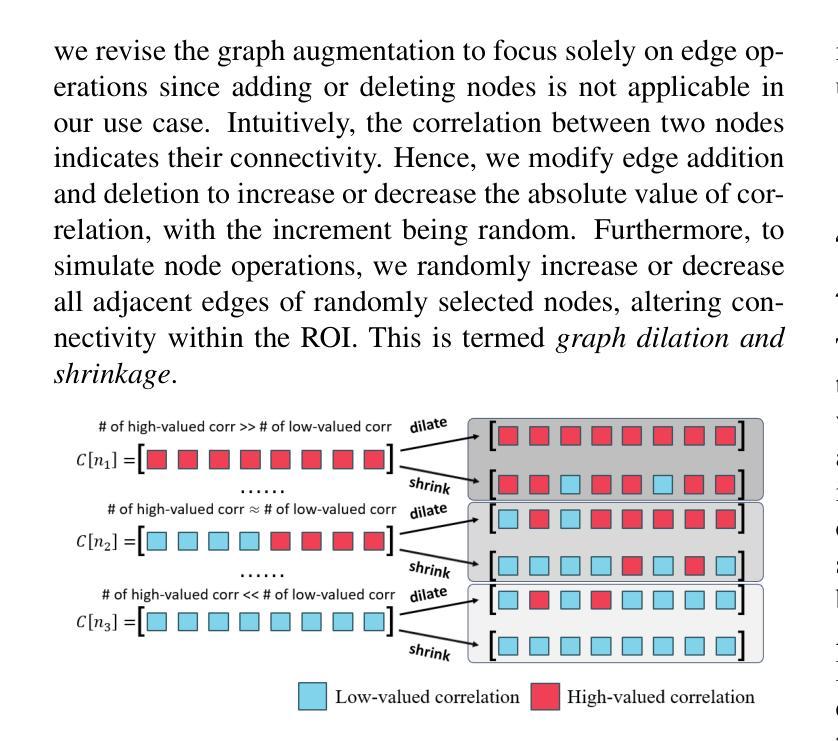

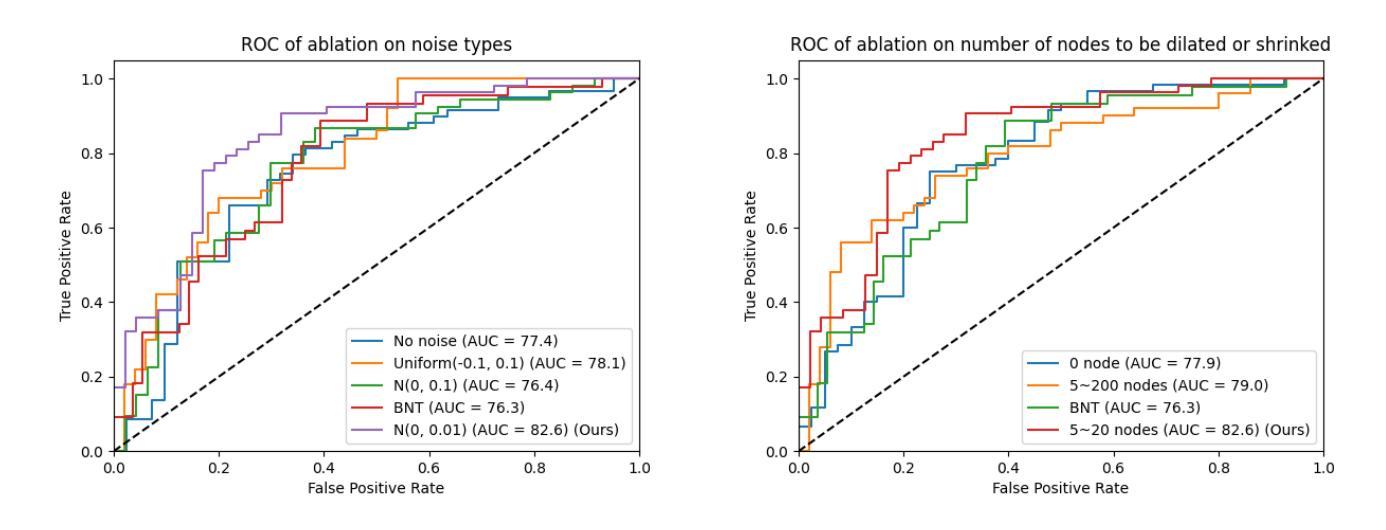

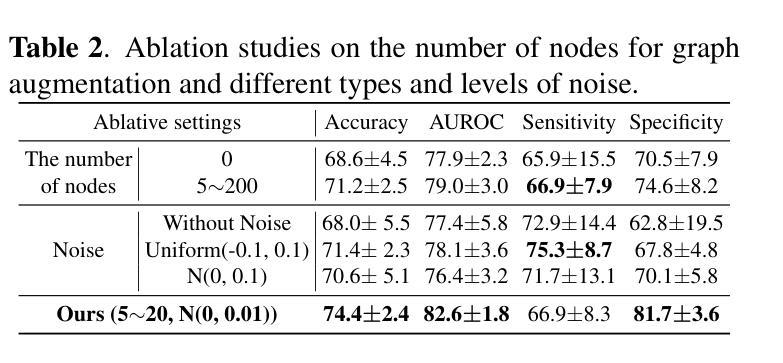

Functional Magnetic Resonance Imaging (fMRI) provides useful insights into the brain function both during task or rest. Representing fMRI data using correlation matrices is found to be a reliable method of analyzing the inherent connectivity of the brain in the resting and active states. Graph Neural Networks (GNNs) have been widely used for brain network analysis due to their inherent explainability capability. In this work, we introduce a novel framework using contrastive self-supervised learning graph transformers, incorporating a brain network transformer encoder with random graph alterations. The proposed network leverages both contrastive learning and graph alterations to effectively train the graph transformer for autism detection. Our approach, tested on Autism Brain Imaging Data Exchange (ABIDE) data, demonstrates superior autism detection, achieving an AUROC of 82.6 and an accuracy of 74%, surpassing current state-of-the-art methods.

功能磁共振成像(fMRI)为大脑在任务或休息状态下的功能提供了有用的见解。使用关联矩阵表示fMRI数据是分析大脑在休息和活动状态下的内在连通性的可靠方法。图神经网络(GNN)由于其固有的可解释性能力而被广泛应用于脑网络分析。在这项工作中,我们介绍了一种使用对比自监督学习图变换器的新框架,该框架结合了一个脑网络变换器编码器与随机图变化。所提出的网络利用对比学习和图变换,有效地训练了图变换器进行自闭症检测。我们的方法经过自闭症脑成像数据交换(ABIDE)数据的测试,表现出卓越的自闭症检测能力,达到了82.6的AUROC和74%的准确率,超越了当前最先进的方法。

论文及项目相关链接

Summary

利用功能磁共振成像(fMRI)数据分析脑功能的研究中,本研究提出一种基于对比自监督学习图神经网络(Graph Neural Networks, GNNs)的新框架。该研究通过结合脑网络变换编码器和随机图变换,利用对比学习和图变换技术训练图神经网络模型进行自闭症检测。在自闭症脑成像数据交换(ABIDE)数据集上的实验结果显示,该方法在自闭症检测上具有优越性能,达到82.6%的AUROC和74%的准确率,超越了当前最先进的方法。

Key Takeaways

- 本研究利用功能磁共振成像(fMRI)数据来洞察大脑在休息和活动状态下的功能连接性。

- 采用图神经网络(GNNs)进行脑网络分析,因其内在的可解释性能力而备受青睐。

- 研究提出了一种新的框架,结合了对比自监督学习和图变换技术,特别是脑网络变换编码器和随机图变换。

- 该框架旨在通过对比学习和图变换有效训练图神经网络模型进行自闭症检测。

- 在自闭症脑成像数据交换(ABIDE)数据集上的实验验证了该方法的有效性。

- 该方法实现了较高的自闭症检测性能,达到82.6%的AUROC和74%的准确率。

点此查看论文截图