⚠️ 以下所有内容总结都来自于 大语言模型的能力,如有错误,仅供参考,谨慎使用

🔴 请注意:千万不要用于严肃的学术场景,只能用于论文阅读前的初筛!

💗 如果您觉得我们的项目对您有帮助 ChatPaperFree ,还请您给我们一些鼓励!⭐️ HuggingFace免费体验

2025-02-01 更新

Technical report on label-informed logit redistribution for better domain generalization in low-shot classification with foundation models

Authors:Behraj Khan, Tahir Syed

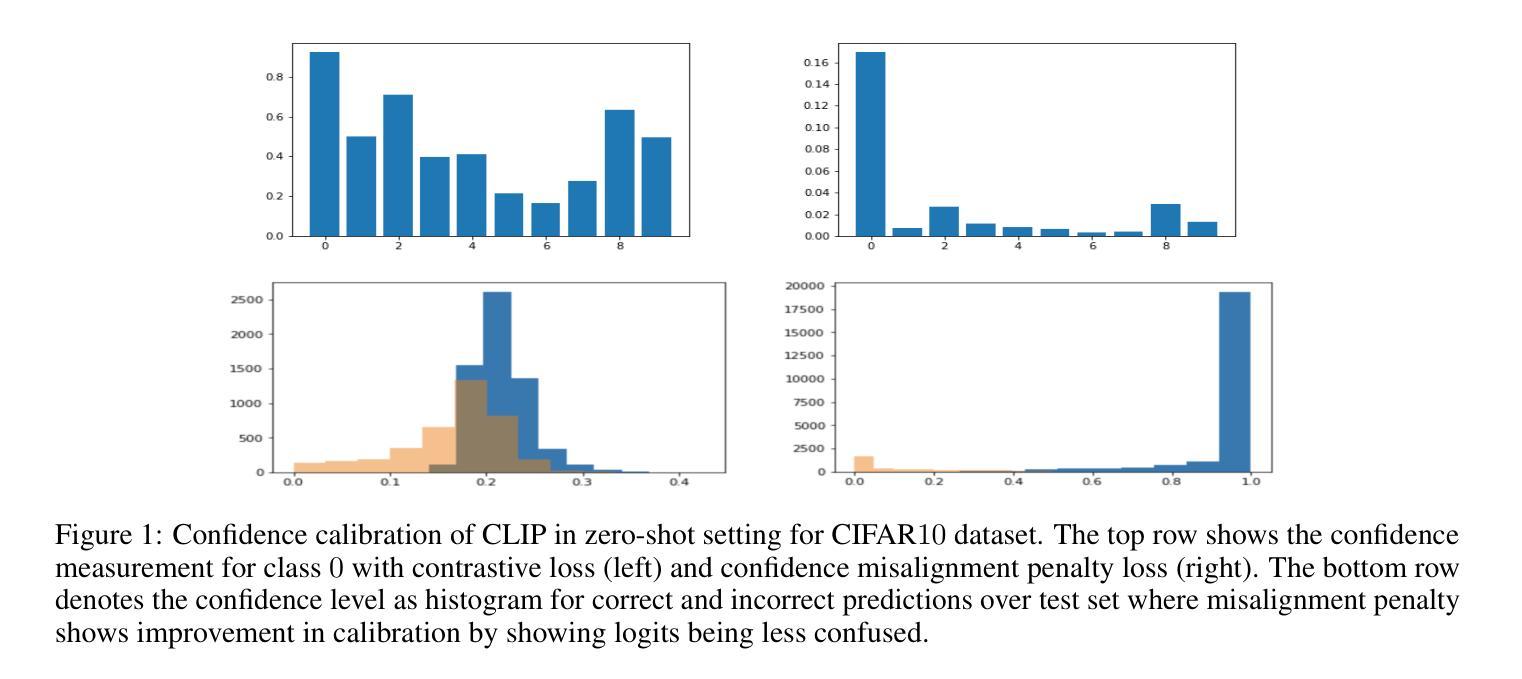

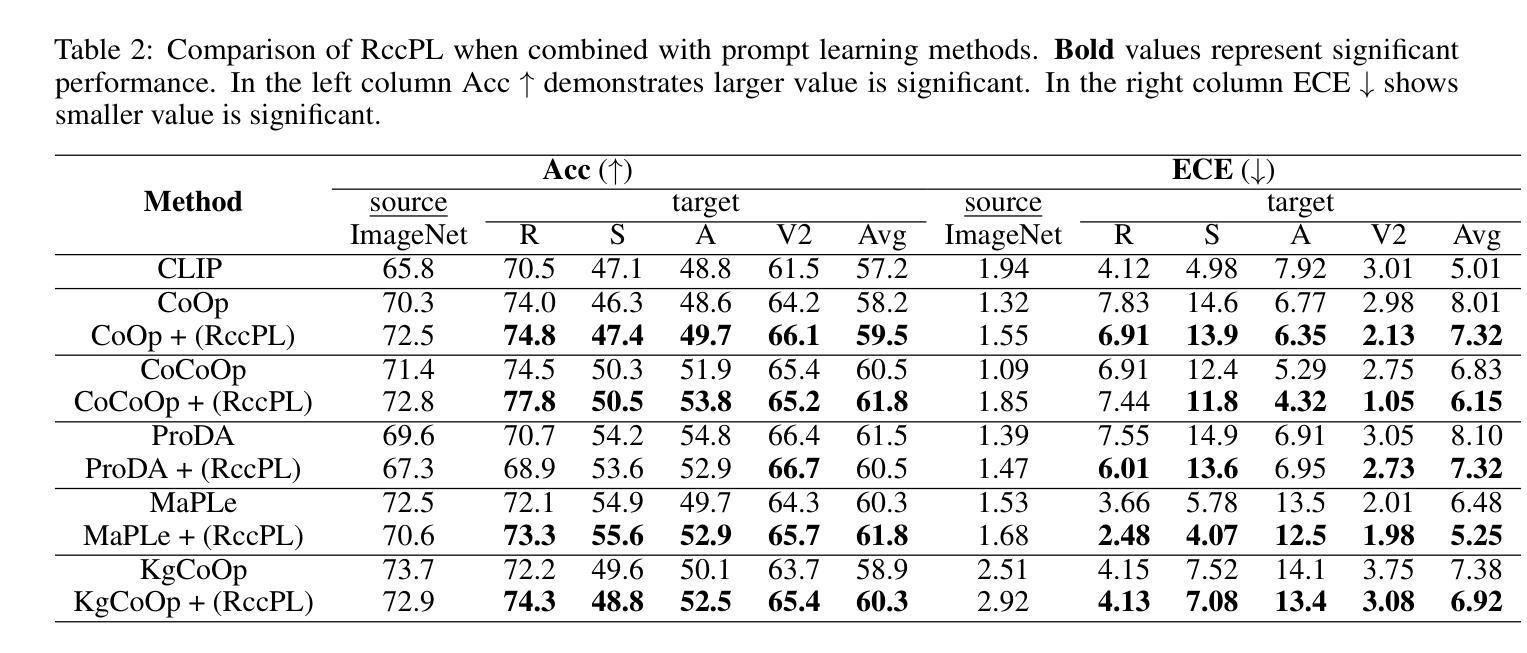

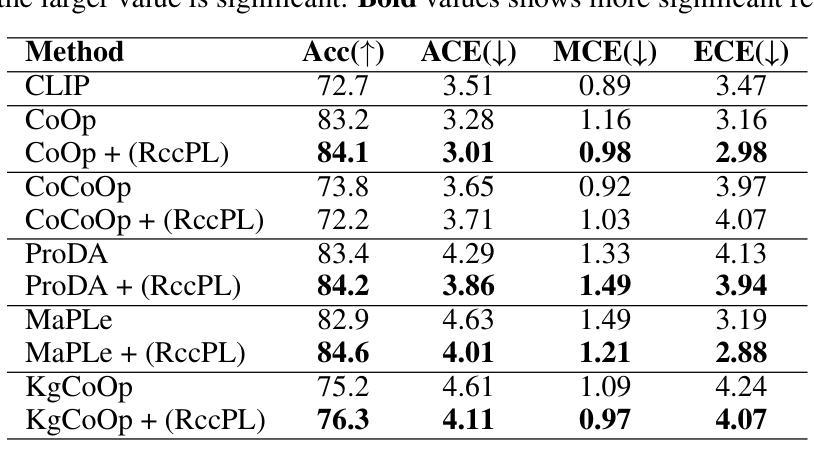

Confidence calibration is an emerging challenge in real-world decision systems based on foundations models when used for downstream vision classification tasks. Due to various reasons exposed, logit scores on the CLIP head remain large irrespective of whether the image-language pairs reconcile. It is difficult to address in data space, given the few-shot regime. We propose a penalty incorporated into loss objective that penalizes incorrect classifications whenever one is made during finetuning, by moving an amount of log-likelihood to the true class commensurate to the relative amplitudes of the two likelihoods. We refer to it as \textit{confidence misalignment penalty (CMP)}. Extensive experiments on $12$ vision datasets and $5$ domain generalization datasets supports the calibration performance of our method against stat-of-the-art. CMP outperforms the benchmarked prompt learning methods, demonstrating average improvement in Expected Calibration Error (ECE) by average $6.01$%, $4.01$ % at minimum and $9.72$% at maximum.

在基于基础模型的现实世界决策系统中,当用于下游视觉分类任务时,置信度校准是一个新兴的挑战。由于各种原因,CLIP头部上的logit分数无论图像-语言对是否协调都仍然很大。在少镜头制度下,数据空间中很难解决这一问题。我们提出了一种惩罚措施,将其纳入损失目标中,通过在微调时移动与两个可能性的相对幅度相称的对数似然量到真实类别来惩罚不正确的分类。我们将其称为“置信度不匹配惩罚(CMP)”。在12个视觉数据集和5个领域泛化数据集上的大量实验支持了我们的方法与当前最佳水平的校准性能。CMP表现优于基准提示学习方法,在期望校准误差(ECE)方面平均提高了6.01%,最低提高了4.01%,最高提高了9.72%。

论文及项目相关链接

Summary

针对基于视觉转换模型的下流分类任务,在实际决策系统中出现的置信度校准问题,提出一种在损失函数中引入惩罚项的方法,称为置信度不匹配惩罚(CMP)。该方法在微调过程中,对错误分类进行惩罚,将相对幅度较大的对数似然量转移到真实类别上。在多个数据集上的实验表明,CMP方法在置信度校准方面的性能优于当前技术水平,平均期望校准误差(ECE)平均提高了约6%。

Key Takeaways

- 置信度校准是实际决策系统中的一个新兴挑战,特别是在基于视觉转换模型的下流分类任务中。

- CLIP头部上的对数得分在图像-语言对是否匹配的情况下仍然很大。

- 提出了一种称为置信度不匹配惩罚(CMP)的方法,通过在损失函数中引入惩罚项来解决这个问题。

- CMP方法在微调过程中对错误分类进行惩罚,将相对幅度较大的对数似然量转移到真实类别上。

- 在多个数据集上的实验表明,CMP方法在置信度校准方面的性能优于当前技术水平。

- CMP方法平均期望校准误差(ECE)平均提高了约6%。这表明CMP方法可以显著提高模型的置信度校准性能。

点此查看论文截图