⚠️ 以下所有内容总结都来自于 大语言模型的能力,如有错误,仅供参考,谨慎使用

🔴 请注意:千万不要用于严肃的学术场景,只能用于论文阅读前的初筛!

💗 如果您觉得我们的项目对您有帮助 ChatPaperFree ,还请您给我们一些鼓励!⭐️ HuggingFace免费体验

2025-04-08 更新

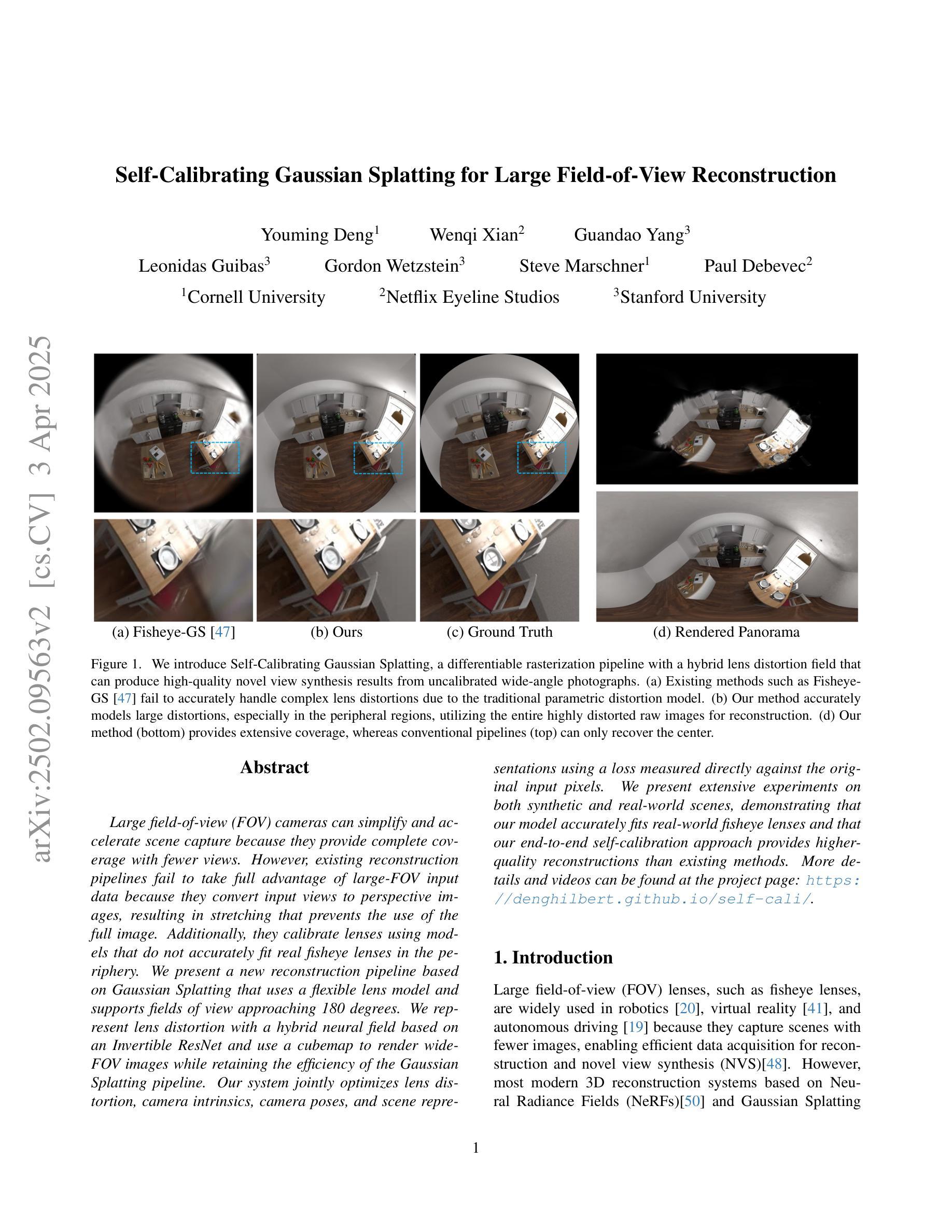

Self-Calibrating Gaussian Splatting for Large Field of View Reconstruction

Authors:Youming Deng, Wenqi Xian, Guandao Yang, Leonidas Guibas, Gordon Wetzstein, Steve Marschner, Paul Debevec

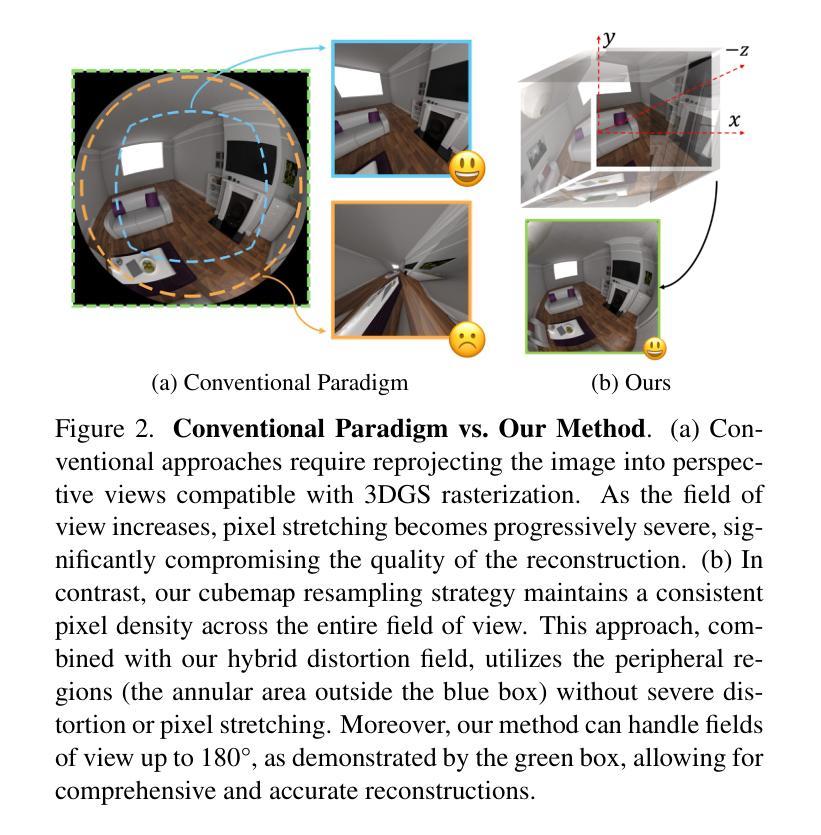

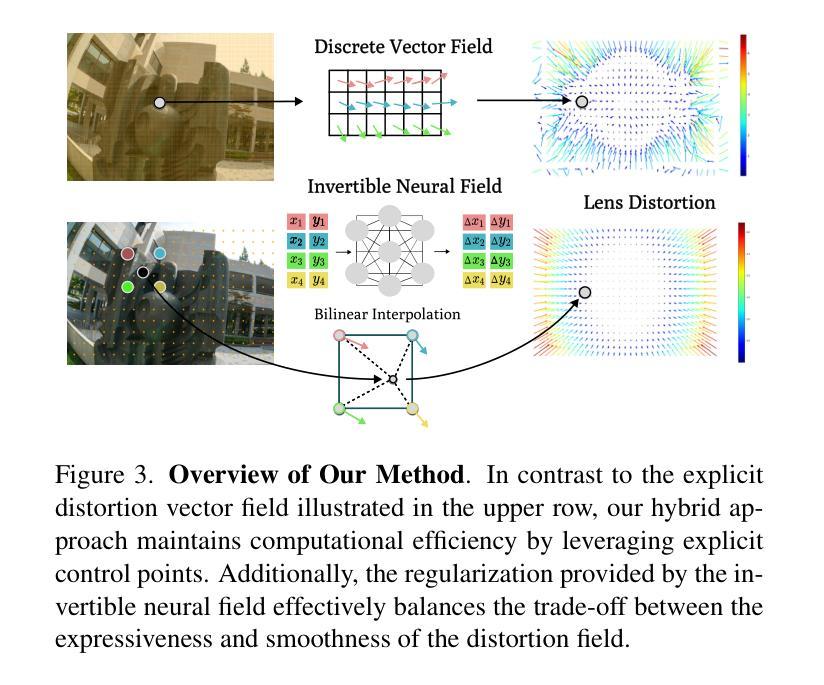

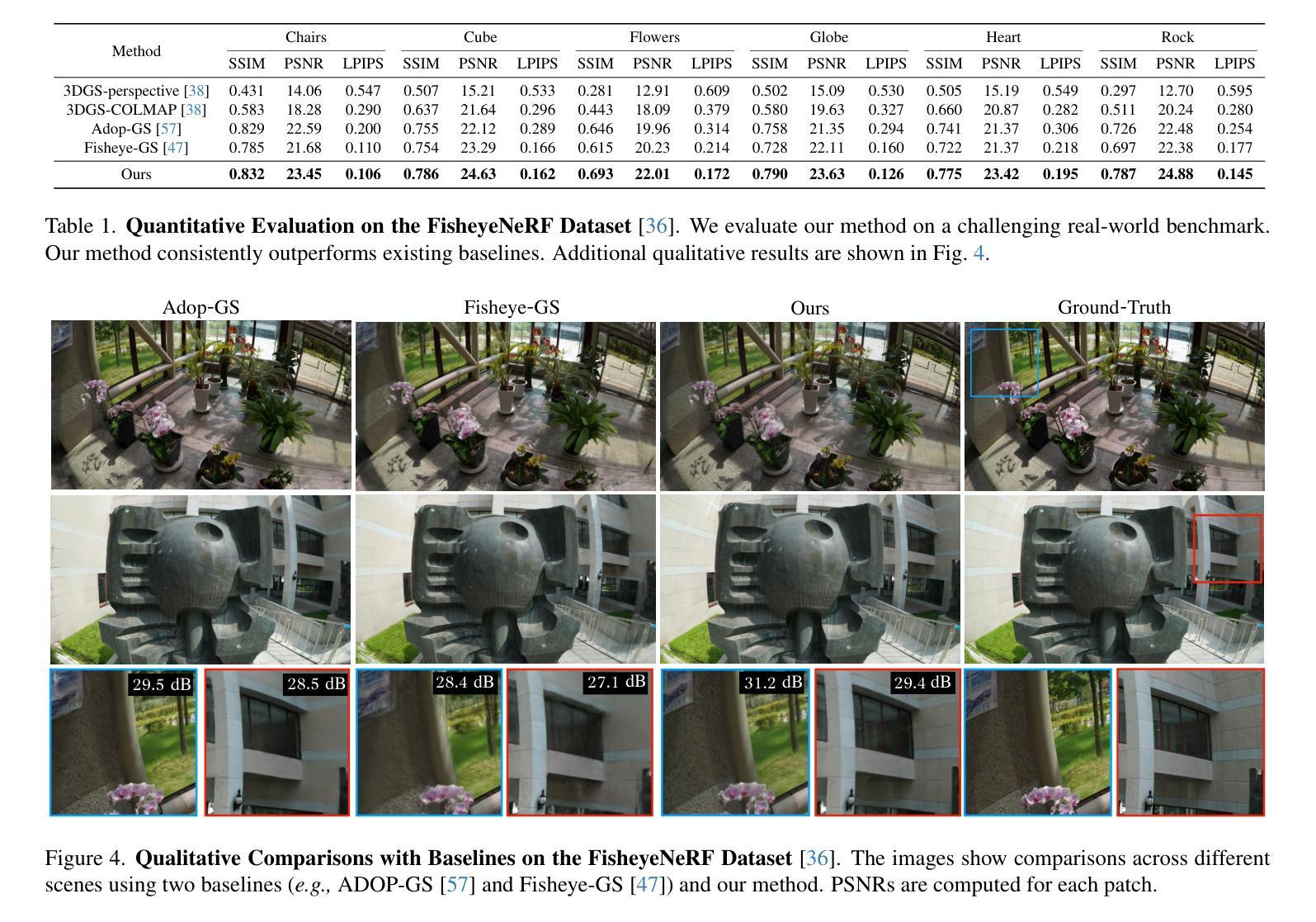

In this paper, we present a self-calibrating framework that jointly optimizes camera parameters, lens distortion and 3D Gaussian representations, enabling accurate and efficient scene reconstruction. In particular, our technique enables high-quality scene reconstruction from Large field-of-view (FOV) imagery taken with wide-angle lenses, allowing the scene to be modeled from a smaller number of images. Our approach introduces a novel method for modeling complex lens distortions using a hybrid network that combines invertible residual networks with explicit grids. This design effectively regularizes the optimization process, achieving greater accuracy than conventional camera models. Additionally, we propose a cubemap-based resampling strategy to support large FOV images without sacrificing resolution or introducing distortion artifacts. Our method is compatible with the fast rasterization of Gaussian Splatting, adaptable to a wide variety of camera lens distortion, and demonstrates state-of-the-art performance on both synthetic and real-world datasets.

本文提出了一种自校准框架,该框架联合优化了相机参数、镜头畸变和3D高斯表示,从而实现了准确高效的场景重建。特别是,我们的技术能够从使用广角镜头拍摄的大视野(FOV)图像中进行高质量的场景重建,允许从较少的图像中对场景进行建模。我们的方法引入了一种使用混合网络对复杂镜头畸变进行建模的新方法,该网络结合了可逆残差网络和显式网格。这种设计有效地规范了优化过程,实现了比传统相机模型更高的精度。此外,我们提出了一种基于立方图的重采样策略,以支持大视野图像,而不牺牲分辨率或引入失真伪影。我们的方法与高斯贴图快速光线投射兼容,可适应各种相机镜头畸变,并在合成和真实世界数据集上均表现出卓越的性能。

论文及项目相关链接

PDF Project Page: https://denghilbert.github.io/self-cali/

Summary

本论文提出了一种联合优化相机参数、镜头畸变和三维高斯表示的自校准框架,能够实现准确高效的三维场景重建。该技术可从大视角图像中重建高质量场景,使用广角镜头从少量图像中即可建模场景。采用混合网络建模复杂镜头畸变,结合可逆残差网络和显式网格设计,有效优化过程,提高准确性。此外,采用基于立方图的重采样策略,支持大视角图像,不损失分辨率或引入失真伪影。该方法与高斯平铺的快速光栅化兼容,适应各种相机镜头畸变,并在合成和真实数据集上均表现出卓越性能。

Key Takeaways

- 提出了联合优化相机参数、镜头畸变和三维高斯表示的自校准框架。

- 能够实现高质量的场景重建,尤其适用于大视角图像。

- 采用混合网络建模复杂镜头畸变,提高优化过程的准确性和有效性。

- 通过可逆残差网络和显式网格设计相结合,有效优化相机模型。

- 采用基于立方图的重采样策略,支持大视角图像而不损失分辨率或引入失真。

- 方法与快速光栅化技术兼容,提高重建效率。

点此查看论文截图

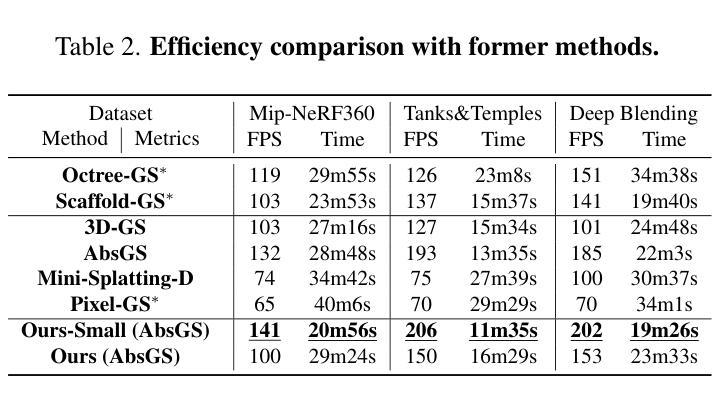

ResGS: Residual Densification of 3D Gaussian for Efficient Detail Recovery

Authors:Yanzhe Lyu, Kai Cheng, Xin Kang, Xuejin Chen

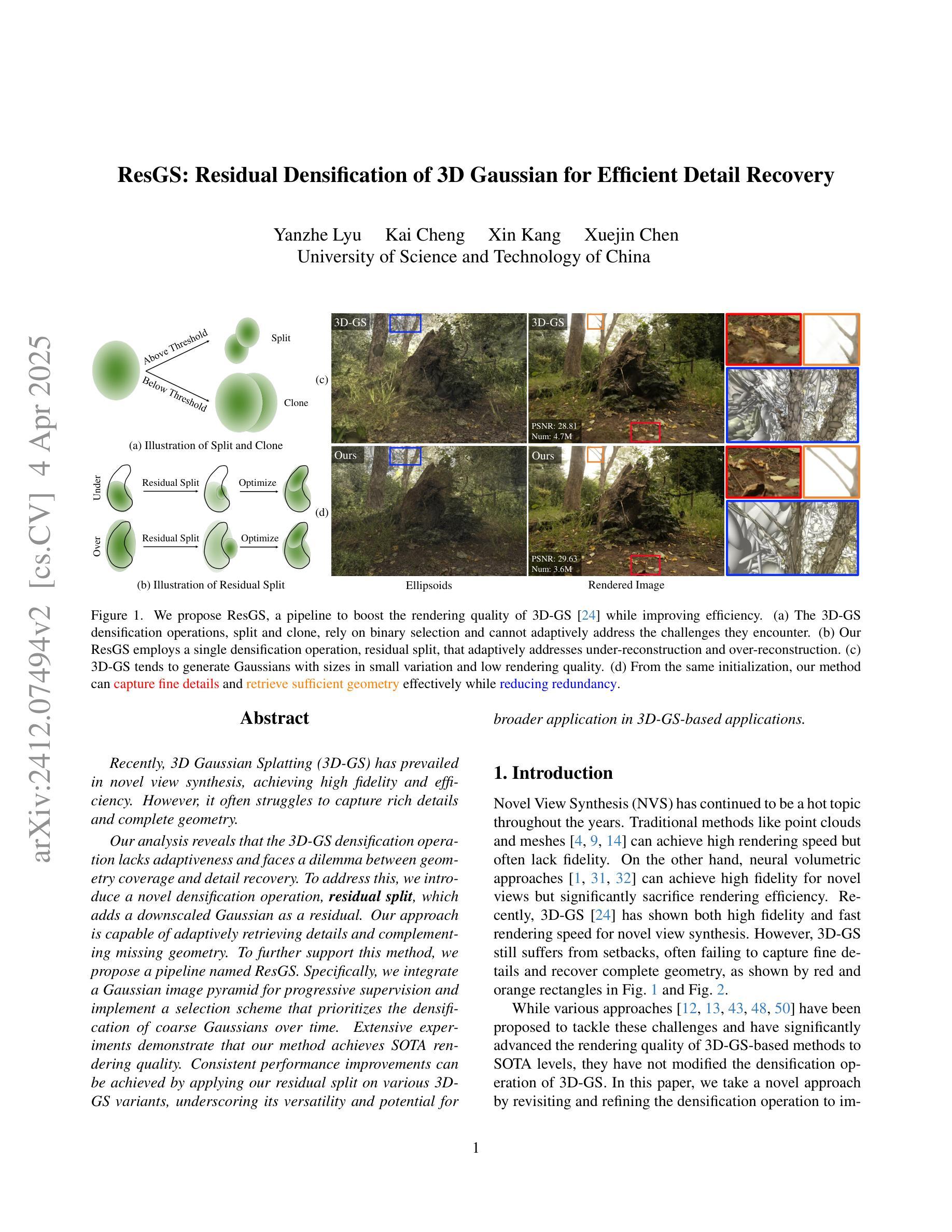

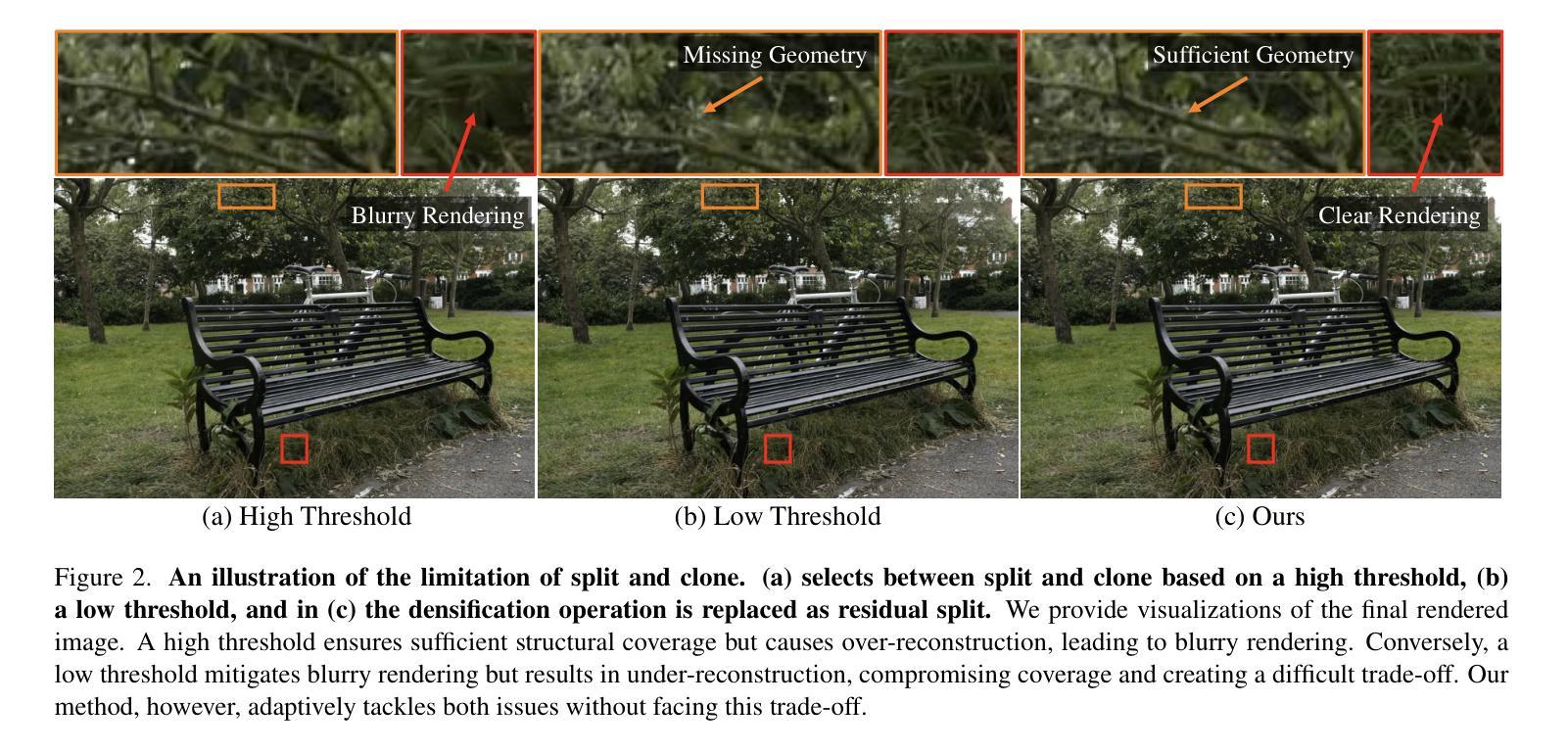

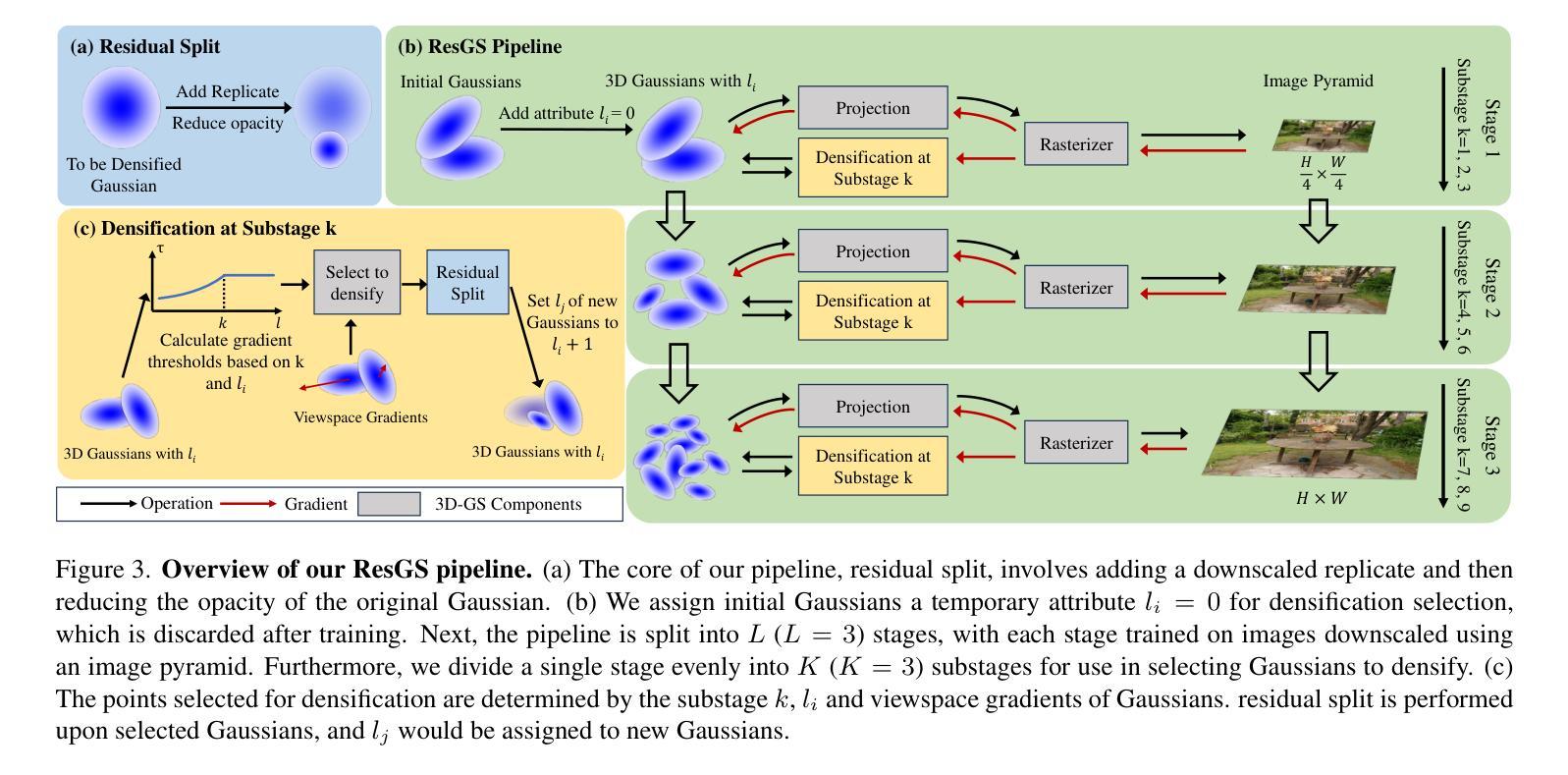

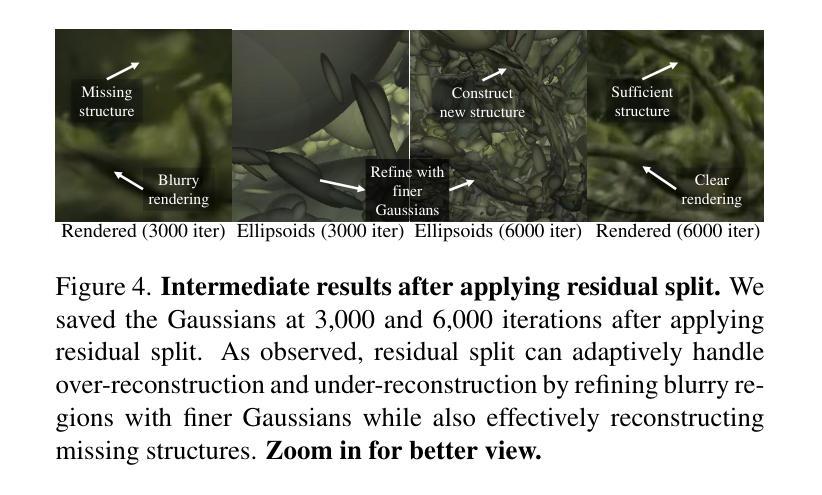

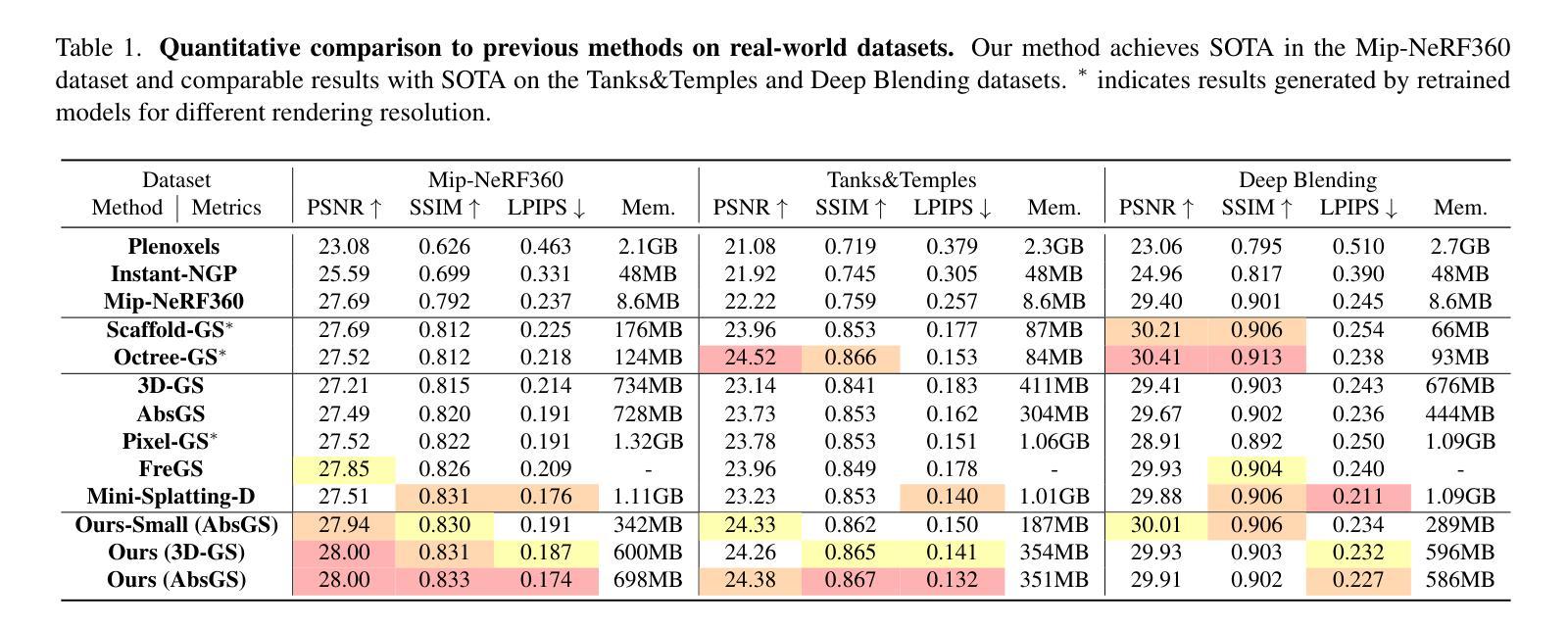

Recently, 3D Gaussian Splatting (3D-GS) has prevailed in novel view synthesis, achieving high fidelity and efficiency. However, it often struggles to capture rich details and complete geometry. Our analysis reveals that the 3D-GS densification operation lacks adaptiveness and faces a dilemma between geometry coverage and detail recovery. To address this, we introduce a novel densification operation, residual split, which adds a downscaled Gaussian as a residual. Our approach is capable of adaptively retrieving details and complementing missing geometry. To further support this method, we propose a pipeline named ResGS. Specifically, we integrate a Gaussian image pyramid for progressive supervision and implement a selection scheme that prioritizes the densification of coarse Gaussians over time. Extensive experiments demonstrate that our method achieves SOTA rendering quality. Consistent performance improvements can be achieved by applying our residual split on various 3D-GS variants, underscoring its versatility and potential for broader application in 3D-GS-based applications.

最近,3D高斯拼接(3D-GS)在新视角合成中盛行,实现了高保真和高效性。然而,它往往难以捕捉丰富的细节和完整的几何结构。我们的分析表明,3D-GS的稠密化操作缺乏适应性,面临几何覆盖与细节恢复的困境。为了解决这个问题,我们引入了一种新型的稠密化操作——残差分割,其通过添加降尺度的高斯残差来实现。我们的方法能够自适应地检索细节并补充缺失的几何结构。为了进一步支持此方法,我们提出了一种名为ResGS的管道。具体来说,我们集成了高斯图像金字塔进行渐进式监督,并实施了一种选择方案,该方案优先对粗糙高斯进行长期的稠密化。大量实验表明,我们的方法达到了最先进的渲染质量。将我们的残差分割应用于各种3D-GS变体,可以实现持续的性能改进,这突显了其在基于3D-GS的更广泛应用中的通用性和潜力。

论文及项目相关链接

摘要

本文介绍了在新型视图合成中流行的3D高斯拼贴(3D-GS)技术面临的挑战,即难以捕捉丰富的细节和完整的几何结构。分析表明,3D-GS的密集化操作缺乏适应性,在几何覆盖和细节恢复之间面临困境。为解决这一问题,本文提出了一种新型的密集化操作——残差分割,通过添加降维高斯作为残差来适应性地恢复细节并补充缺失的几何信息。为进一步支持该方法,本文提出了名为ResGS的管道,集成了高斯图像金字塔进行渐进监督,并实现了优先选择随时间对粗糙高斯进行密集化的选择方案。实验表明,该方法达到了先进的渲染质量,并且在各种3D-GS变体上应用我们的残差分割方法可以实现一致的性能提升,证明了其在3D-GS应用中的通用性和潜力。

关键见解

- 3D高斯拼贴(3D-GS)在新型视图合成中取得了高保真度和效率,但难以捕捉丰富的细节和完整的几何结构。

- 现有方法中的密集化操作缺乏适应性,在几何覆盖和细节恢复之间存在困境。

- 引入了一种新的密集化操作——残差分割,通过添加降维高斯作为残差来优化性能。

- 提出了一种名为ResGS的新型管道,通过集成高斯图像金字塔进行渐进监督来支持该方法。

- 实现了优先选择对粗糙高斯进行密集化的选择方案,以随时间优化性能。

- 实验表明,该方法达到了先进的渲染质量,并在各种3D-GS变体上实现了性能提升。

点此查看论文截图

PyTorchGeoNodes: Enabling Differentiable Shape Programs for 3D Shape Reconstruction

Authors:Sinisa Stekovic, Arslan Artykov, Stefan Ainetter, Mattia D’Urso, Friedrich Fraundorfer

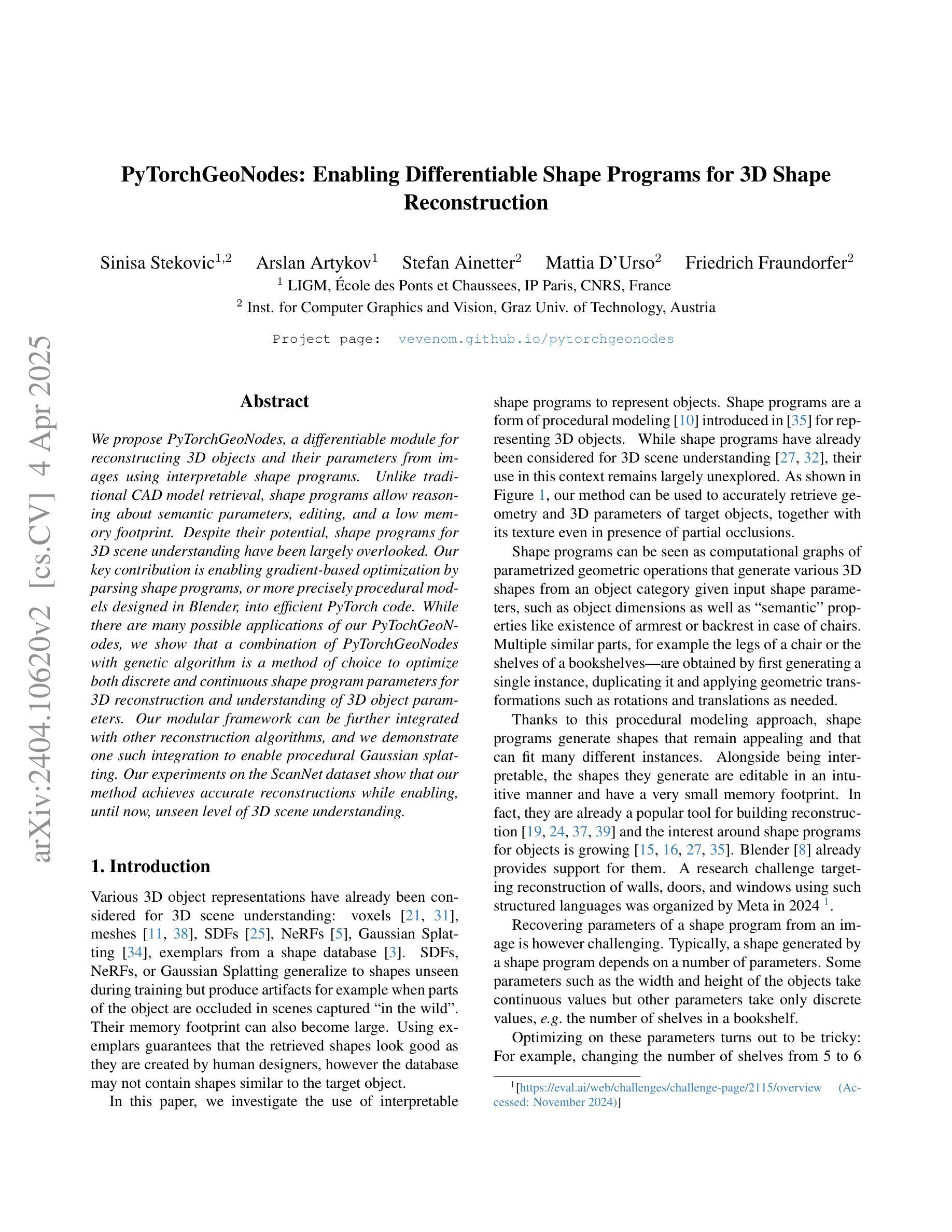

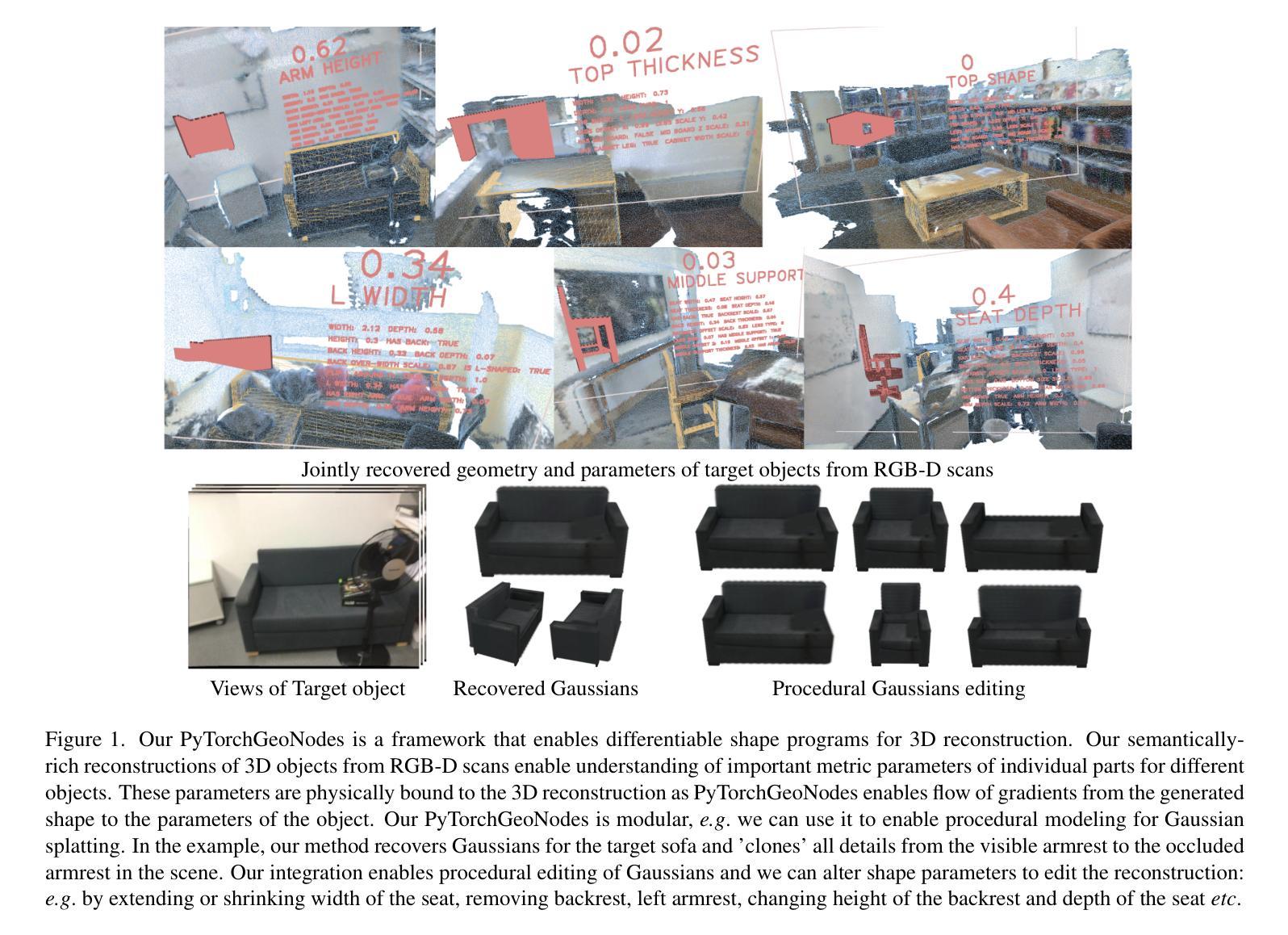

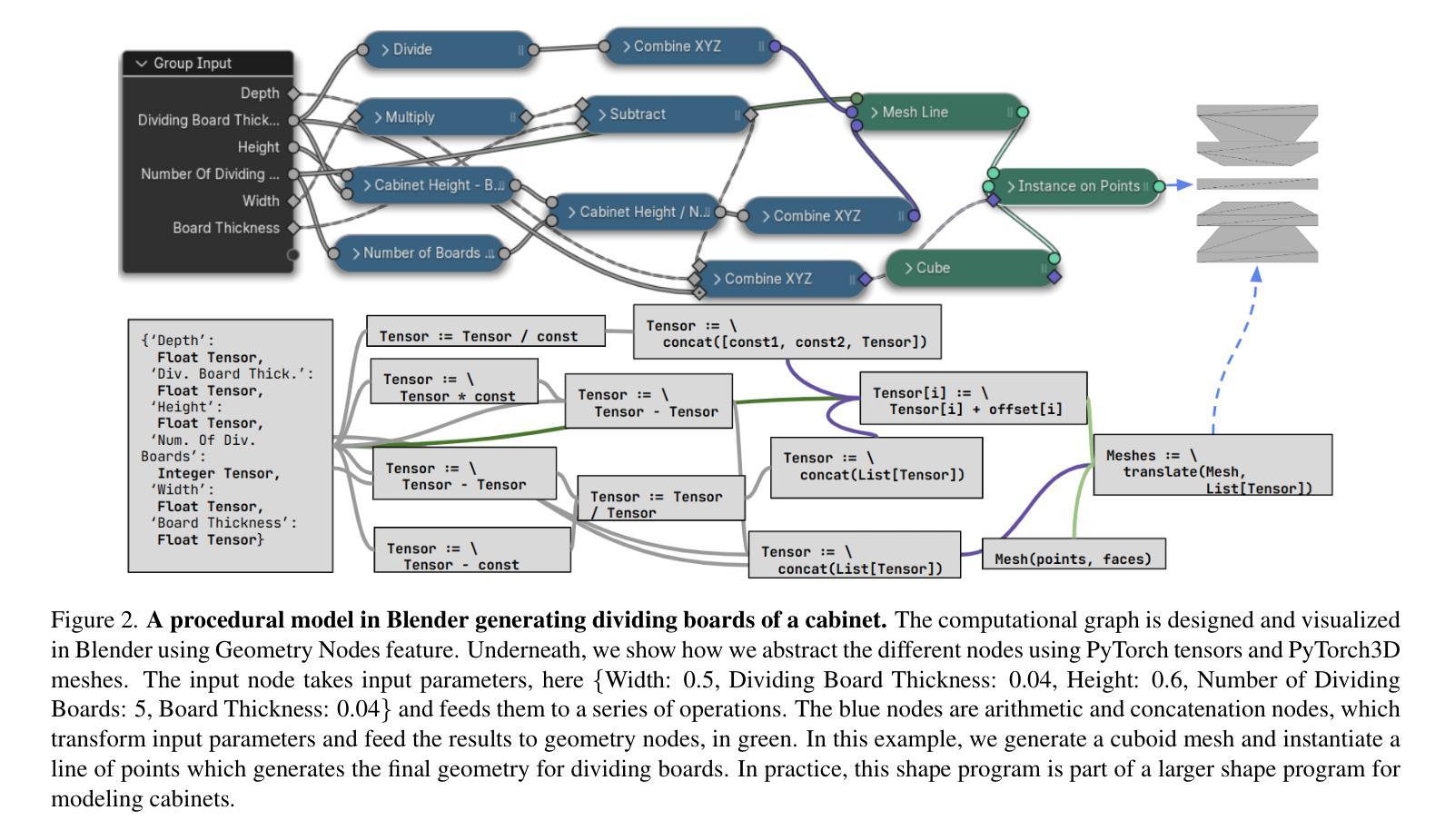

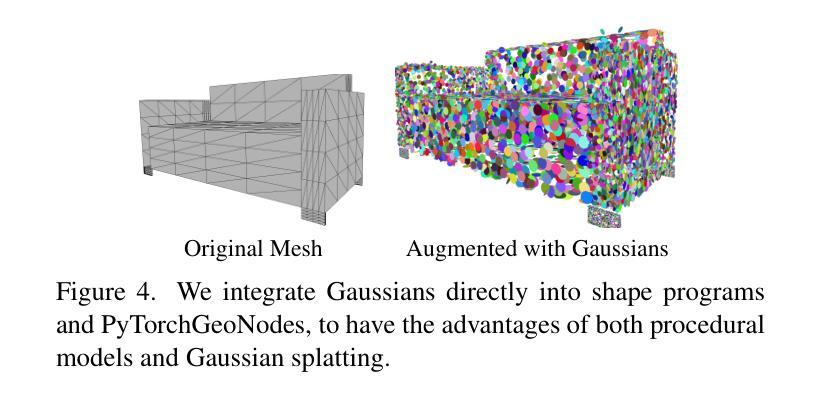

We propose PyTorchGeoNodes, a differentiable module for reconstructing 3D objects and their parameters from images using interpretable shape programs. Unlike traditional CAD model retrieval, shape programs allow reasoning about semantic parameters, editing, and a low memory footprint. Despite their potential, shape programs for 3D scene understanding have been largely overlooked. Our key contribution is enabling gradient-based optimization by parsing shape programs, or more precisely procedural models designed in Blender, into efficient PyTorch code. While there are many possible applications of our PyTochGeoNodes, we show that a combination of PyTorchGeoNodes with genetic algorithm is a method of choice to optimize both discrete and continuous shape program parameters for 3D reconstruction and understanding of 3D object parameters. Our modular framework can be further integrated with other reconstruction algorithms, and we demonstrate one such integration to enable procedural Gaussian splatting. Our experiments on the ScanNet dataset show that our method achieves accurate reconstructions while enabling, until now, unseen level of 3D scene understanding.

我们提出PyTorchGeoNodes,这是一个可微分的模块,可以通过解释性的形状程序从图像重建3D对象及其参数。不同于传统的CAD模型检索,形状程序允许对语义参数进行推理、编辑,并且具有较低的内存占用。尽管形状程序在3D场景理解方面具有潜力,但尚未得到广泛重视。我们的主要贡献是通过解析形状程序或更精确的是在Blender中设计的程序模型,将其转化为有效的PyTorch代码,从而实现基于梯度的优化。虽然PyTorchGeoNodes有许多可能的应用,但我们发现将其与遗传算法相结合是优化离散和连续形状程序参数进行3D重建和了解3D对象参数的首选方法。我们的模块化框架可以与其他重建算法进一步集成,我们展示了一个这样的集成,以实现程序化的高斯涂抹(splatting)。我们在ScanNet数据集上的实验表明,我们的方法实现了准确的重建,同时实现了迄今为止尚未出现的3D场景理解水平。

论文及项目相关链接

PDF Accepted at CVPR

Summary

本文介绍了PyTorchGeoNodes这一可微模块,该模块可从图像中重建3D对象及其参数,并使用可解释的形状程序进行操作。与传统CAD模型检索不同,形状程序允许对语义参数进行推理、编辑,且占用内存较小。本文的关键贡献在于通过解析形状程序(或在Blender中设计的程序模型)将其转化为高效的PyTorch代码,从而实现基于梯度的优化。实验表明,PyTorchGeoNodes与遗传算法的结合是优化离散和连续形状程序参数进行3D重建和理解3D对象参数的首选方法。该模块化框架可与其他重建算法进一步集成,我们展示了一种集成方法以启用程序化高斯采样。在ScanNet数据集上的实验表明,该方法实现了准确的重建,并实现了前所未有的3D场景理解水平。

Key Takeaways

- PyTorchGeoNodes是一个可微模块,能够从图像中重建3D对象及其参数,并使用形状程序进行操作。

- 形状程序允许对语义参数进行推理、编辑,且占用内存较小。

- 本文实现了通过解析形状程序将其转化为高效的PyTorch代码,从而实现基于梯度的优化。

- PyTorchGeoNodes与遗传算法结合是优化形状程序参数进行3D重建和理解的首选方法。

- 该模块化框架可与其他重建算法集成。

- 展示了一种集成方法以启用程序化高斯采样。

点此查看论文截图