⚠️ 以下所有内容总结都来自于 大语言模型的能力,如有错误,仅供参考,谨慎使用

🔴 请注意:千万不要用于严肃的学术场景,只能用于论文阅读前的初筛!

💗 如果您觉得我们的项目对您有帮助 ChatPaperFree ,还请您给我们一些鼓励!⭐️ HuggingFace免费体验

2025-04-29 更新

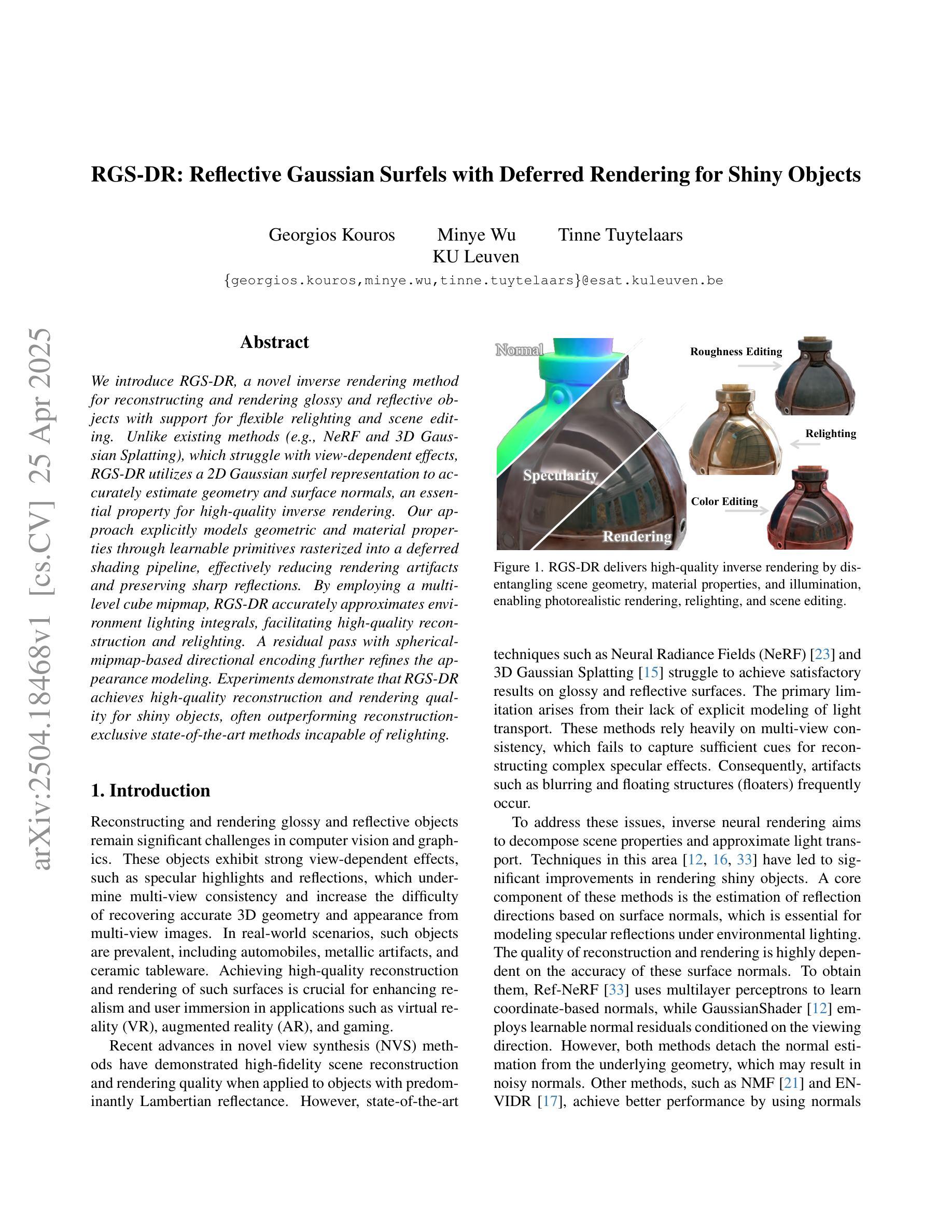

RGS-DR: Reflective Gaussian Surfels with Deferred Rendering for Shiny Objects

Authors:Georgios Kouros, Minye Wu, Tinne Tuytelaars

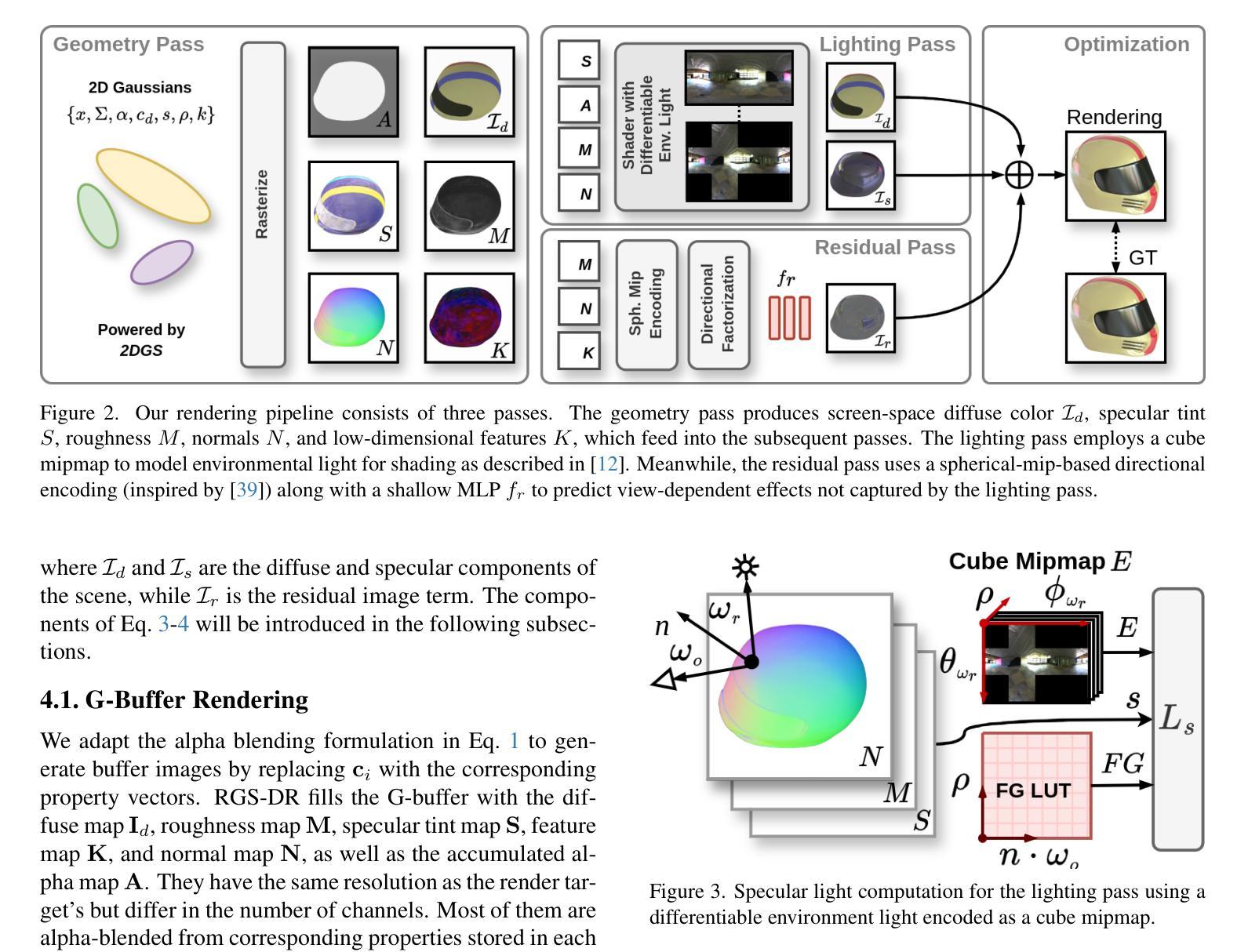

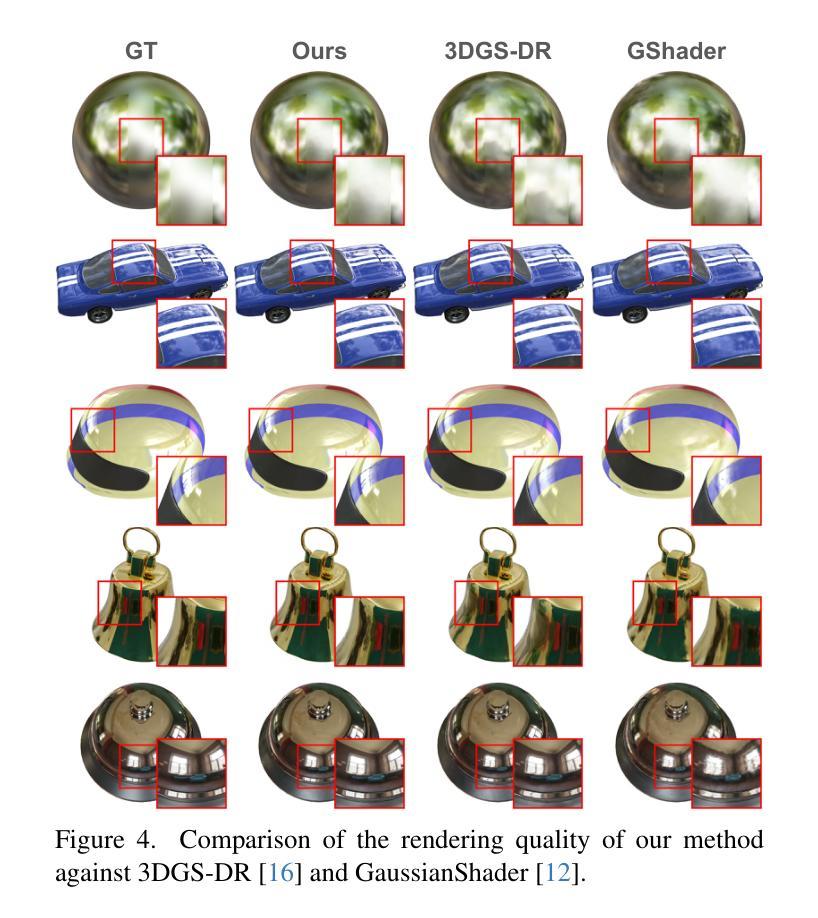

We introduce RGS-DR, a novel inverse rendering method for reconstructing and rendering glossy and reflective objects with support for flexible relighting and scene editing. Unlike existing methods (e.g., NeRF and 3D Gaussian Splatting), which struggle with view-dependent effects, RGS-DR utilizes a 2D Gaussian surfel representation to accurately estimate geometry and surface normals, an essential property for high-quality inverse rendering. Our approach explicitly models geometric and material properties through learnable primitives rasterized into a deferred shading pipeline, effectively reducing rendering artifacts and preserving sharp reflections. By employing a multi-level cube mipmap, RGS-DR accurately approximates environment lighting integrals, facilitating high-quality reconstruction and relighting. A residual pass with spherical-mipmap-based directional encoding further refines the appearance modeling. Experiments demonstrate that RGS-DR achieves high-quality reconstruction and rendering quality for shiny objects, often outperforming reconstruction-exclusive state-of-the-art methods incapable of relighting.

我们介绍了RGS-DR,这是一种新型逆向渲染方法,用于重建和呈现具有光泽和反射特性的物体,支持灵活的重新打光和场景编辑。与现有方法(例如NeRF和3D高斯平铺)相比,后者在处理视图相关效果时遇到困难,RGS-DR利用2D高斯surfel表示法准确估计几何和表面法线,这是高质量逆向渲染的基本属性。我们的方法通过可学习的原始元素显式建模几何和材料属性,并将其栅格化到延迟着色管道中,有效地减少了渲染伪影并保留了锐利的反射。通过采用多层次立方体mipmap,RGS-DR能够准确近似环境光照积分,从而实现高质量的重建和重新打光。使用基于球面mipmap的方向编码的残差传递进一步细化了外观建模。实验表明,RGS-DR在光泽物体的重建和渲染质量方面达到高水平,经常超越只具备重建功能的最先进方法,而这些先进方法不支持重新打光。

论文及项目相关链接

Summary

高光泽和反射物体的新型逆向渲染方法RGS-DR。不同于NeRF和3D高斯碎块等处理视图相关效果时存在困难的方法,RGS-DR使用2D高斯表面表示法准确估计几何和表面法线,这是高质量逆向渲染的关键属性。通过可学习的原始几何和材料属性进行光线投射并用于延迟着色管道,有效地减少渲染伪影并保留清晰的反射。使用多层立方体mipmap近似环境光照积分,实现高质量重建和重新照明。采用基于球面mipmap的方向编码残差传递进一步优化外观建模。实验表明,RGS-DR对高光泽物体实现高质量重建和渲染,常常优于不能重新打光的专属重建的当前技术。

Key Takeaways

- RGS-DR是一种新型逆向渲染方法,特别适用于高光泽和反射物体的重建和渲染。

- RGS-DR使用2D高斯表面表示法准确估计几何和表面法线,以提升渲染质量。

- 与现有方法相比,RGS-DR能更有效地处理视图相关效果。

- RGS-DR采用光线投射和延迟着色管道,减少渲染伪影并保留清晰反射。

- 使用多层立方体mipmap近似环境光照积分,实现高质量重建和重新照明。

- RGS-DR包括一个基于球面mipmap的方向编码残差传递,进一步优化外观建模。

点此查看论文截图

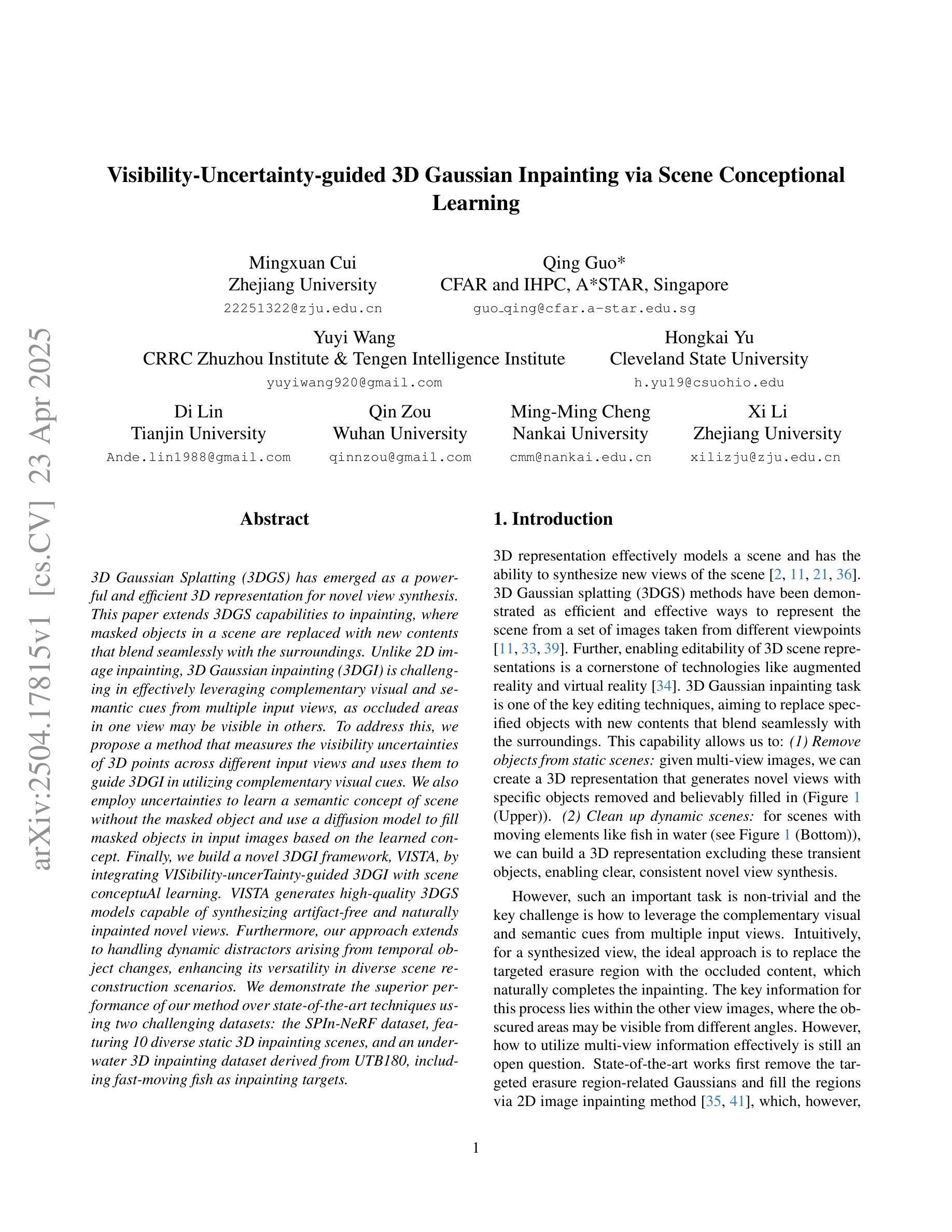

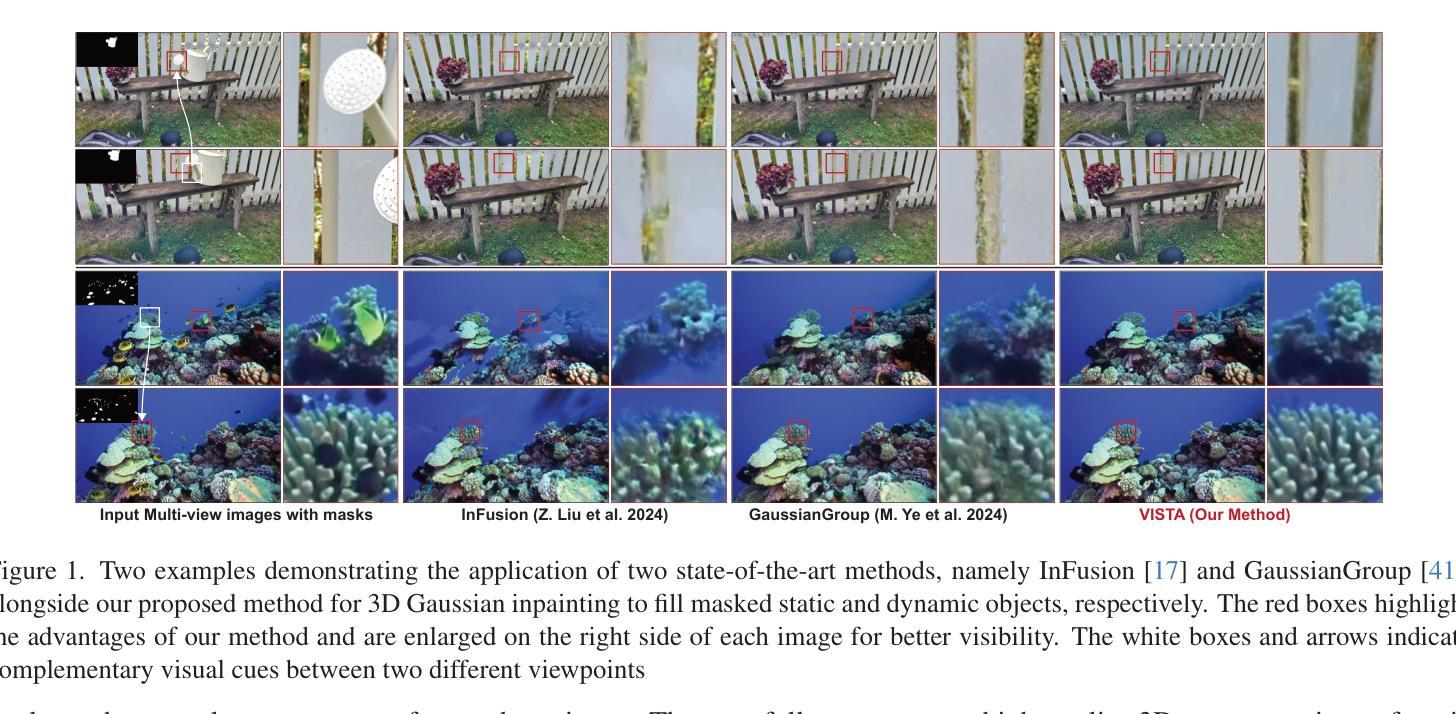

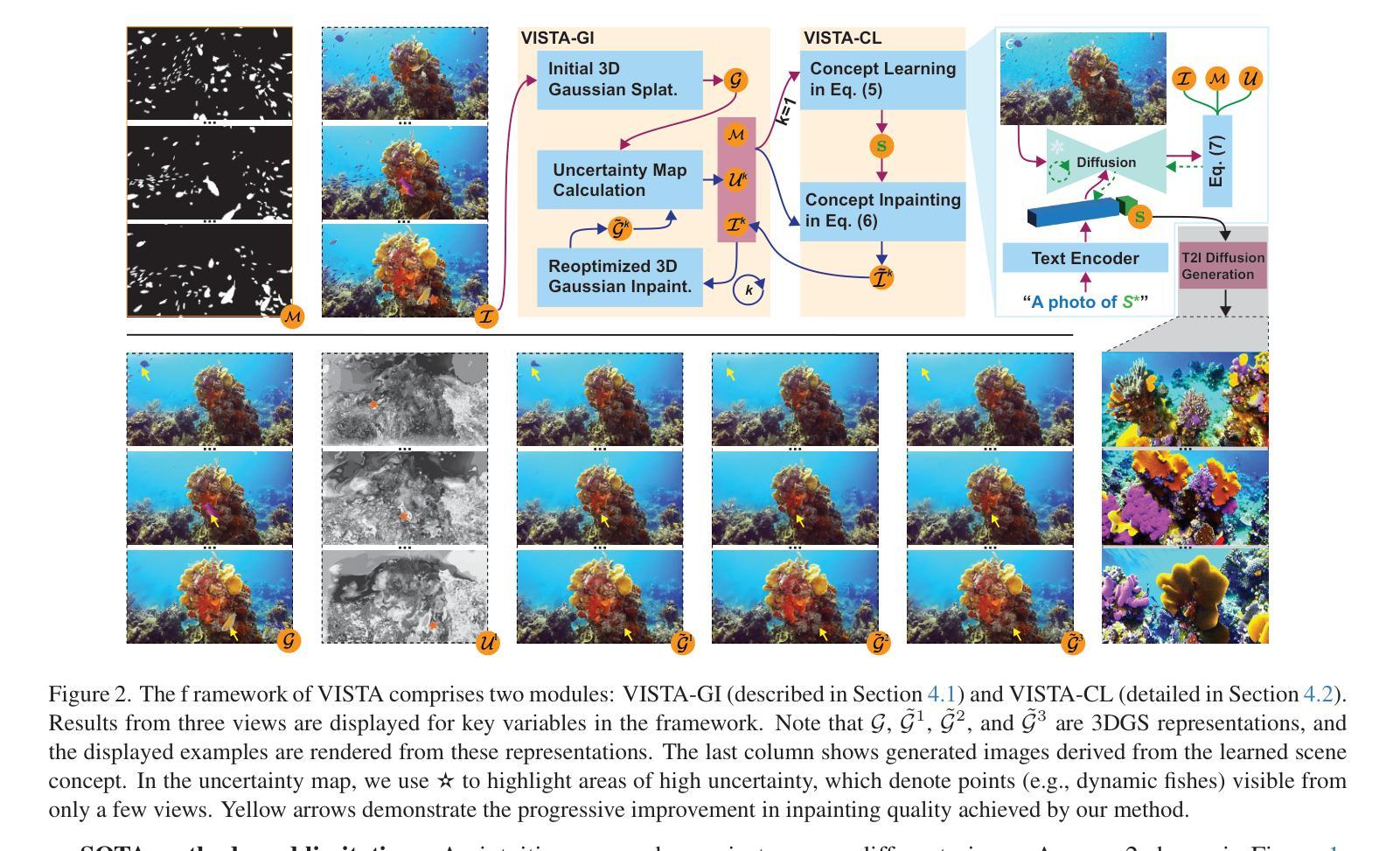

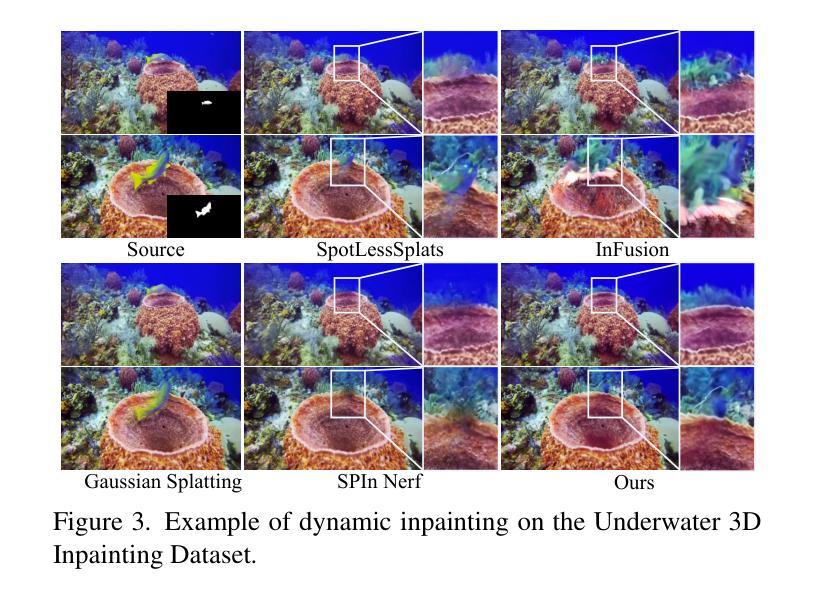

Visibility-Uncertainty-guided 3D Gaussian Inpainting via Scene Conceptional Learning

Authors:Mingxuan Cui, Qing Guo, Yuyi Wang, Hongkai Yu, Di Lin, Qin Zou, Ming-Ming Cheng, Xi Li

3D Gaussian Splatting (3DGS) has emerged as a powerful and efficient 3D representation for novel view synthesis. This paper extends 3DGS capabilities to inpainting, where masked objects in a scene are replaced with new contents that blend seamlessly with the surroundings. Unlike 2D image inpainting, 3D Gaussian inpainting (3DGI) is challenging in effectively leveraging complementary visual and semantic cues from multiple input views, as occluded areas in one view may be visible in others. To address this, we propose a method that measures the visibility uncertainties of 3D points across different input views and uses them to guide 3DGI in utilizing complementary visual cues. We also employ uncertainties to learn a semantic concept of scene without the masked object and use a diffusion model to fill masked objects in input images based on the learned concept. Finally, we build a novel 3DGI framework, VISTA, by integrating VISibility-uncerTainty-guided 3DGI with scene conceptuAl learning. VISTA generates high-quality 3DGS models capable of synthesizing artifact-free and naturally inpainted novel views. Furthermore, our approach extends to handling dynamic distractors arising from temporal object changes, enhancing its versatility in diverse scene reconstruction scenarios. We demonstrate the superior performance of our method over state-of-the-art techniques using two challenging datasets: the SPIn-NeRF dataset, featuring 10 diverse static 3D inpainting scenes, and an underwater 3D inpainting dataset derived from UTB180, including fast-moving fish as inpainting targets.

三维高斯绘制(3DGS)已经成为一种强大而高效的三维表示技术,用于合成新型视图。本文扩展了3DGS的功能,将其应用于图像修复,其中场景中的遮挡对象被新的内容所替换,这些新内容可以无缝地融入周围环境中。与二维图像修复不同,三维高斯图像修复(3DGI)在有效利用来自多个输入视图的辅助视觉和语义线索方面更具挑战性,因为一个视图中的遮挡区域可能在其他视图中是可见的。为了解决这一问题,我们提出了一种方法,该方法可以测量不同输入视图中三维点的可见性不确定性,并利用这些不确定性来指导3DGI在利用辅助视觉线索时的决策。我们还利用不确定性来学习场景中遮挡对象缺失的语义概念,并使用扩散模型基于学习到的概念来填充输入图像中的遮挡对象。最后,我们通过整合受可见性不确定性引导的三维高斯图像修复(VISI)与场景概念学习,构建了一个新型的三维图像修复框架VISTA。VISTA生成的高质量三维高斯绘制模型能够合成无伪影、自然修复的新视图。此外,我们的方法还扩展到处理由时间变化对象产生的动态干扰因素,提高了其在多种场景重建场景中的通用性。我们在两个具有挑战性的数据集上展示了我们的方法相较于最新技术的优越性:SPIn-NeRF数据集包含10个多样化的静态三维修复场景;以及从UTB180派生的水下三维修复数据集,其中包括快速移动的鱼类作为修复目标。

论文及项目相关链接

PDF 14 pages, 12 figures, ICCV

Summary

在三维场景表示中,论文通过引入三维高斯填充(3DGI)扩展了三维高斯展铺(3DGS)的能力,实现了遮罩对象的无缝替换。论文提出了一种方法,通过测量不同输入视图中三维点的可见性不确定性来指导三维填充利用互补的视觉线索,并利用不确定性学习场景概念,采用扩散模型基于学习到的概念填充遮罩对象。最后构建了一个新颖的三维填充框架VISTA,可生成高质量的三维表示模型,并能处理动态干扰因素。论文采用两个挑战数据集展示方法的优势。

Key Takeaways

- 该论文成功将三维高斯展铺(3DGS)扩展到三维高斯填充(3DGI),实现了场景中的遮罩对象替换。

- 论文通过测量不同输入视图中三维点的可见性不确定性,解决了遮挡区域的挑战。

- 利用可见性不确定性指导三维填充利用互补视觉线索和场景概念学习。

- 采用扩散模型基于学习到的场景概念填充遮罩对象,生成高质量的三维表示模型。

- 构建了一个新颖的三维填充框架VISTA,能够合成无伪影、自然填充的新视角。

- 该方法能够处理动态干扰因素,增强了在不同场景重建中的通用性。

点此查看论文截图

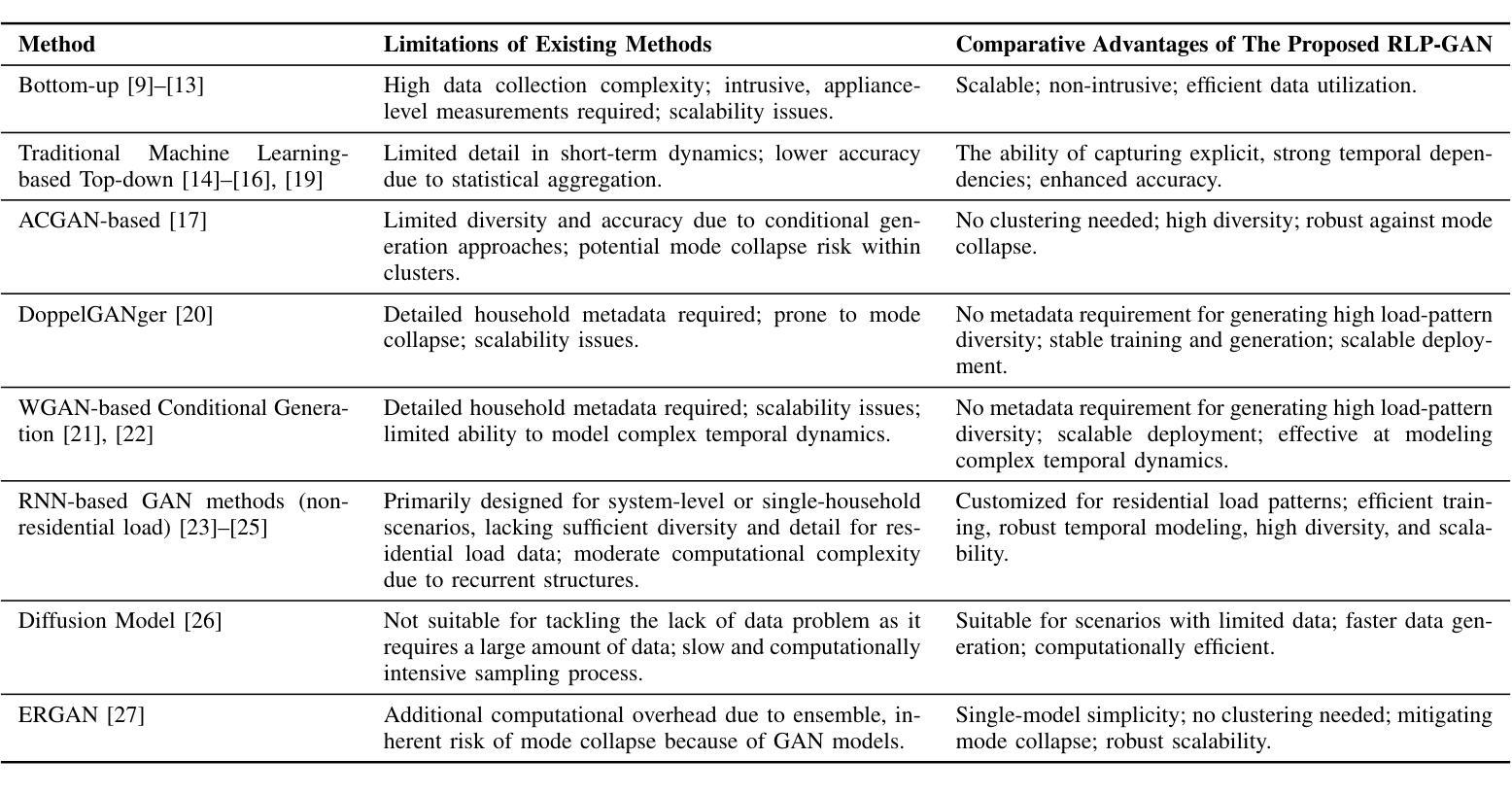

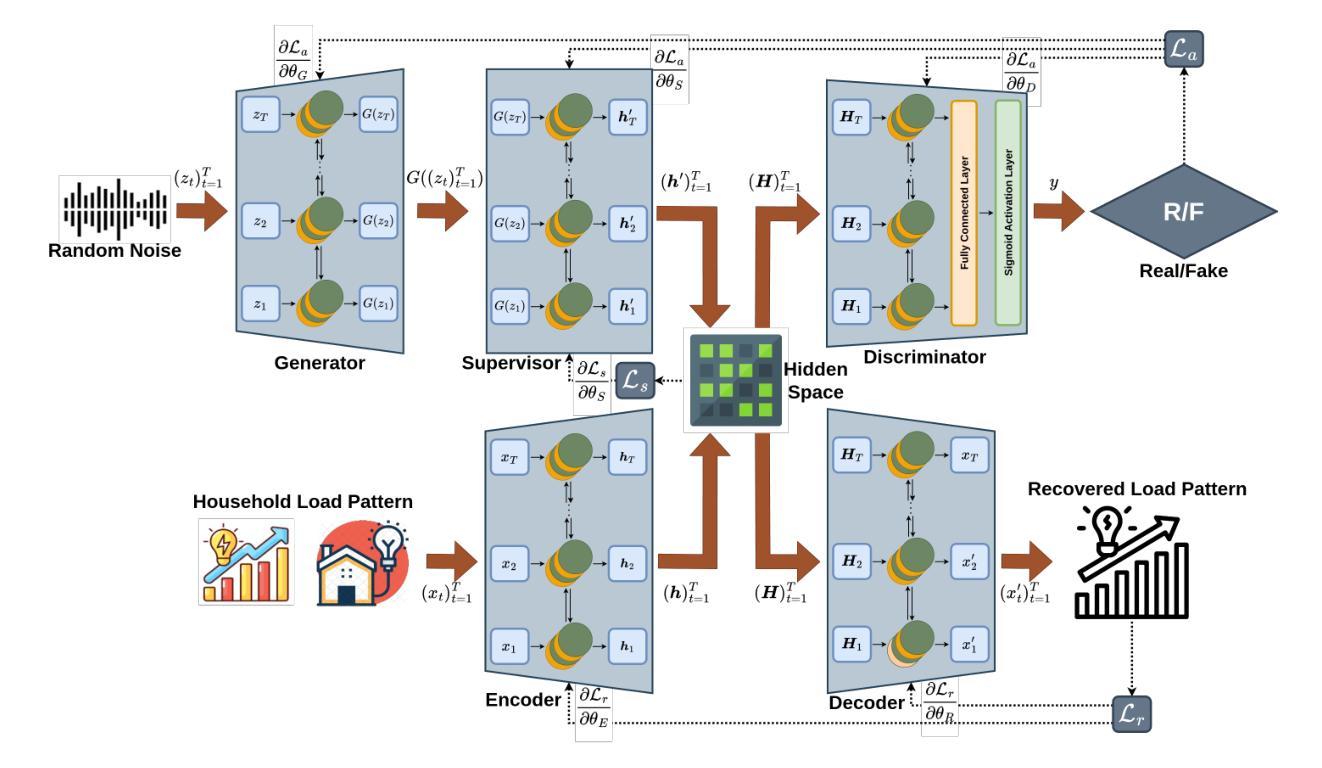

Learning and Generating Diverse Residential Load Patterns Using GAN with Weakly-Supervised Training and Weight Selection

Authors:Xinyu Liang, Hao Wang

The scarcity of high-quality residential load data can pose obstacles for decarbonizing the residential sector as well as effective grid planning and operation. The above challenges have motivated research into generating synthetic load data, but existing methods faced limitations in terms of scalability, diversity, and similarity. This paper proposes a Generative Adversarial Network-based Synthetic Residential Load Pattern (RLP-GAN) generation model, a novel weakly-supervised GAN framework, leveraging an over-complete autoencoder to capture dependencies within complex and diverse load patterns and learn household-level data distribution at scale. We incorporate a model weight selection method to address the mode collapse problem and generate load patterns with high diversity. We develop a holistic evaluation method to validate the effectiveness of RLP-GAN using real-world data of 417 households. The results demonstrate that RLP-GAN outperforms state-of-the-art models in capturing temporal dependencies and generating load patterns with higher similarity to real data. Furthermore, we have publicly released the RLP-GAN generated synthetic dataset, which comprises one million synthetic residential load pattern profiles.

高质量住宅用电负荷数据的稀缺性对住宅领域的脱碳以及电网的有效规划和运行都构成了障碍。上述挑战推动了合成负荷数据生成的研究,但现有方法在可扩展性、多样性和相似性方面存在局限。本文提出了一种基于生成对抗网络(GAN)的合成住宅负荷模式生成模型(RLP-GAN),这是一个新型弱监督GAN框架,利用过完备自编码器捕捉复杂多样负荷模式内的依赖关系,并在大规模上学习家庭级别的数据分布。我们引入了一种模型权重选择方法来解决模式崩溃问题,并生成具有极高多样性的负荷模式。我们使用一种全面的评估方法,利用来自417户家庭的现实世界数据验证了RLP-GAN的有效性。结果表明,RLP-GAN在捕捉时间依赖性方面优于当前主流模型,生成的负荷模式与真实数据具有较高相似性。此外,我们已经公开发布了由RLP-GAN生成的合成数据集,该数据集包含一百万份合成住宅负荷模式分析文件。

论文及项目相关链接

PDF 12 pages

Summary

利用生成对抗网络(GAN)技术,结合过完备自编码器,提出了一种基于弱监督的住宅负荷模式生成模型(RLP-GAN)。该模型能够捕捉复杂多样的负荷模式中的依赖关系,大规模学习家庭级别的数据分布。通过一种全面的评估方法验证其有效性,并利用真实世界数据生成负荷模式以应对数据稀缺问题。结果显示,RLP-GAN在捕捉时间依赖性方面优于其他模型,生成的负荷模式与真实数据高度相似。同时公开了由RLP-GAN生成的合成数据集。

Key Takeaways

- 住宅负荷数据的稀缺性对住宅部门的脱碳以及电网的有效规划和运营构成了挑战。

- 提出了一种基于生成对抗网络(GAN)的住宅负荷模式生成模型(RLP-GAN),该模型是弱监督的。

- RLP-GAN利用过完备自编码器捕捉复杂负荷模式中的依赖关系,并大规模学习家庭级别数据分布。

- RLP-GAN通过一种全面的评估方法验证其有效性,使用真实世界数据对模型进行评估。

- RLP-GAN在捕捉时间依赖性方面优于其他模型,生成的负荷模式与真实数据高度相似。

- RLP-GAN解决了现有方法面临的可扩展性、多样性和相似性的局限性。

点此查看论文截图

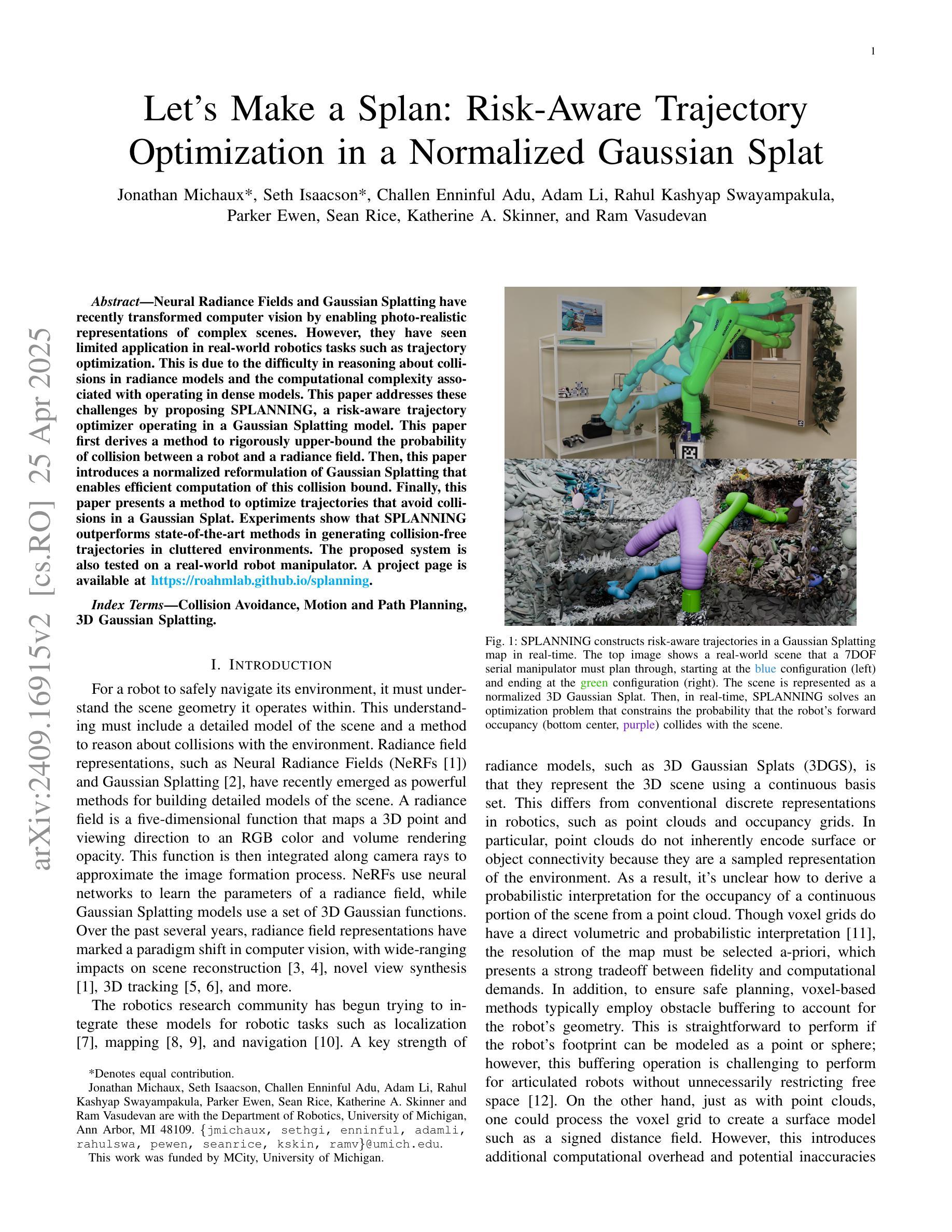

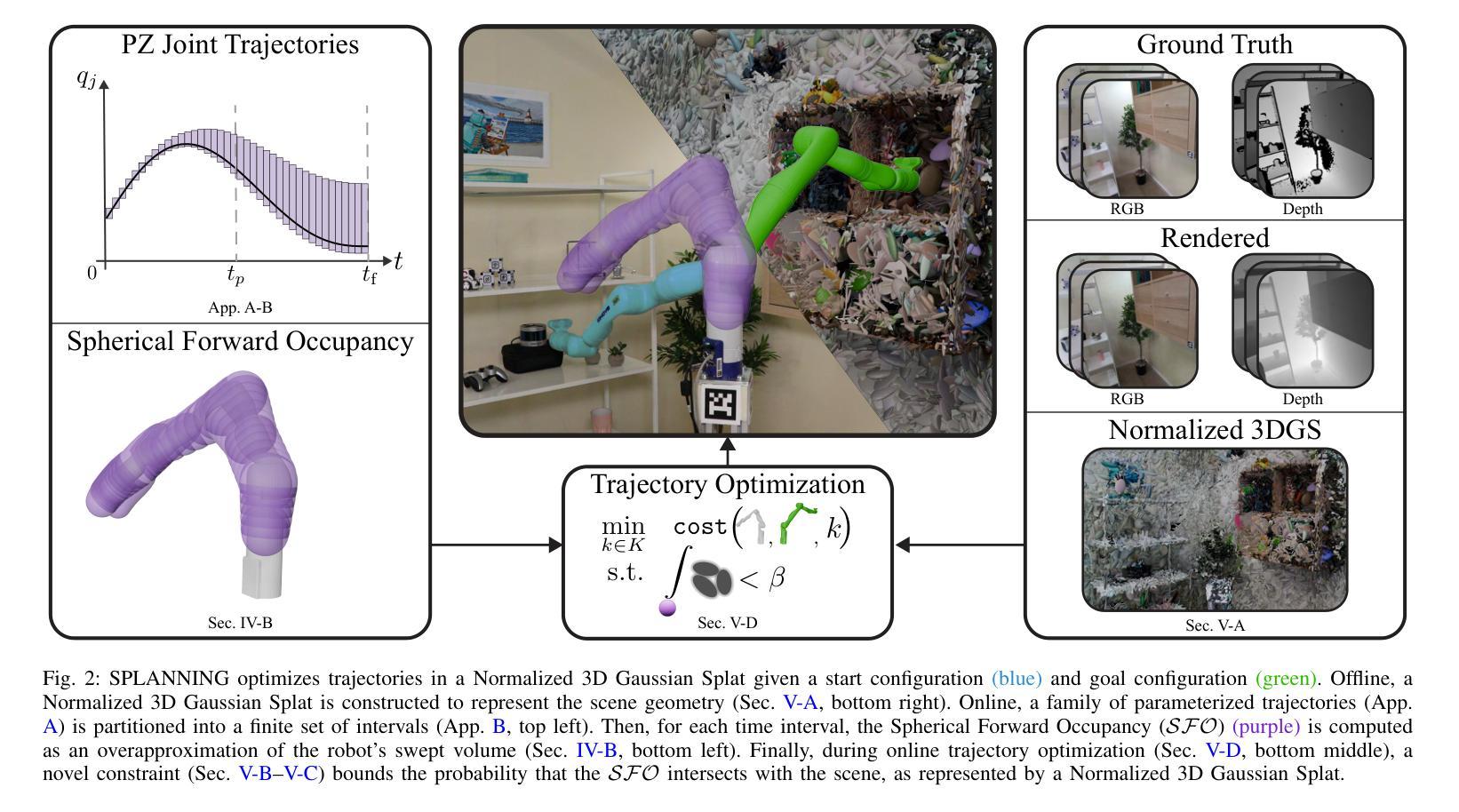

Let’s Make a Splan: Risk-Aware Trajectory Optimization in a Normalized Gaussian Splat

Authors:Jonathan Michaux, Seth Isaacson, Challen Enninful Adu, Adam Li, Rahul Kashyap Swayampakula, Parker Ewen, Sean Rice, Katherine A. Skinner, Ram Vasudevan

Neural Radiance Fields and Gaussian Splatting have recently transformed computer vision by enabling photo-realistic representations of complex scenes. However, they have seen limited application in real-world robotics tasks such as trajectory optimization. This is due to the difficulty in reasoning about collisions in radiance models and the computational complexity associated with operating in dense models. This paper addresses these challenges by proposing SPLANNING, a risk-aware trajectory optimizer operating in a Gaussian Splatting model. This paper first derives a method to rigorously upper-bound the probability of collision between a robot and a radiance field. Then, this paper introduces a normalized reformulation of Gaussian Splatting that enables efficient computation of this collision bound. Finally, this paper presents a method to optimize trajectories that avoid collisions in a Gaussian Splat. Experiments show that SPLANNING outperforms state-of-the-art methods in generating collision-free trajectories in cluttered environments. The proposed system is also tested on a real-world robot manipulator. A project page is available at https://roahmlab.github.io/splanning.

神经辐射场和高斯涂布技术最近通过实现复杂场景的光照现实主义表示,从而改变了计算机视觉领域。然而,它们在现实世界中的机器人任务(如轨迹优化)中的应用仍然有限,这是由于在辐射模型中推理碰撞的困难以及与在密集模型中进行操作相关的计算复杂性。本文通过提出SPLANNING(一种在高斯涂布模型中运行的风险感知轨迹优化器)来解决这些挑战。本文首先推导了一种方法来严格计算机器人与辐射场之间碰撞的概率上限。然后,本文介绍了高斯涂布的归一化重构,能够高效计算该碰撞边界。最后,本文提出了一种优化轨迹的方法,以避免在高斯涂布中的碰撞。实验表明,SPLANNING在杂乱环境中生成无碰撞轨迹方面的性能优于最先进的方法。所提出的系统也在实际机器人操纵器上进行了测试。项目页面可在https://roahmlab.github.io/splanning访问。

论文及项目相关链接

PDF First two authors contributed equally. Project Page: https://roahmlab.github.io/splanning

Summary

神经网络辐射场和高斯涂绘技术为计算机视觉领域带来了革命性的变革,实现了复杂场景的真实感表示。然而,它们在现实世界机器人任务中的应用仍然有限,如轨迹优化。这是由于在辐射模型中推理碰撞的困难以及与密集模型相关的计算复杂性。本文提出了SPLANNING方法来解决这些挑战,这是一种在Gaussian Splatting模型中进行的风险感知轨迹优化器。本文首先推导了一种方法来严格计算机器人与辐射场之间碰撞的概率上限。然后,本文介绍了Gaussian Splatting的归一化重新表述,这能够高效计算碰撞边界。最后,本文提出了一种在高斯涂绘环境中避免碰撞的优化轨迹方法。实验表明,SPLANNING在拥挤环境中生成无碰撞轨迹的方法优于现有技术。所提出的系统也在实际机器人操纵器上进行了测试。

Key Takeaways

- 神经网络辐射场和高斯涂绘技术为计算机视觉带来真实感场景表示的变革。

- 目前这些技术在机器人轨迹优化等实际应用中存在挑战,主要因为辐射模型中推理碰撞的困难和计算复杂性。

- SPLANNING方法解决了这些问题,是一种风险感知的轨迹优化器,在Gaussian Splatting模型中进行。

- 论文推导了计算机器人与辐射场碰撞概率上限的方法。

- 论文引入了Gaussian Splatting的归一化重新表述,能高效计算碰撞边界。

- 论文提出了优化轨迹的方法,能在高斯涂绘环境中避免碰撞。

- 实验证明SPLANNING在生成无碰撞轨迹方面优于现有技术,并在实际机器人操纵器上进行了测试。

点此查看论文截图