⚠️ 以下所有内容总结都来自于 大语言模型的能力,如有错误,仅供参考,谨慎使用

🔴 请注意:千万不要用于严肃的学术场景,只能用于论文阅读前的初筛!

💗 如果您觉得我们的项目对您有帮助 ChatPaperFree ,还请您给我们一些鼓励!⭐️ HuggingFace免费体验

2025-05-03 更新

Real-Time Animatable 2DGS-Avatars with Detail Enhancement from Monocular Videos

Authors:Xia Yuan, Hai Yuan, Wenyi Ge, Ying Fu, Xi Wu, Guanyu Xing

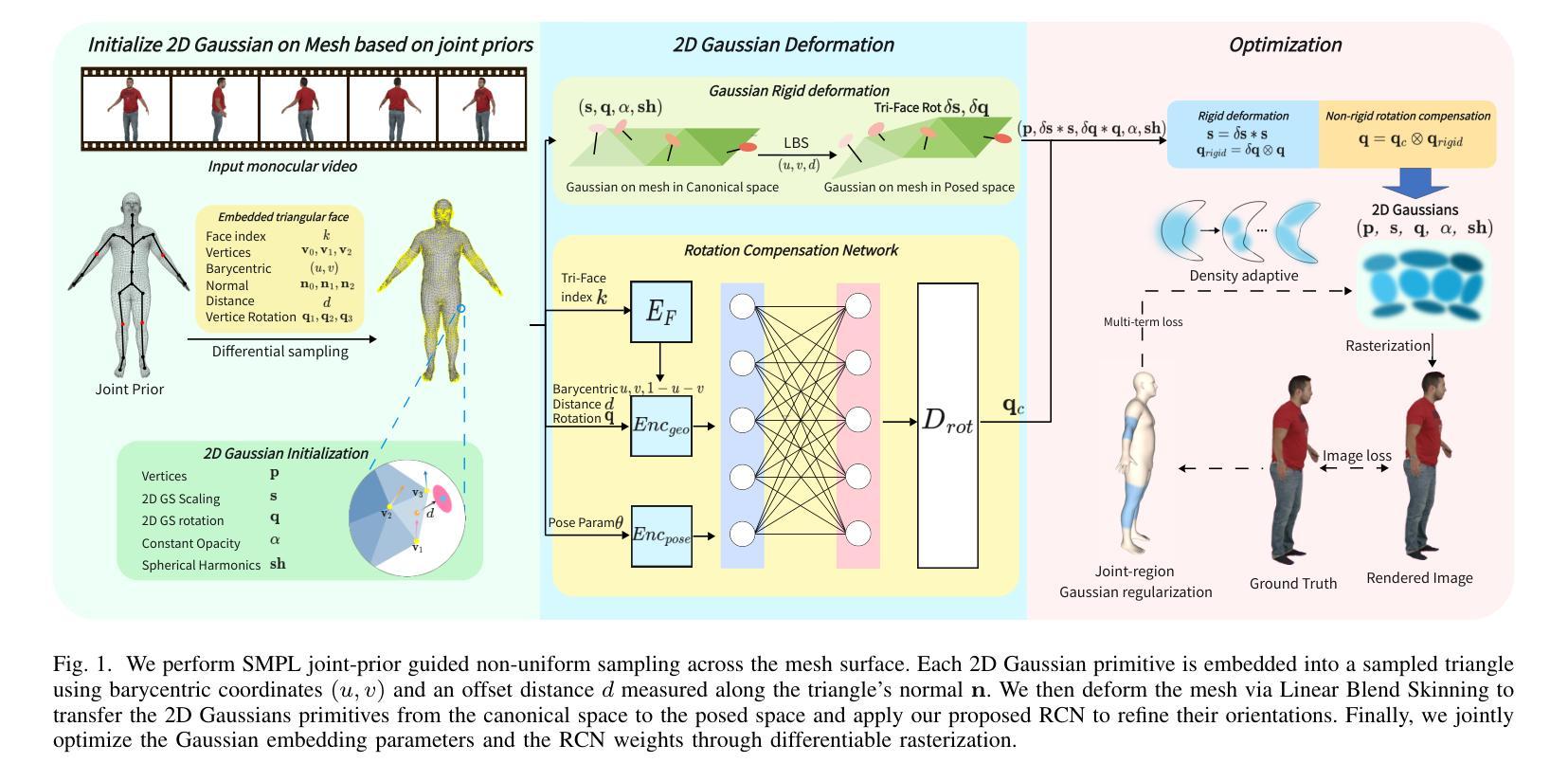

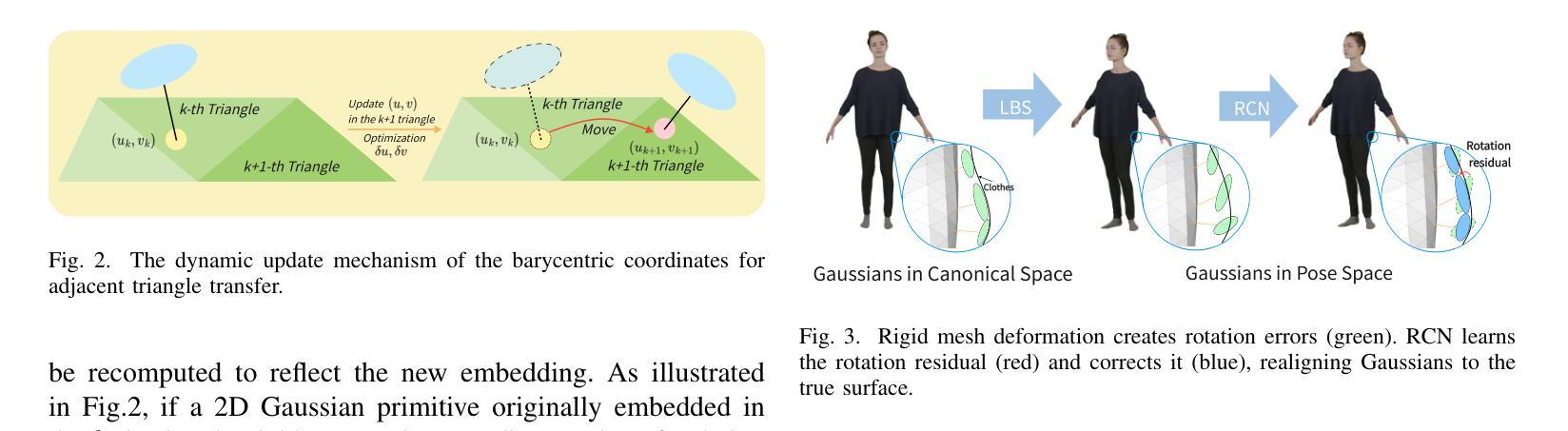

High-quality, animatable 3D human avatar reconstruction from monocular videos offers significant potential for reducing reliance on complex hardware, making it highly practical for applications in game development, augmented reality, and social media. However, existing methods still face substantial challenges in capturing fine geometric details and maintaining animation stability, particularly under dynamic or complex poses. To address these issues, we propose a novel real-time framework for animatable human avatar reconstruction based on 2D Gaussian Splatting (2DGS). By leveraging 2DGS and global SMPL pose parameters, our framework not only aligns positional and rotational discrepancies but also enables robust and natural pose-driven animation of the reconstructed avatars. Furthermore, we introduce a Rotation Compensation Network (RCN) that learns rotation residuals by integrating local geometric features with global pose parameters. This network significantly improves the handling of non-rigid deformations and ensures smooth, artifact-free pose transitions during animation. Experimental results demonstrate that our method successfully reconstructs realistic and highly animatable human avatars from monocular videos, effectively preserving fine-grained details while ensuring stable and natural pose variation. Our approach surpasses current state-of-the-art methods in both reconstruction quality and animation robustness on public benchmarks.

从单目视频中重建高质量、可动画的3D人类化身具有巨大的潜力,可以减少对复杂硬件的依赖,为游戏开发、增强现实和社交媒体等应用提供了高度的实用性。然而,现有方法仍然在捕捉精细几何细节和保持动画稳定性方面面临巨大挑战,特别是在动态或复杂姿势下。为了解决这些问题,我们提出了一种基于二维高斯溅出(2DGS)的可动画人类化身重建实时框架。通过利用二维高斯溅出和全局SMPL姿势参数,我们的框架不仅校正了位置和旋转偏差,还能实现重建化身姿态驱动的稳健和自然动画。此外,我们引入了一个旋转补偿网络(RCN),该网络通过整合局部几何特征与全局姿势参数来学习旋转残差。该网络极大地提高了对非刚性变形的处理能力,确保动画过程中姿态转换平滑无瑕疵。实验结果表明,我们的方法成功地从单目视频中重建出逼真且高度可动画的人类化身,在保留精细细节的同时确保了稳定和自然的姿态变化。我们的方法在公共基准测试上的重建质量和动画稳健性均超越了当前最先进的方法。

论文及项目相关链接

Summary

高质量、可动画的3D人类角色重建技术从单目视频中展现出巨大的潜力,可广泛应用于游戏开发、增强现实和社交媒体等领域。针对现有方法在捕捉精细几何细节和保持动画稳定性方面的挑战,我们提出了一种基于二维高斯泼溅(2DGS)技术的实时框架。该框架不仅解决了位置和方向差异的问题,还实现了对重建角色的健壮和自然的姿势驱动动画。同时,引入旋转补偿网络(RCN),通过学习旋转残差和集成局部几何特征,实现了平滑、无瑕疵的动画姿态过渡。实验结果表明,我们的方法成功地从单目视频中重建出真实且高度可动画的人类角色,有效保留精细细节,同时确保稳定和自然的姿态变化。在公共基准测试中,我们的方法在重建质量和动画稳健性方面超过了当前最新技术。

Key Takeaways

- 高质量、可动画的3D人类角色重建技术从单目视频具有广泛应用潜力。

- 现有方法在捕捉精细几何细节和保持动画稳定性方面存在挑战。

- 提出了一种基于二维高斯泼溅(2DGS)技术的实时框架来解决这些问题。

- 该框架实现了健壮和自然的姿势驱动动画。

- 引入旋转补偿网络(RCN)以实现平滑、无瑕疵的动画姿态过渡。

- 实验结果表明,该方法在重建质量和动画稳健性方面优于现有技术。

点此查看论文截图