⚠️ 以下所有内容总结都来自于 大语言模型的能力,如有错误,仅供参考,谨慎使用

🔴 请注意:千万不要用于严肃的学术场景,只能用于论文阅读前的初筛!

💗 如果您觉得我们的项目对您有帮助 ChatPaperFree ,还请您给我们一些鼓励!⭐️ HuggingFace免费体验

2025-05-06 更新

A Survey on 3D Reconstruction Techniques in Plant Phenotyping: From Classical Methods to Neural Radiance Fields (NeRF), 3D Gaussian Splatting (3DGS), and Beyond

Authors:Jiajia Li, Xinda Qi, Seyed Hamidreza Nabaei, Meiqi Liu, Dong Chen, Xin Zhang, Xunyuan Yin, Zhaojian Li

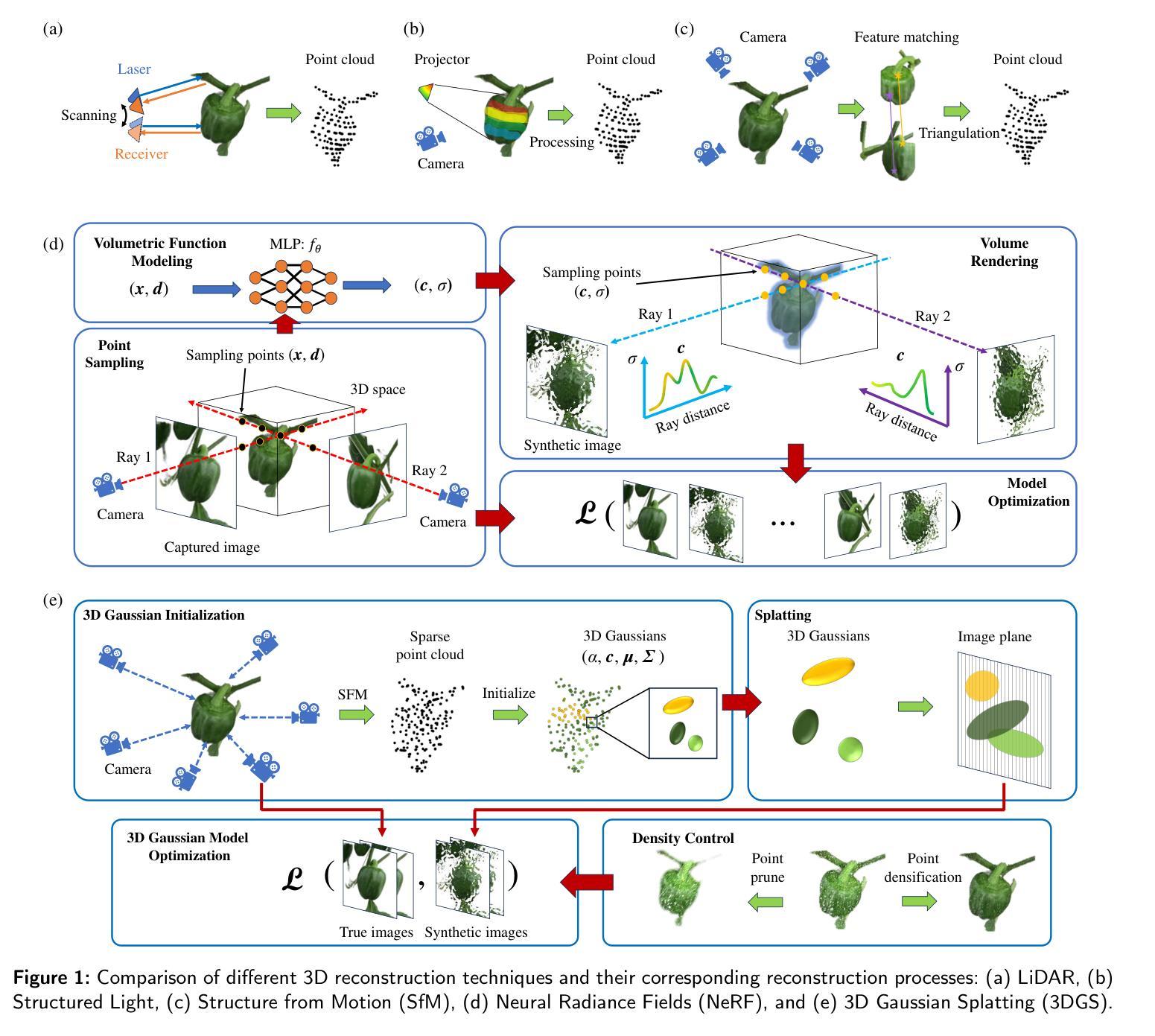

Plant phenotyping plays a pivotal role in understanding plant traits and their interactions with the environment, making it crucial for advancing precision agriculture and crop improvement. 3D reconstruction technologies have emerged as powerful tools for capturing detailed plant morphology and structure, offering significant potential for accurate and automated phenotyping. This paper provides a comprehensive review of the 3D reconstruction techniques for plant phenotyping, covering classical reconstruction methods, emerging Neural Radiance Fields (NeRF), and the novel 3D Gaussian Splatting (3DGS) approach. Classical methods, which often rely on high-resolution sensors, are widely adopted due to their simplicity and flexibility in representing plant structures. However, they face challenges such as data density, noise, and scalability. NeRF, a recent advancement, enables high-quality, photorealistic 3D reconstructions from sparse viewpoints, but its computational cost and applicability in outdoor environments remain areas of active research. The emerging 3DGS technique introduces a new paradigm in reconstructing plant structures by representing geometry through Gaussian primitives, offering potential benefits in both efficiency and scalability. We review the methodologies, applications, and performance of these approaches in plant phenotyping and discuss their respective strengths, limitations, and future prospects (https://github.com/JiajiaLi04/3D-Reconstruction-Plants). Through this review, we aim to provide insights into how these diverse 3D reconstruction techniques can be effectively leveraged for automated and high-throughput plant phenotyping, contributing to the next generation of agricultural technology.

植物表型分析在理解植物特征及其与环境互动方面扮演着关键角色,对于推动精准农业和作物改良至关重要。3D重建技术已崭露头角,成为捕捉植物详细形态和结构的有力工具,为准确和自动化的表型分析提供了巨大的潜力。本文对植物表型分析的3D重建技术进行了全面综述,涵盖了传统的重建方法、新兴的神经辐射场(NeRF)以及新颖的3D高斯贴图(3DGS)方法。传统方法通常依赖于高分辨率传感器,因其简单性和灵活性而在植物结构表示方面得到广泛应用,但它们面临着数据密度、噪声和可扩展性等方面的挑战。NeRF作为最新进展,能够从稀疏视角实现高质量、逼真的3D重建,但其计算成本和在户外环境的适用性仍是活跃的研究领域。新兴的3DGS技术通过高斯原始几何表示法,为植物结构重建提供了新的范例,在效率和可扩展性方面提供了潜在的优势。我们回顾了这些方法在植物表型分析中的方法、应用和性能,并讨论了各自的优点、局限性和未来前景(https://github.com/JiajiaLi04/3D-Reconstruction-Plants)。通过本次综述,我们旨在深入了解这些不同的3D重建技术如何有效地应用于自动化和高通量的植物表型分析,为下一代农业技术做出贡献。

论文及项目相关链接

PDF 17 pages, 7 figures, 4 tables

Summary

本文全面综述了植物表型组学中的3D重建技术,包括经典方法、新兴的神经辐射场(NeRF)和3D高斯喷涂(3DGS)方法。经典方法虽然简单灵活,但在数据密度、噪声和可扩展性方面面临挑战。NeRF能够实现高质量、逼真的3D重建,但计算成本和户外应用仍是研究热点。3DGS技术通过高斯原始几何表示重建植物结构,具有效率和可扩展性的潜力。本文旨在提供对这些技术在植物表型组学应用中的见解,为下一代农业技术的自动化和高通量表型分析提供贡献。

Key Takeaways

- 植物表型在了解植物特性及其与环境的交互中起关键作用,对精准农业和作物改良至关重要。

- 3D重建技术是捕捉植物形态和结构的有力工具,对准确自动化表型分析有巨大潜力。

- 经典3D重建方法虽然广泛应用,但在数据密度、噪声和可扩展性方面存在挑战。

- NeRF技术能实现高质量3D重建,但计算成本和户外应用仍需进一步研究。

- 新兴的3DGS技术通过高斯原始几何表示植物结构,可能提高效率和可扩展性。

- 本文综述了不同3D重建技术在植物表型组学的应用,旨在提供深入见解。

点此查看论文截图

EmoGene: Audio-Driven Emotional 3D Talking-Head Generation

Authors:Wenqing Wang, Yun Fu

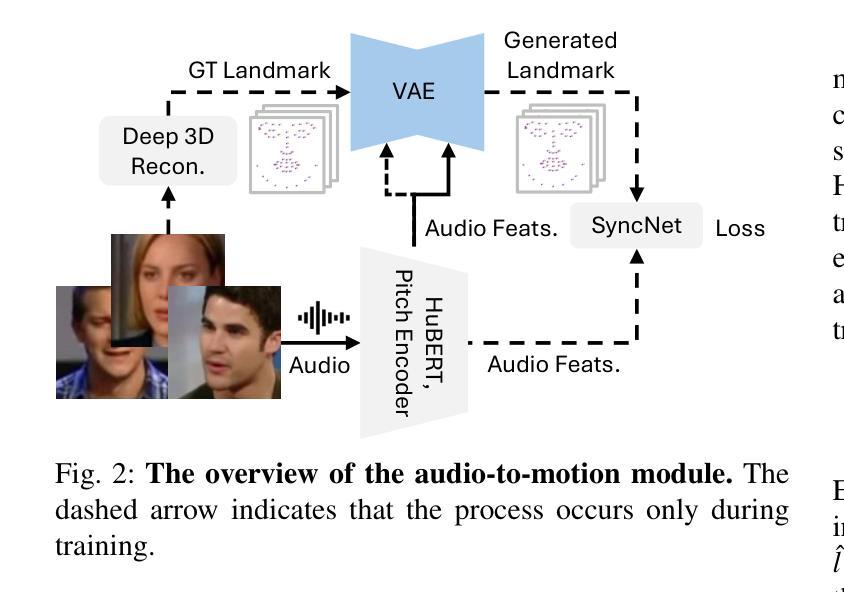

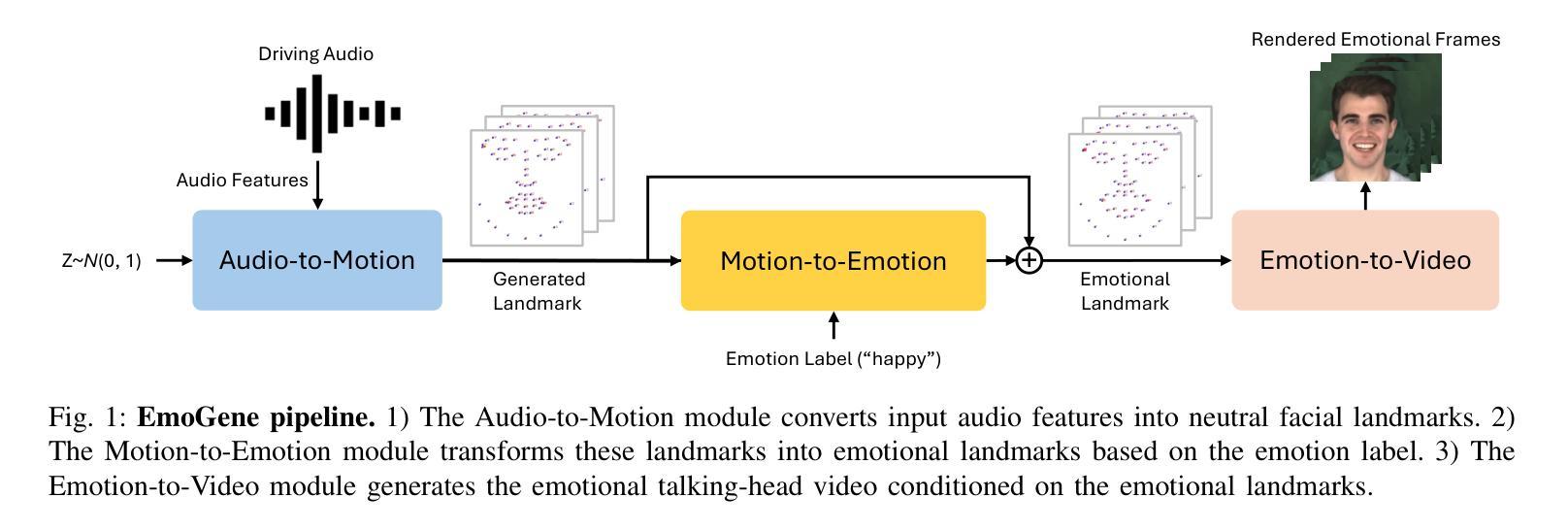

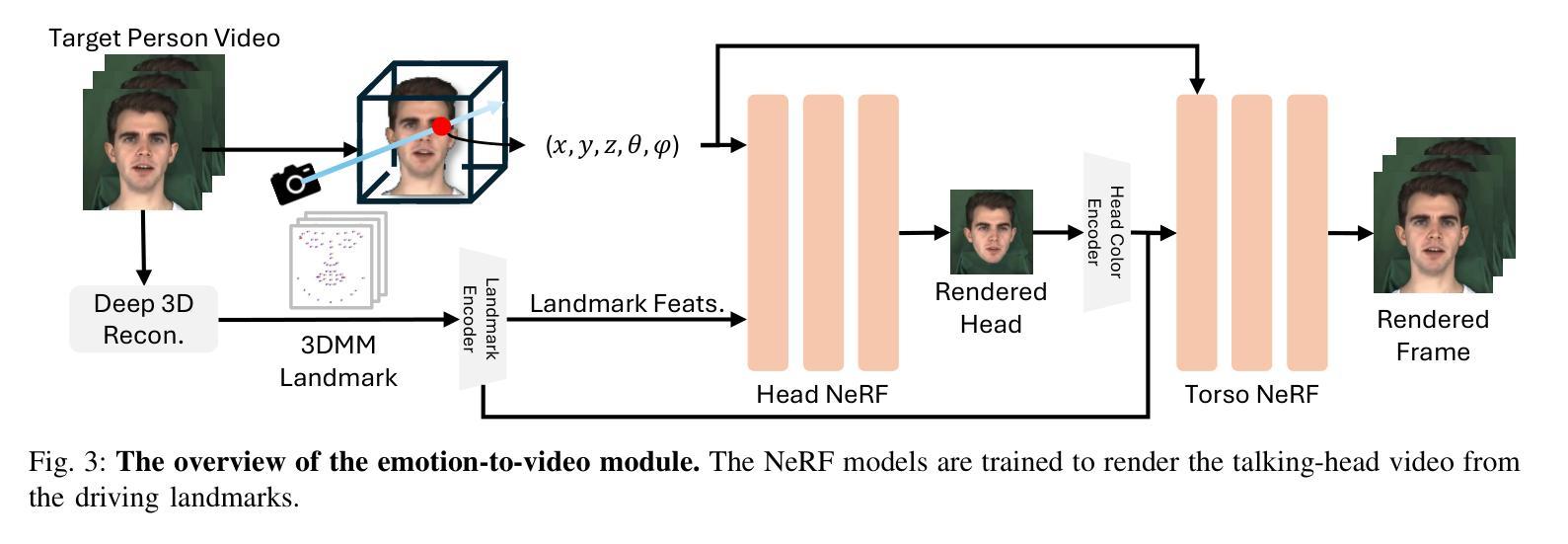

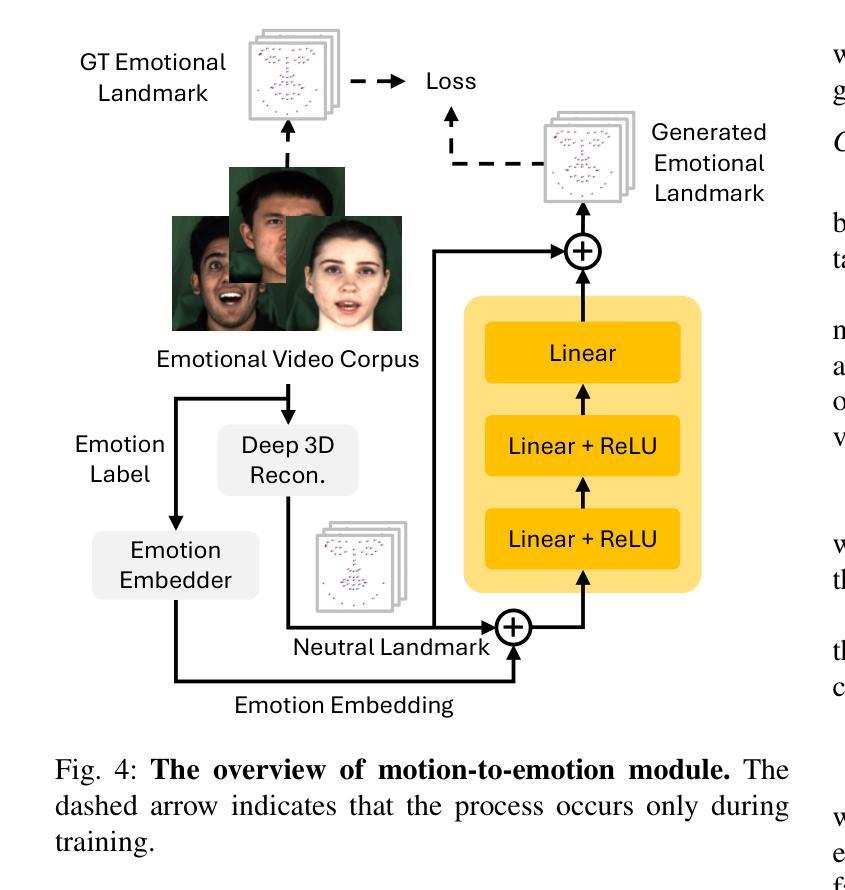

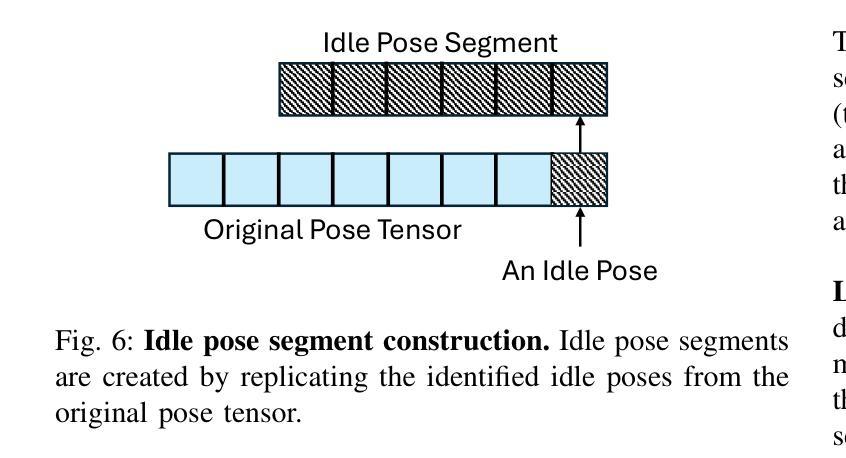

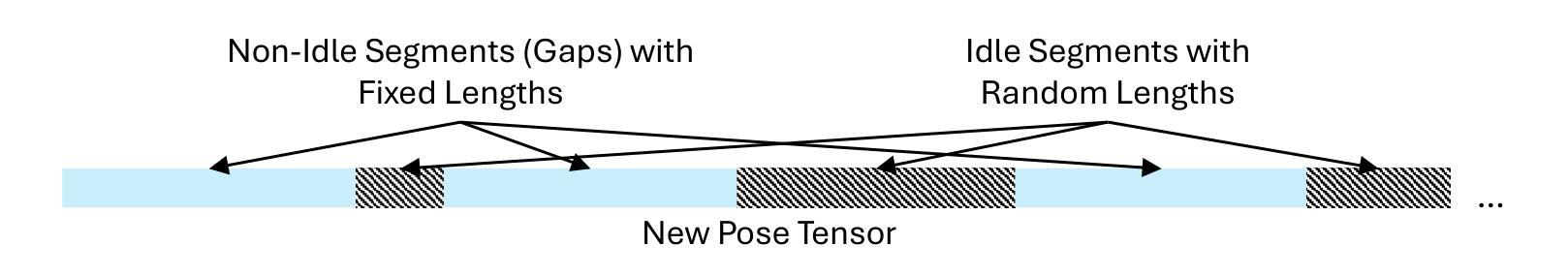

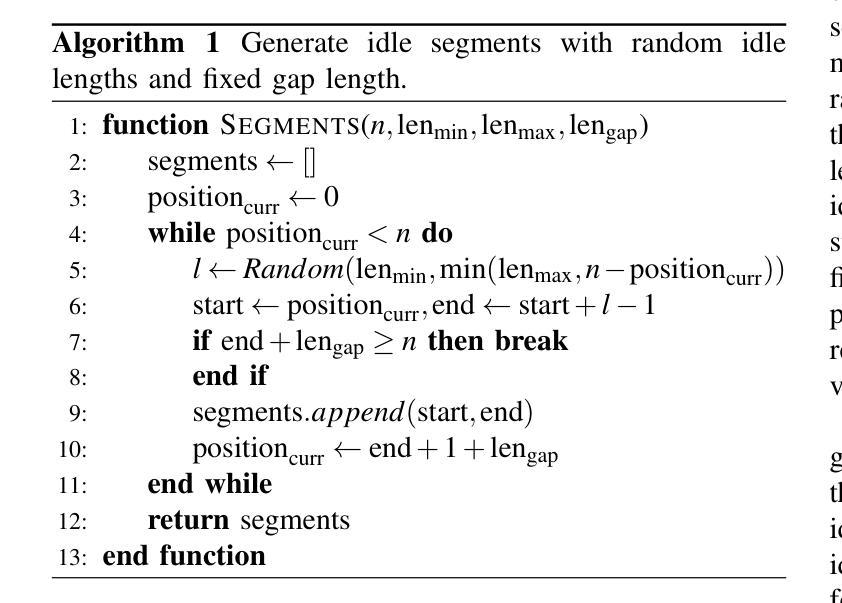

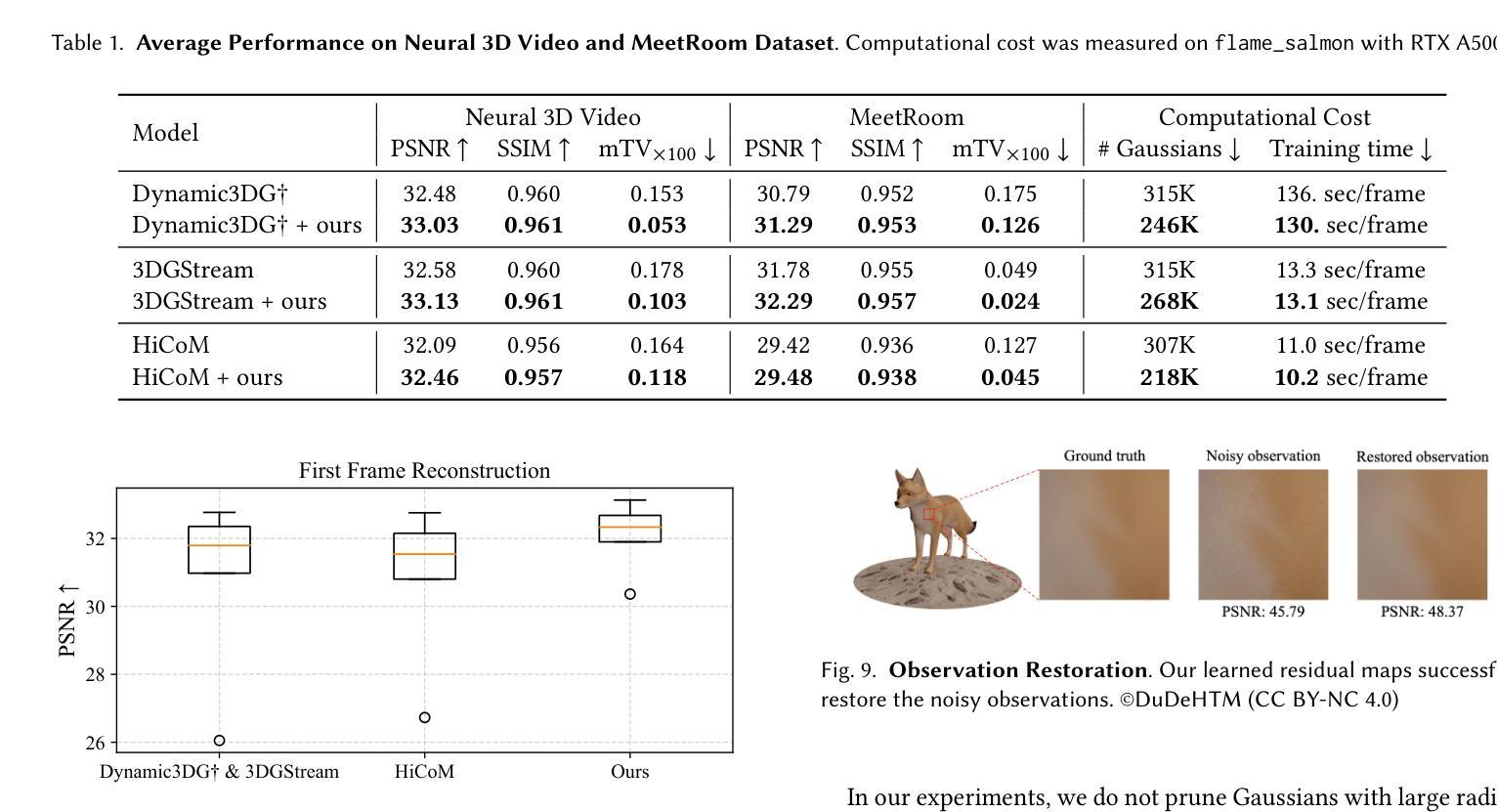

Audio-driven talking-head generation is a crucial and useful technology for virtual human interaction and film-making. While recent advances have focused on improving image fidelity and lip synchronization, generating accurate emotional expressions remains underexplored. In this paper, we introduce EmoGene, a novel framework for synthesizing high-fidelity, audio-driven video portraits with accurate emotional expressions. Our approach employs a variational autoencoder (VAE)-based audio-to-motion module to generate facial landmarks, which are concatenated with emotional embedding in a motion-to-emotion module to produce emotional landmarks. These landmarks drive a Neural Radiance Fields (NeRF)-based emotion-to-video module to render realistic emotional talking-head videos. Additionally, we propose a pose sampling method to generate natural idle-state (non-speaking) videos for silent audio inputs. Extensive experiments demonstrate that EmoGene outperforms previous methods in generating high-fidelity emotional talking-head videos.

音频驱动的说话人头部生成是虚拟人类交互和电影制作中一项关键且实用的技术。虽然最近的进展主要集中在提高图像保真度和嘴唇同步性,但生成准确情绪表达的研究仍然不足。在本文中,我们介绍了EmoGene,这是一个合成高保真、音频驱动的视频肖像准确情绪表达的新型框架。我们的方法采用基于变分自编码器(VAE)的音频到运动模块来生成面部地标,这些面部地标与运动到情绪模块中的情绪嵌入相结合,以产生情绪地标。这些地标驱动基于神经辐射场(NeRF)的情绪到视频模块,以呈现逼真的情感说话人头视频。此外,我们还提出了一种姿态采样方法,用于生成针对无声音频输入的天然空闲状态(非说话)视频。大量实验表明,EmoGene在生成高保真情感说话人头视频方面优于以前的方法。

论文及项目相关链接

PDF Accepted by the 2025 IEEE 19th International Conference on Automatic Face and Gesture Recognition (FG)

Summary

本文介绍了一种名为EmoGene的新型框架,该框架能够合成高保真、音频驱动的视频肖像,并具备准确的情感表达。通过使用变分自编码器(VAE)的音频到动作模块生成面部地标,与情感嵌入在动作到情感模块中结合,产生情感地标。这些地标驱动基于神经辐射场(NeRF)的情感到视频模块,以呈现逼真的情感对话视频。此外,还提出了一种姿态采样方法,用于生成针对无声音频输入的静默状态视频。实验表明,EmoGene在生成高保真情感对话视频方面优于以前的方法。

Key Takeaways

- EmoGene是一个用于合成高保真音频驱动视频肖像的框架,具备准确情感表达的能力。

- 通过变分自编码器(VAE)生成面部地标,并结合情感嵌入来产生情感地标。

- 情感地标驱动基于神经辐射场(NeRF)的情感到视频模块,实现逼真情感表达的视频合成。

- 框架还包括一种姿态采样方法,用于生成静默状态(非说话)视频,适应无声音频输入。

- EmoGene在生成高保真情感对话视频方面的性能优于先前的方法。

- 该技术对于虚拟人机交互和电影制作中的音频驱动对话头生成具有重要意义。

- 框架对于未来虚拟内容创作和娱乐应用具有潜在的广泛应用价值。

点此查看论文截图