⚠️ 以下所有内容总结都来自于 大语言模型的能力,如有错误,仅供参考,谨慎使用

🔴 请注意:千万不要用于严肃的学术场景,只能用于论文阅读前的初筛!

💗 如果您觉得我们的项目对您有帮助 ChatPaperFree ,还请您给我们一些鼓励!⭐️ HuggingFace免费体验

2025-05-27 更新

CGS-GAN: 3D Consistent Gaussian Splatting GANs for High Resolution Human Head Synthesis

Authors:Florian Barthel, Wieland Morgenstern, Paul Hinzer, Anna Hilsmann, Peter Eisert

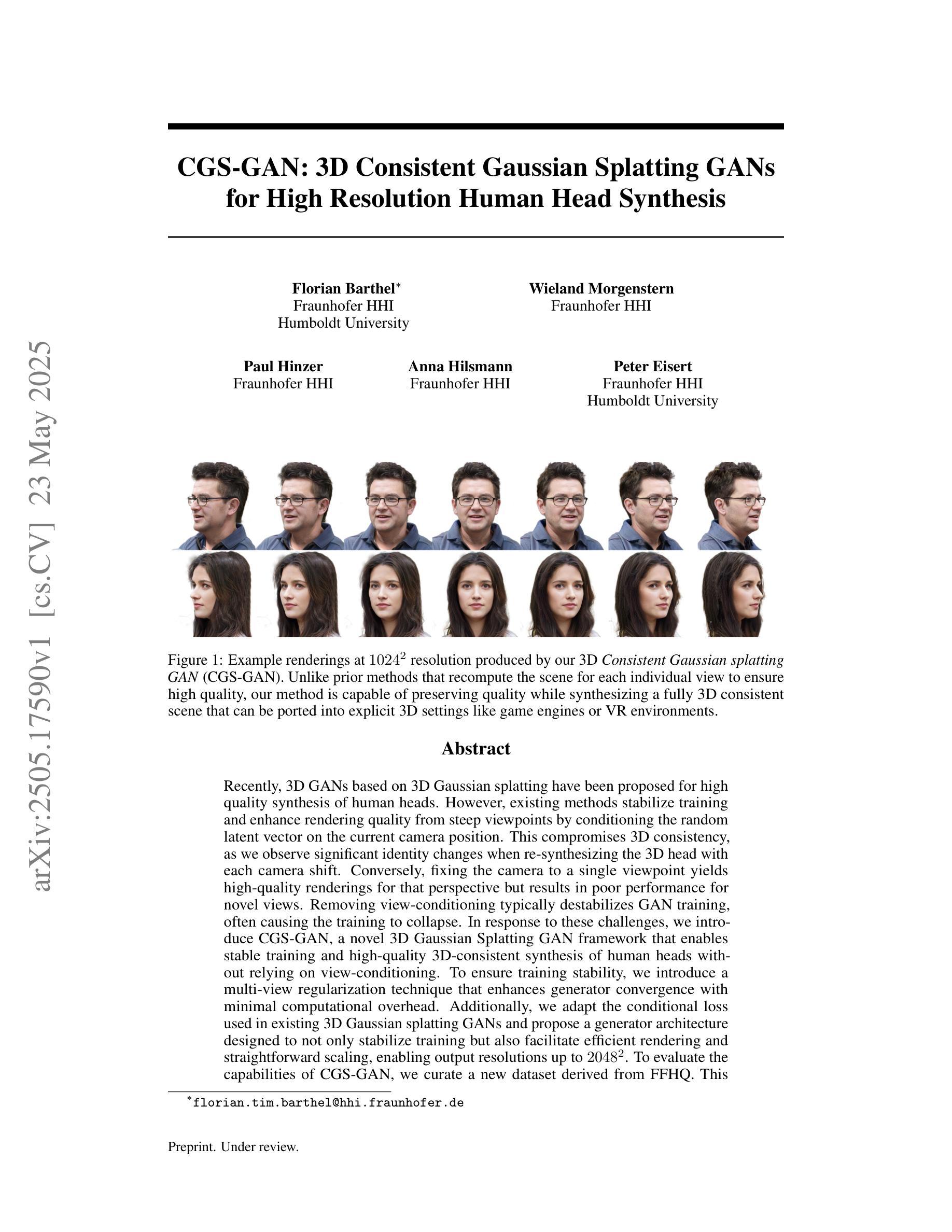

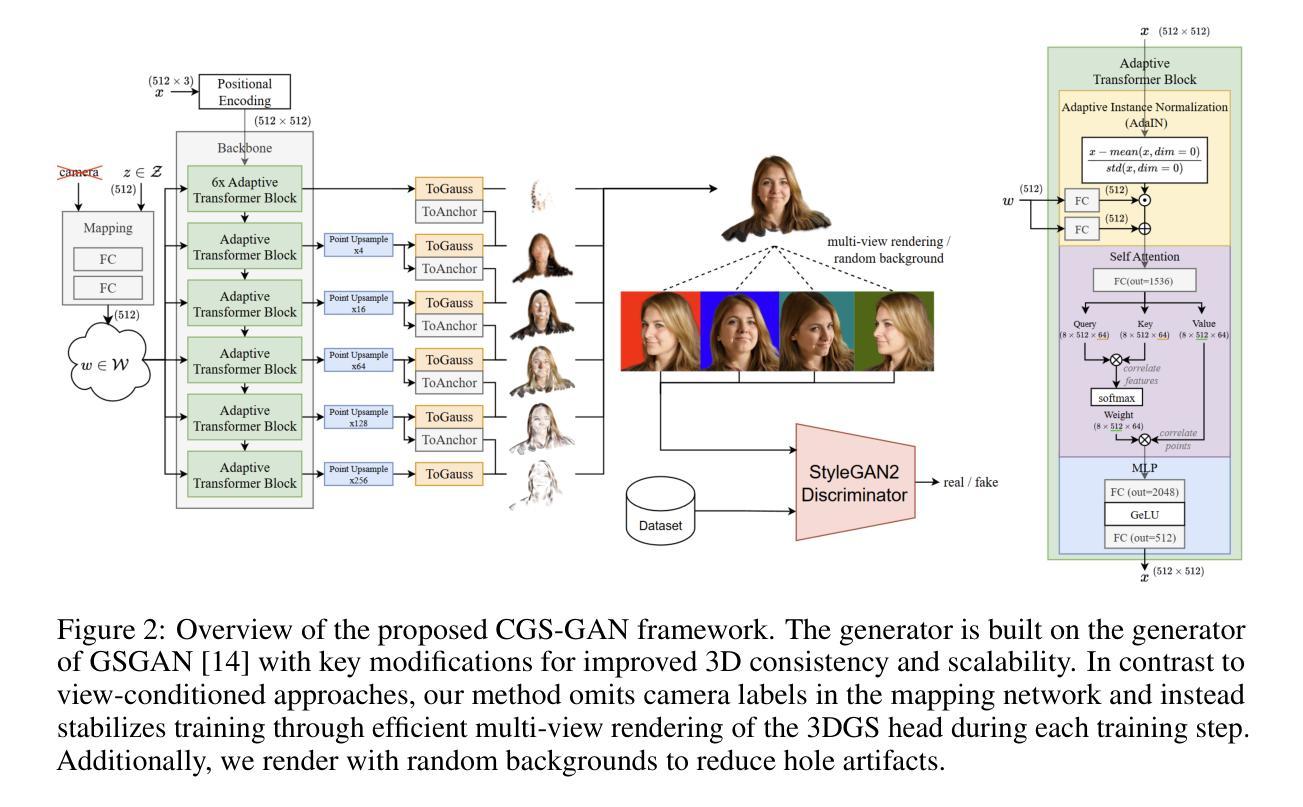

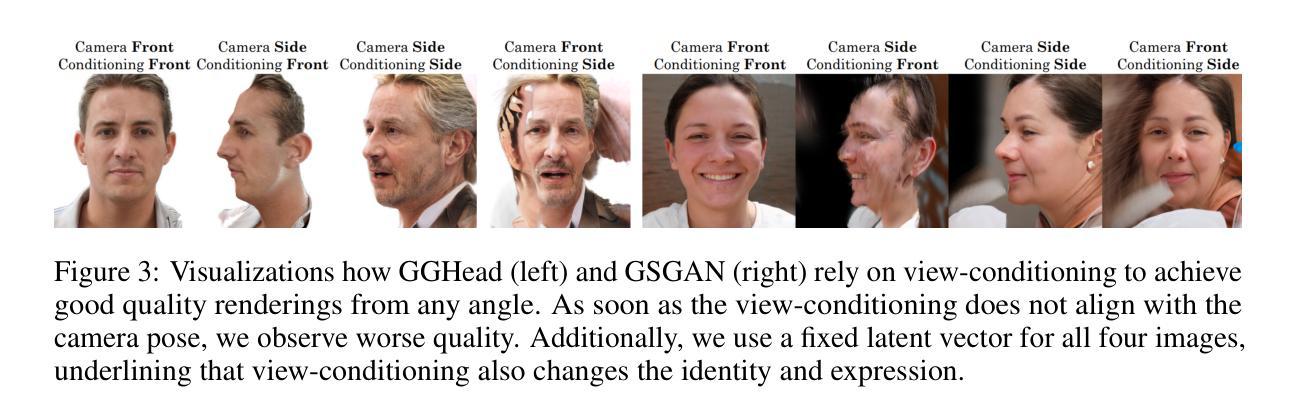

Recently, 3D GANs based on 3D Gaussian splatting have been proposed for high quality synthesis of human heads. However, existing methods stabilize training and enhance rendering quality from steep viewpoints by conditioning the random latent vector on the current camera position. This compromises 3D consistency, as we observe significant identity changes when re-synthesizing the 3D head with each camera shift. Conversely, fixing the camera to a single viewpoint yields high-quality renderings for that perspective but results in poor performance for novel views. Removing view-conditioning typically destabilizes GAN training, often causing the training to collapse. In response to these challenges, we introduce CGS-GAN, a novel 3D Gaussian Splatting GAN framework that enables stable training and high-quality 3D-consistent synthesis of human heads without relying on view-conditioning. To ensure training stability, we introduce a multi-view regularization technique that enhances generator convergence with minimal computational overhead. Additionally, we adapt the conditional loss used in existing 3D Gaussian splatting GANs and propose a generator architecture designed to not only stabilize training but also facilitate efficient rendering and straightforward scaling, enabling output resolutions up to $2048^2$. To evaluate the capabilities of CGS-GAN, we curate a new dataset derived from FFHQ. This dataset enables very high resolutions, focuses on larger portions of the human head, reduces view-dependent artifacts for improved 3D consistency, and excludes images where subjects are obscured by hands or other objects. As a result, our approach achieves very high rendering quality, supported by competitive FID scores, while ensuring consistent 3D scene generation. Check our our project page here: https://fraunhoferhhi.github.io/cgs-gan/

最近,基于三维高斯拼贴的三维生成对抗网络(GANs)已被提出用于高质量的人头合成。然而,现有方法通过根据当前相机位置对随机潜在向量进行条件处理来稳定训练并提高从陡峭视角的渲染质量。这会影响三维一致性,因为我们在重新合成三维头部时观察到身份的重大变化。相反,将相机固定在单一视角上为该视角生成高质量的渲染结果,但对于新视角则表现不佳。移除视图条件通常会破坏GAN训练,导致训练失败。为了应对这些挑战,我们引入了CGS-GAN,这是一种新型的三维高斯拼贴GAN框架,能够在不依赖视图条件的情况下实现稳定训练和高质量的三维一致人头合成。为了确保训练稳定性,我们引入了一种多视角正则化技术,该技术可以在最小的计算开销下增强生成器的收敛性。此外,我们适应了现有三维高斯拼贴GAN中的条件损失,并提出了一种旨在稳定训练、促进高效渲染和简便扩展的生成器架构,支持高达$ 2048^2 $的输出分辨率。为了评估CGS-GAN的能力,我们从FFHQ中整理了一个新的数据集。该数据集可实现极高分辨率,重点关注人头的更大部分,减少视图相关的伪影以提高三维一致性,并排除主体被手或其他物体遮挡的图像。因此,我们的方法实现了高质量的渲染效果,并以具有竞争力的FID分数为支持,同时确保一致的三维场景生成。请访问我们的项目页面了解更多信息:https://fraunhoferhhi.github.io/cgs-gan/。

论文及项目相关链接

PDF Main paper 12 pages, supplementary materials 8 pages

Summary

基于3D高斯映射的3D GAN近期被提出用于高质量的人头合成。然而,现有方法通过以当前相机位置为条件来调节随机潜在向量,从而稳定训练并提高了渲染质量。这损害了3D一致性,因为我们在重新合成3D头部时观察到身份显著变化。针对这些挑战,我们推出了CGS-GAN,这是一种新颖的3D高斯映射GAN框架,无需依赖视图条件即可实现稳定训练和高质量、高一致性的3D人头合成。为确保训练稳定性,我们引入了一种多视图正则化技术,该技术可增强生成器收敛性并尽量减少计算开销。此外,我们还改进了现有3D高斯映射GAN中的条件损失并提出了新的生成器架构,不仅稳定训练,还促进高效渲染和简便扩展,支持高达$ 2048^2 $的输出分辨率。为评估CGS-GAN的能力,我们从FFHQ中整理了一个新的数据集,该数据集支持超高分辨率,重点关注更大的人头部分,减少了视图相关的伪影以改善3D一致性,并排除了主体被手或其他物体遮挡的图像。因此,我们的方法在保证高渲染质量的同时实现了高一致性的3D场景生成。更多信息请访问我们的项目页面:链接地址。

Key Takeaways

- CGS-GAN是一个新颖的基于3D高斯映射的GAN框架,用于高质量的人头合成。

- 现有方法通过条件化随机潜在向量在特定相机位置稳定训练和增强渲染质量,但牺牲了3D一致性。

- CGS-GAN引入了一种多视图正则化技术来确保训练稳定性和生成器收敛性。

- 提出了一种改进的生成器架构,不仅促进高效渲染和简便扩展,还支持超高的输出分辨率。

- 为了评估CGS-GAN的性能,建立了一个新的数据集,专注于更大的人头部分,强调减少视图相关伪影和高一致性。

- 新数据集排除被其他物体遮挡的人像图像。

点此查看论文截图