⚠️ 以下所有内容总结都来自于 大语言模型的能力,如有错误,仅供参考,谨慎使用

🔴 请注意:千万不要用于严肃的学术场景,只能用于论文阅读前的初筛!

💗 如果您觉得我们的项目对您有帮助 ChatPaperFree ,还请您给我们一些鼓励!⭐️ HuggingFace免费体验

2025-06-14 更新

PointGS: Point Attention-Aware Sparse View Synthesis with Gaussian Splatting

Authors:Lintao Xiang, Hongpei Zheng, Yating Huang, Qijun Yang, Hujun Yin

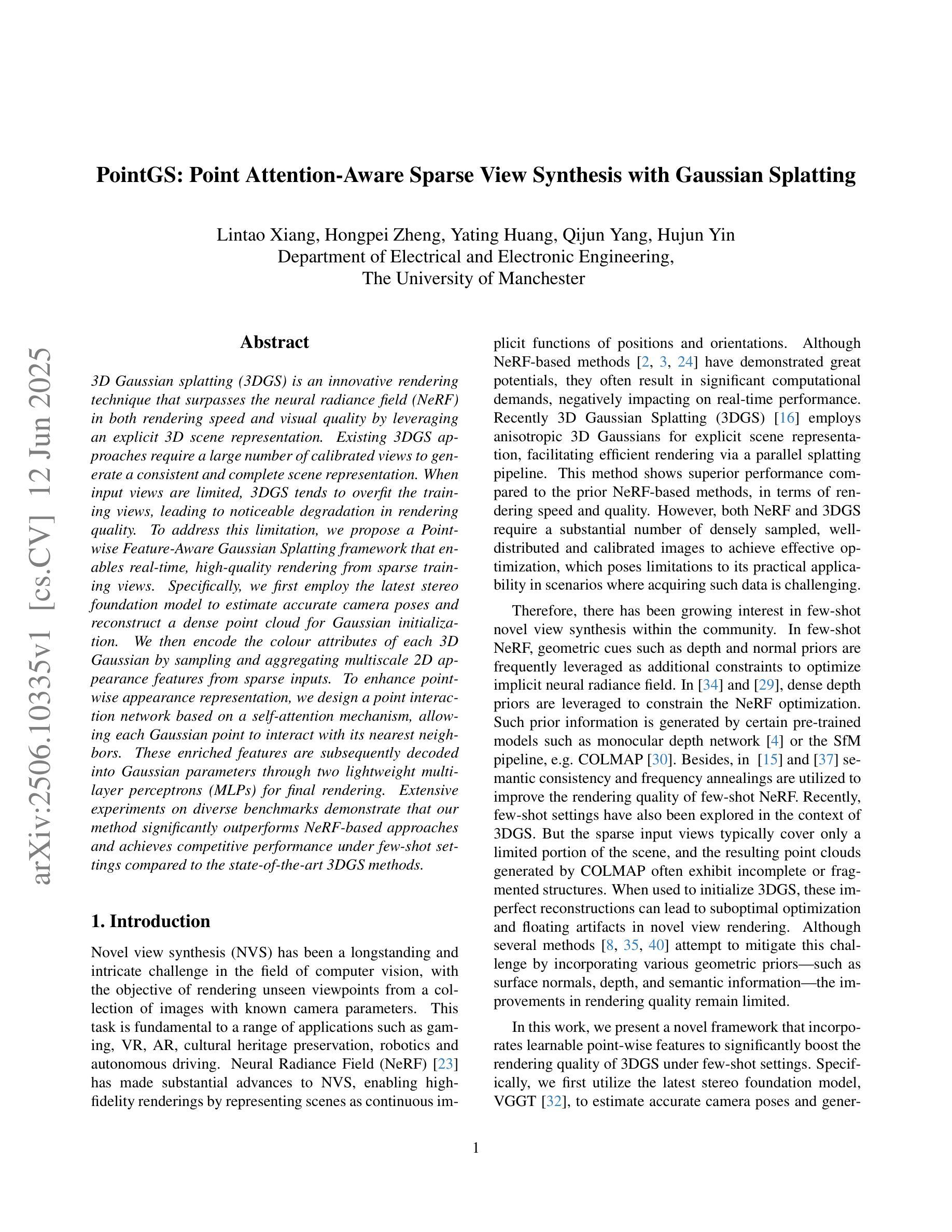

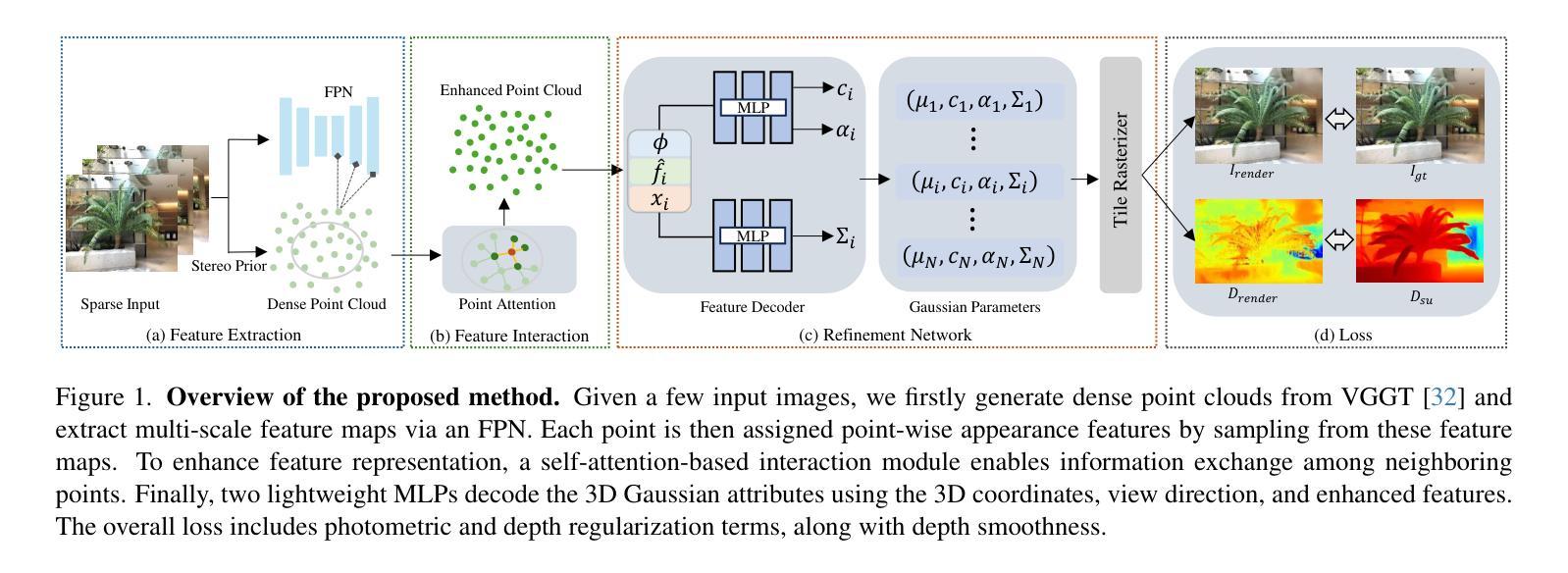

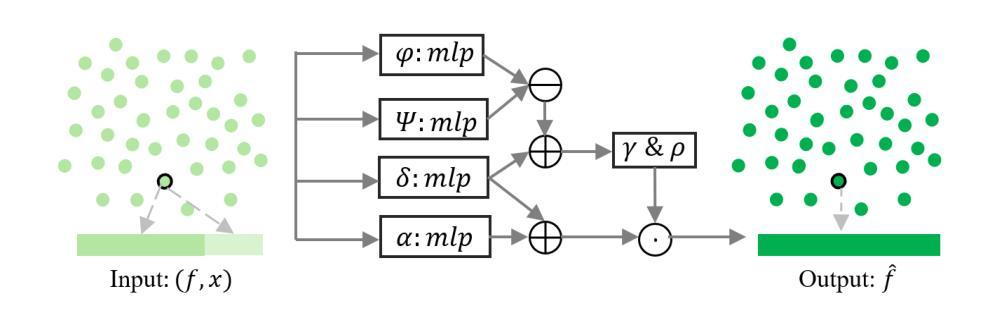

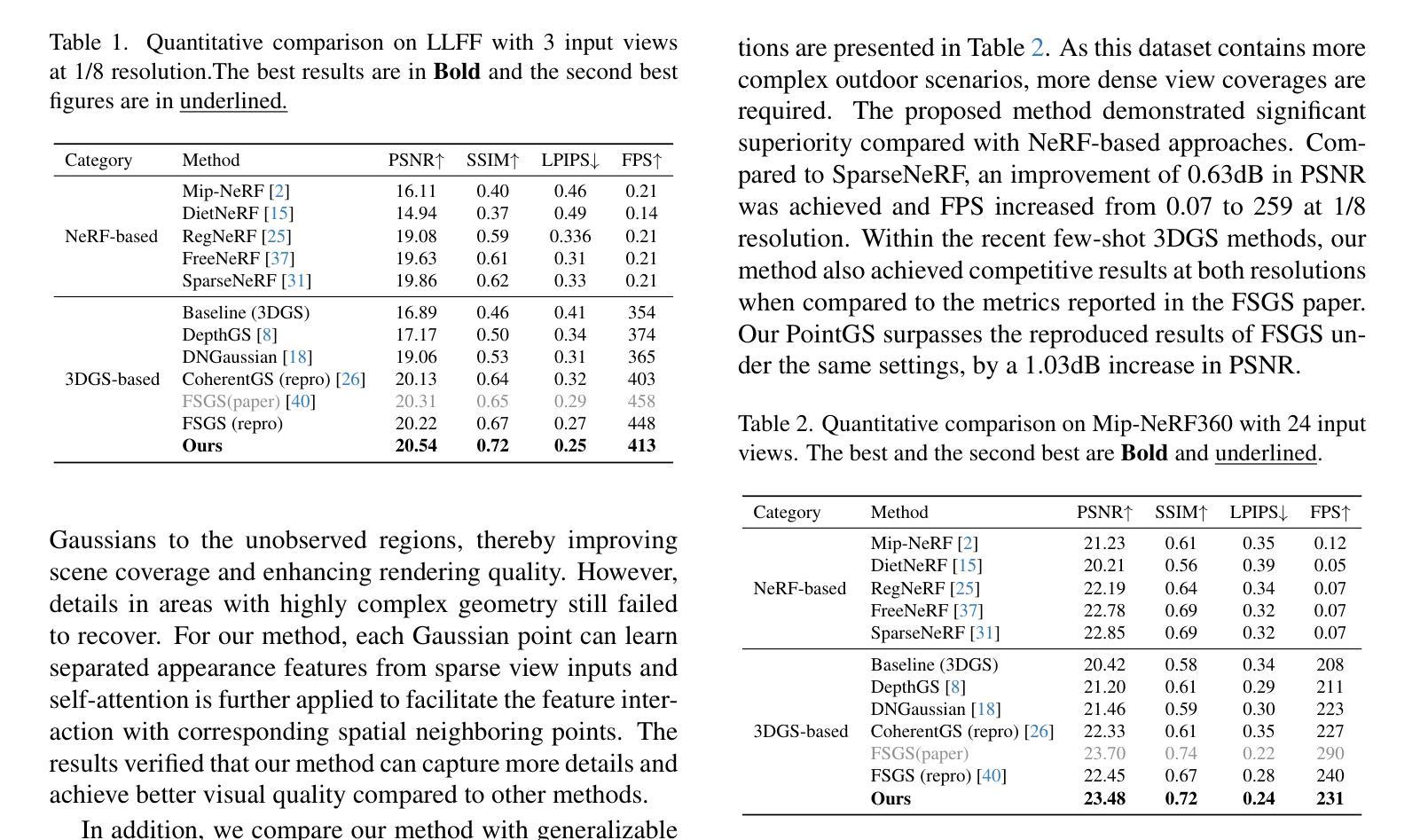

3D Gaussian splatting (3DGS) is an innovative rendering technique that surpasses the neural radiance field (NeRF) in both rendering speed and visual quality by leveraging an explicit 3D scene representation. Existing 3DGS approaches require a large number of calibrated views to generate a consistent and complete scene representation. When input views are limited, 3DGS tends to overfit the training views, leading to noticeable degradation in rendering quality. To address this limitation, we propose a Point-wise Feature-Aware Gaussian Splatting framework that enables real-time, high-quality rendering from sparse training views. Specifically, we first employ the latest stereo foundation model to estimate accurate camera poses and reconstruct a dense point cloud for Gaussian initialization. We then encode the colour attributes of each 3D Gaussian by sampling and aggregating multiscale 2D appearance features from sparse inputs. To enhance point-wise appearance representation, we design a point interaction network based on a self-attention mechanism, allowing each Gaussian point to interact with its nearest neighbors. These enriched features are subsequently decoded into Gaussian parameters through two lightweight multi-layer perceptrons (MLPs) for final rendering. Extensive experiments on diverse benchmarks demonstrate that our method significantly outperforms NeRF-based approaches and achieves competitive performance under few-shot settings compared to the state-of-the-art 3DGS methods.

3D高斯拼贴(3DGS)是一种创新的渲染技术,它通过利用明确的3D场景表示在渲染速度和视觉质量上超越了神经辐射场(NeRF)。现有的3DGS方法需要大量的校准视图来生成一致和完整的场景表示。当输入视图有限时,3DGS容易过度拟合训练视图,导致渲染质量明显下降。为了解决这一局限性,我们提出了一种点特征感知高斯拼贴框架,能够实现从稀疏训练视图的实时高质量渲染。具体来说,我们首先采用最新的立体基础模型来估计准确的相机姿态并重建用于高斯初始化的密集点云。然后,我们通过采样和聚合来自稀疏输入的多尺度2D外观特征来编码每个3D高斯的颜色属性。为了增强点级外观表示,我们设计了一个基于自注意力机制的点交互网络,允许每个高斯点与最近的邻居进行交互。这些丰富的特征随后通过两个轻量级的多层感知器(MLP)解码为高斯参数,用于最终渲染。在多种基准测试上的广泛实验表明,我们的方法显著优于基于NeRF的方法,并在小样本设置下实现了与最先进的3DGS方法相当的性能。

论文及项目相关链接

Summary

这是一项关于三维高斯贴图渲染技术(3DGS)的研究,该技术超越了神经辐射场(NeRF)在渲染速度和视觉质量方面的表现。针对现有方法需要大量校准视图的问题,该研究提出了一种基于点特征感知的高斯贴图框架,可从稀疏的训练视图中实现实时高质量渲染。该框架通过最新立体基础模型估计相机姿态并重建密集点云进行高斯初始化,然后通过采样和聚合多尺度二维外观特征来编码每个三维高斯的颜色属性。此外,该研究还设计了一种基于自注意力机制的点交互网络以增强点级外观表示,使每个高斯点都能与其最近邻进行交互。最终,通过两个轻量级多层感知器(MLPs)将丰富的特征解码为高斯参数以实现最终渲染。实验表明,该方法显著优于基于NeRF的方法,并在小样本设置下实现了与最新3DGS方法相竞争的性能。

Key Takeaways

- 3DGS是一种超越NeRF的渲染技术,在渲染速度和视觉质量方面表现出优势。

- 现有3DGS方法需要大量校准视图以生成一致和完整的场景表示。

- 针对上述局限性,提出了基于点特征感知的高斯贴图框架,实现了从稀疏训练视图的高质量实时渲染。

- 利用最新立体基础模型估计相机姿态并重建密集点云进行高斯初始化。

- 通过采样和聚合多尺度二维外观特征来编码每个三维高斯的颜色属性。

- 设计了一种基于自注意力机制的点交互网络以增强点级外观表示。

点此查看论文截图