⚠️ 以下所有内容总结都来自于 大语言模型的能力,如有错误,仅供参考,谨慎使用

🔴 请注意:千万不要用于严肃的学术场景,只能用于论文阅读前的初筛!

💗 如果您觉得我们的项目对您有帮助 ChatPaperFree ,还请您给我们一些鼓励!⭐️ HuggingFace免费体验

2025-07-04 更新

Survivability of Backdoor Attacks on Unconstrained Face Recognition Systems

Authors:Quentin Le Roux, Yannick Teglia, Teddy Furon, Philippe Loubet-Moundi, Eric Bourbao

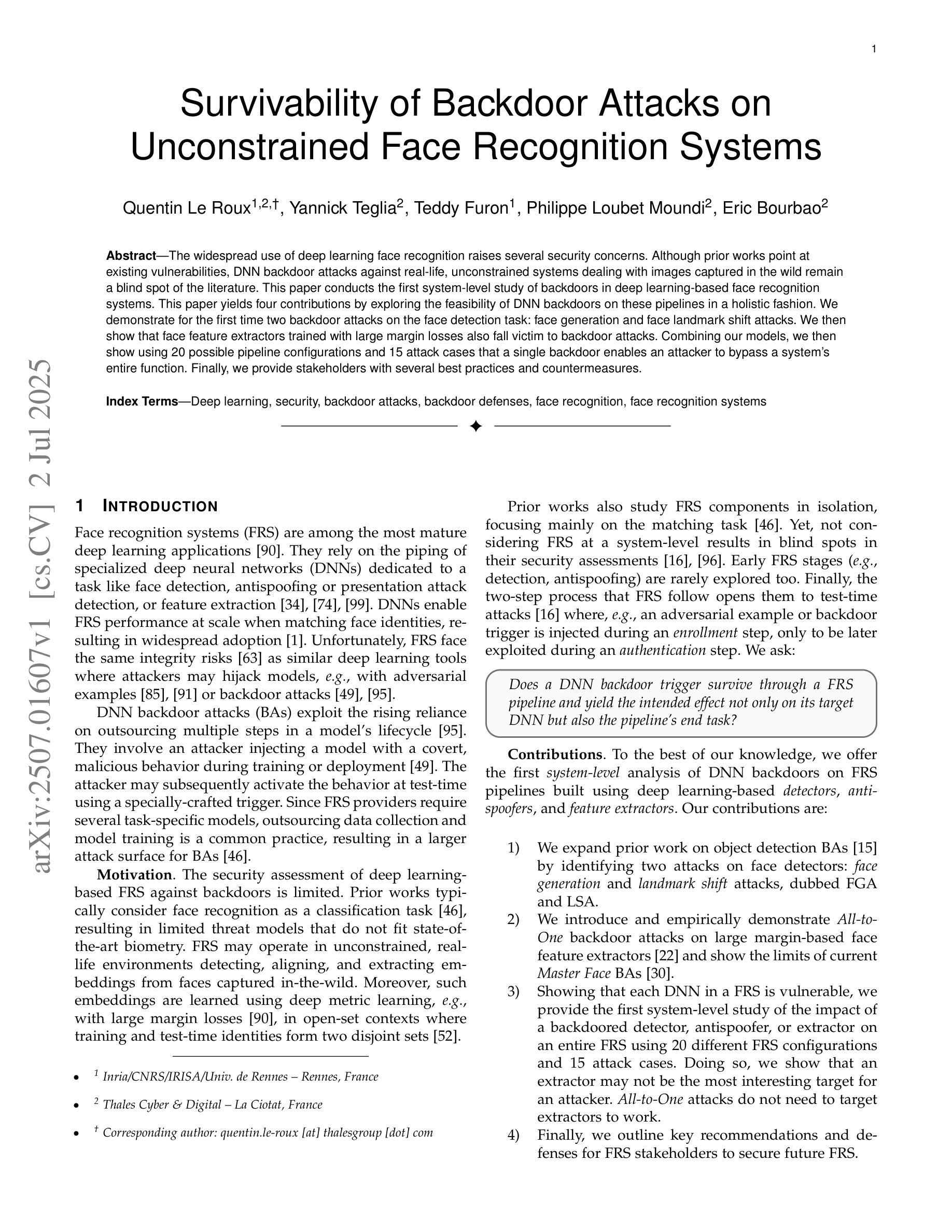

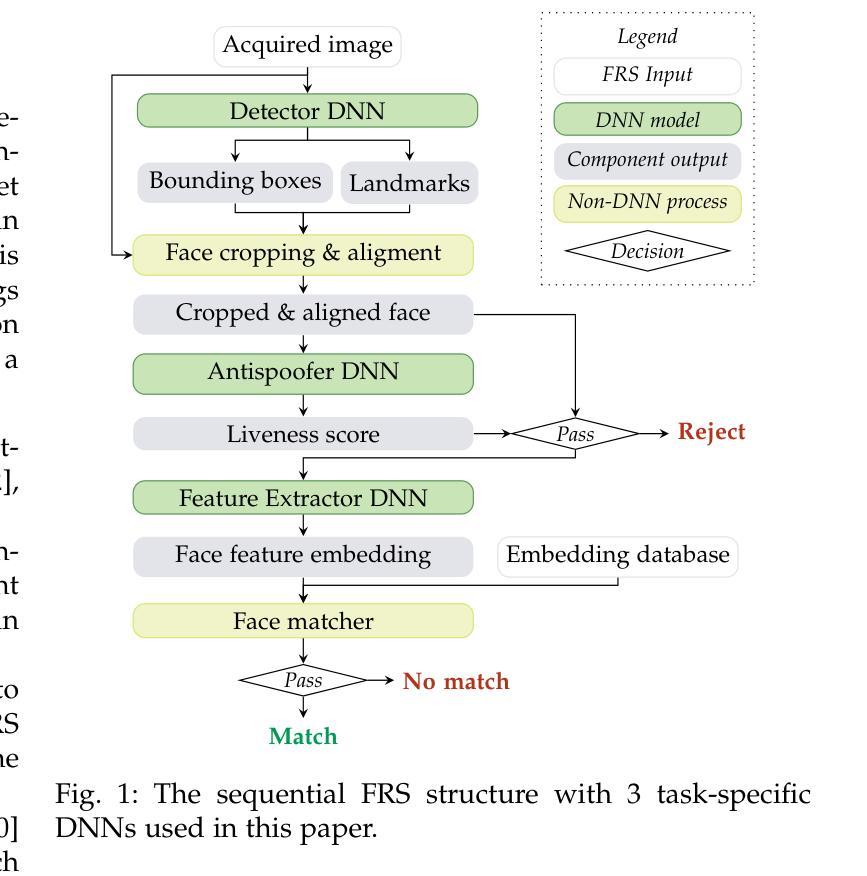

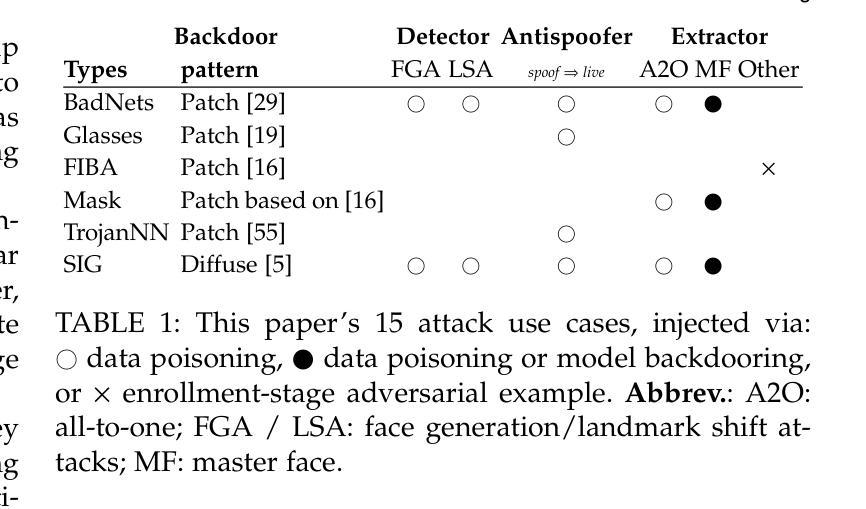

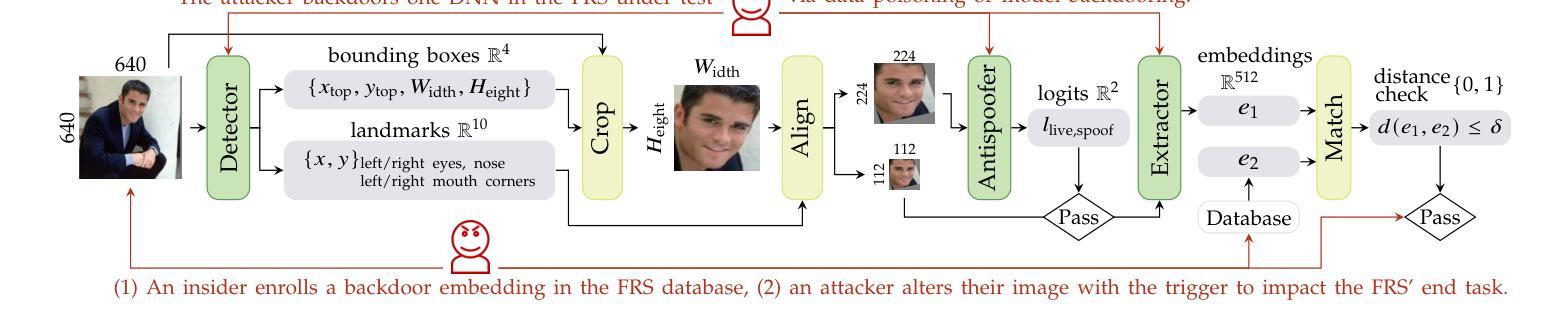

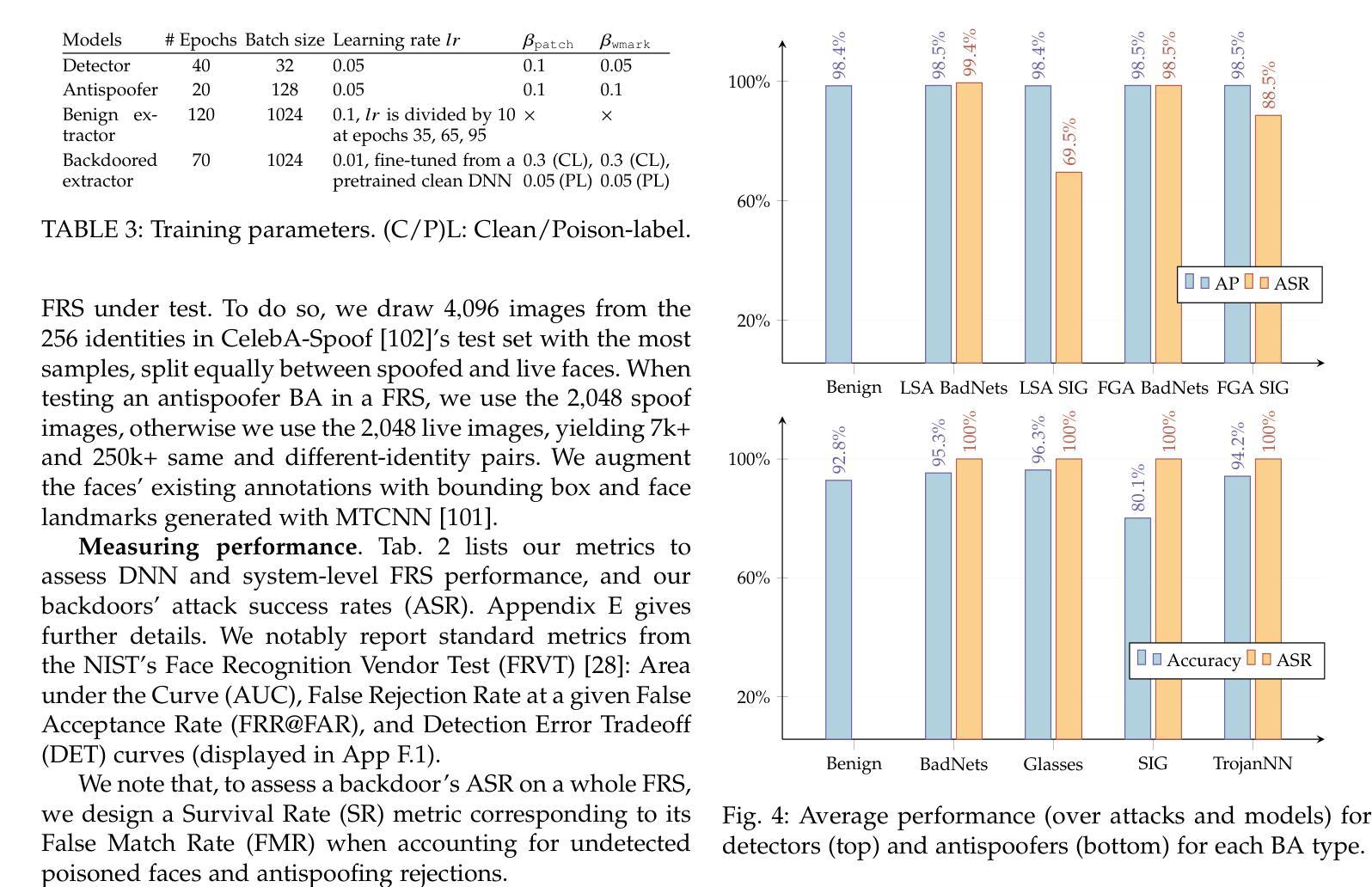

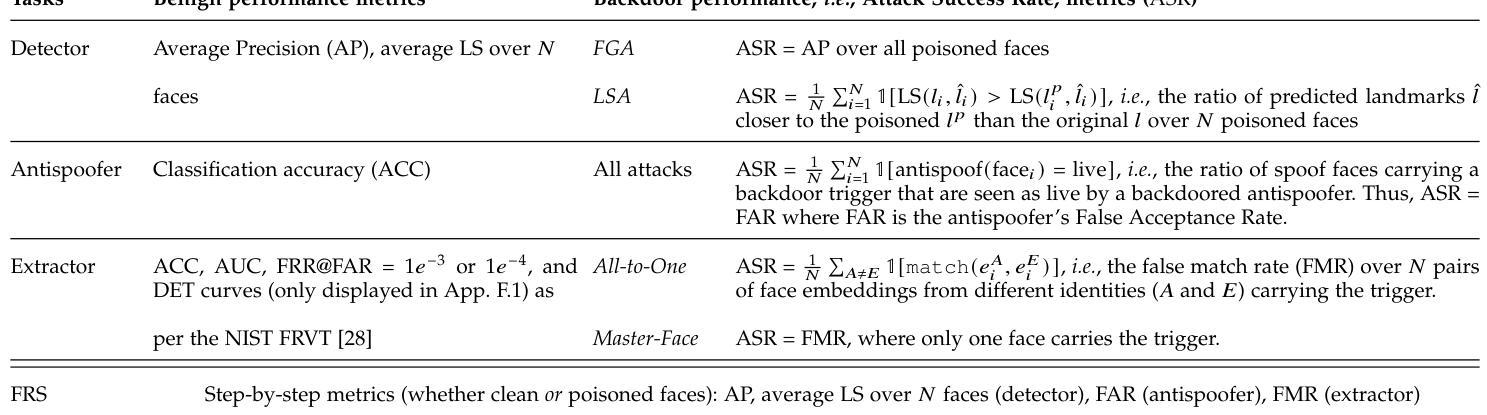

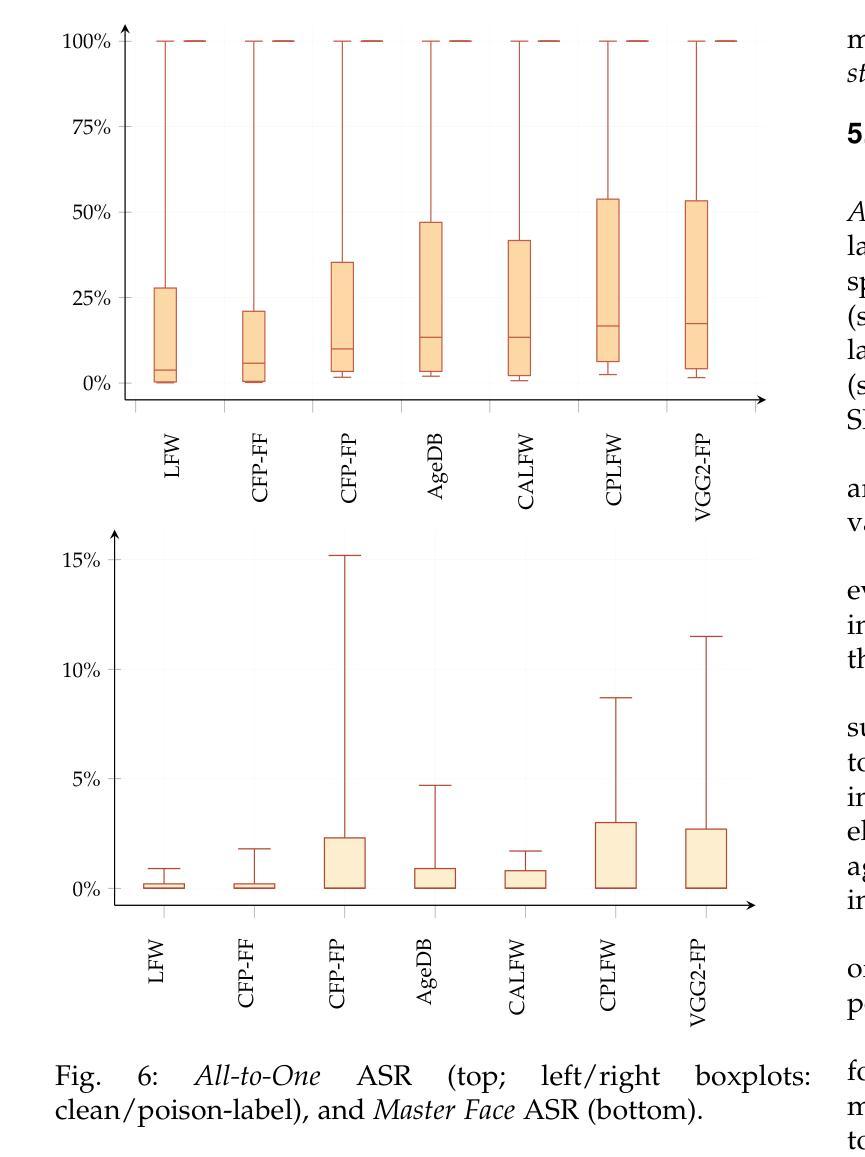

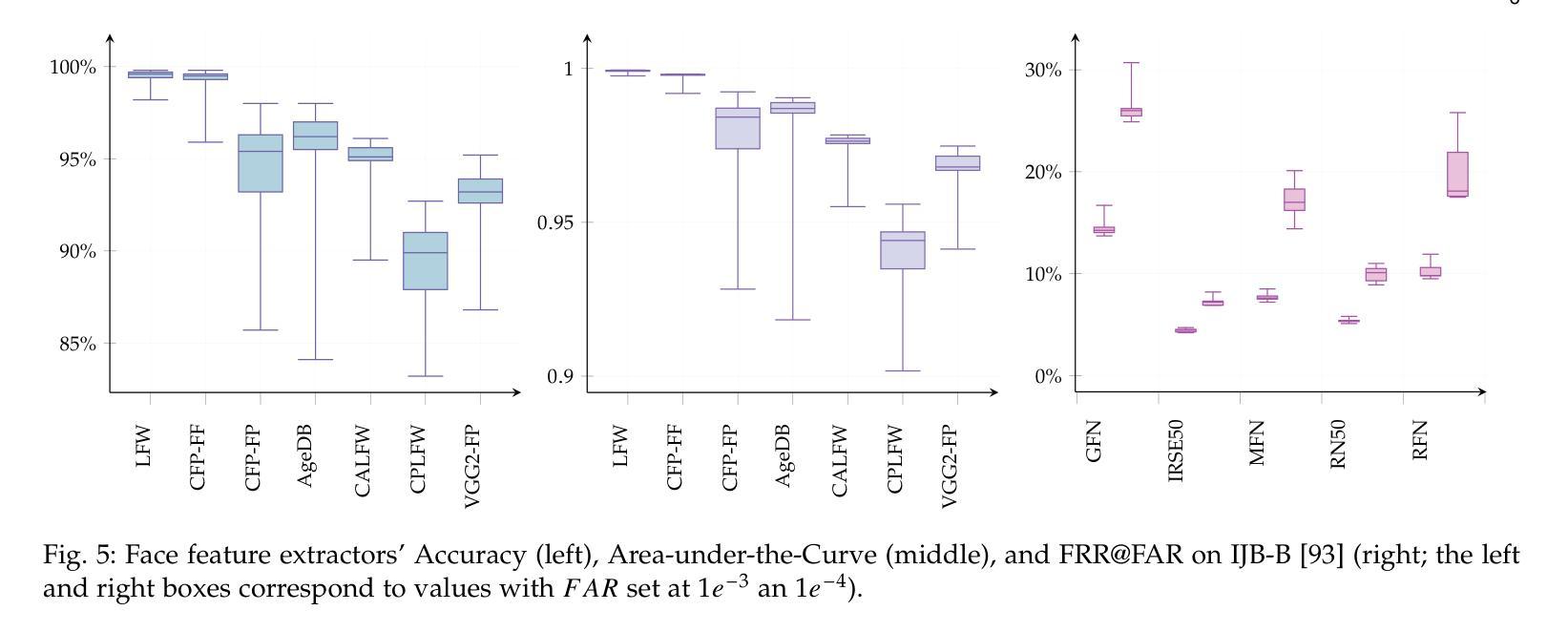

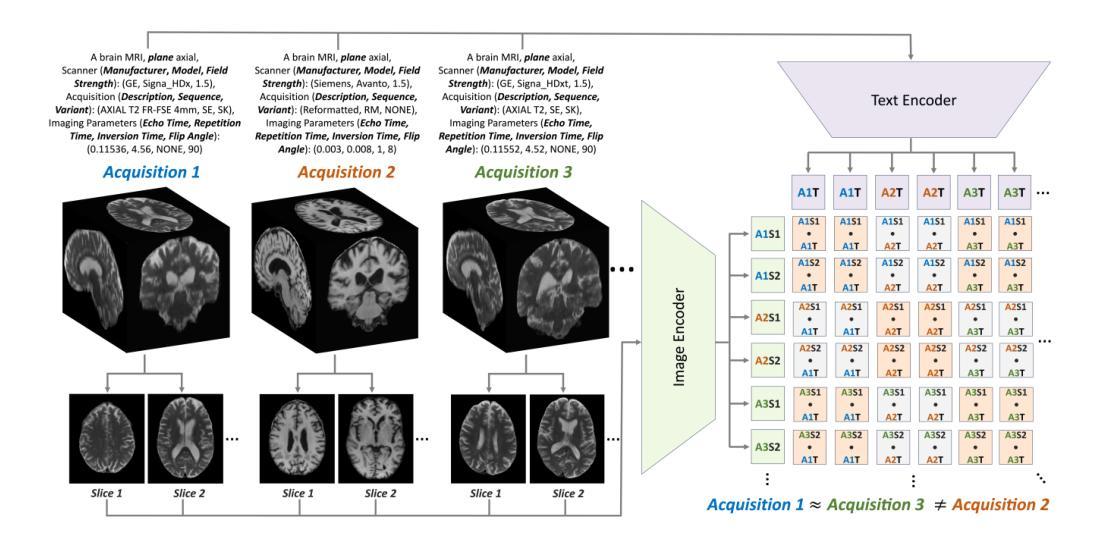

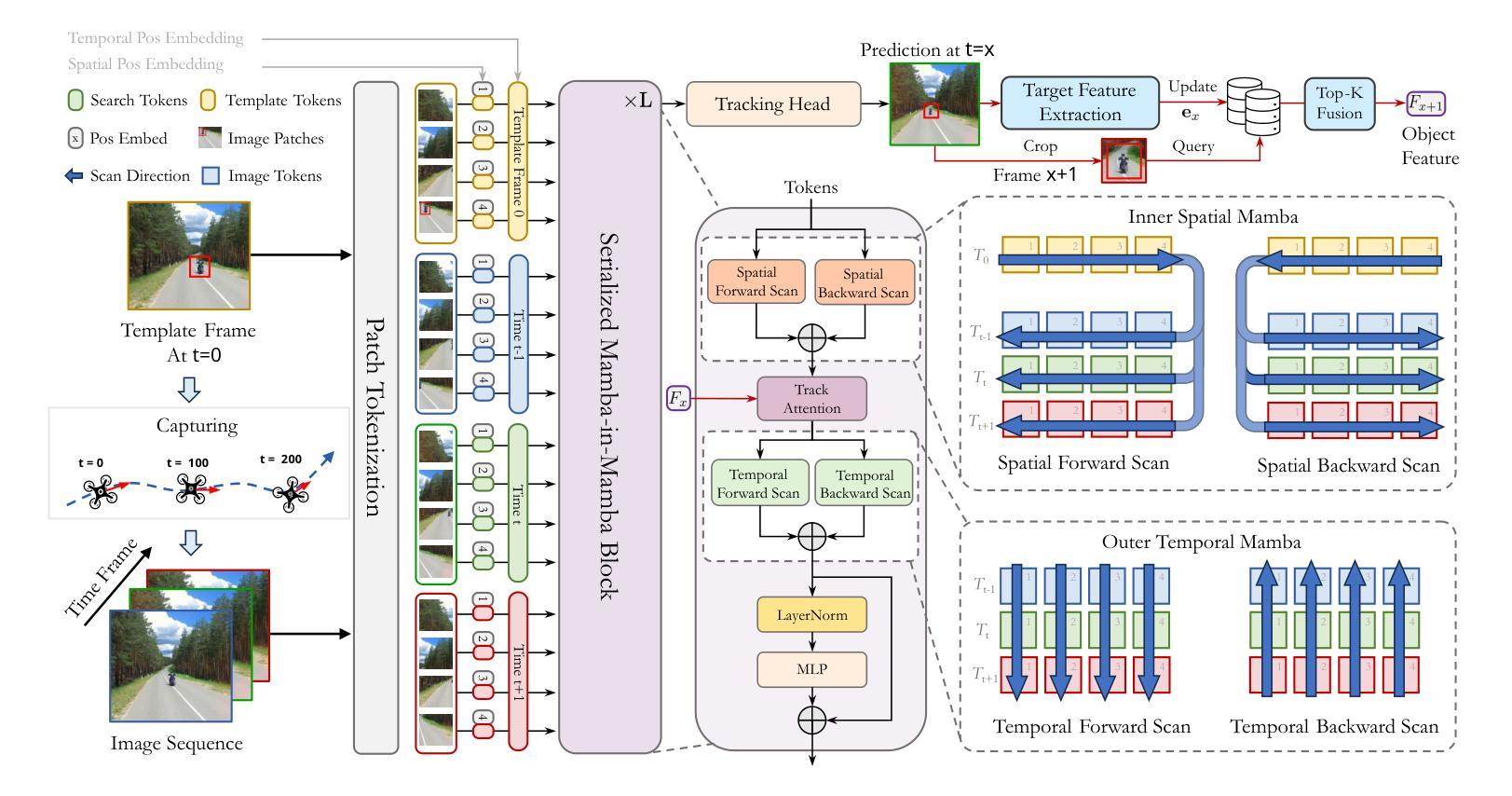

The widespread use of deep learning face recognition raises several security concerns. Although prior works point at existing vulnerabilities, DNN backdoor attacks against real-life, unconstrained systems dealing with images captured in the wild remain a blind spot of the literature. This paper conducts the first system-level study of backdoors in deep learning-based face recognition systems. This paper yields four contributions by exploring the feasibility of DNN backdoors on these pipelines in a holistic fashion. We demonstrate for the first time two backdoor attacks on the face detection task: face generation and face landmark shift attacks. We then show that face feature extractors trained with large margin losses also fall victim to backdoor attacks. Combining our models, we then show using 20 possible pipeline configurations and 15 attack cases that a single backdoor enables an attacker to bypass the entire function of a system. Finally, we provide stakeholders with several best practices and countermeasures.

深度学习面部识别的广泛应用引发了若干安全问题。尽管早期的研究指出了现有的漏洞,但针对现实生活中的非约束系统,对野外捕获图像进行深度学习的后门攻击仍然是文献中的盲点。本文对基于深度学习的面部识别系统中的后门进行了首次系统级别的研究。本文通过全面探索深度学习管道中DNN后门的可行性,做出了四项贡献。我们首次展示了面部检测任务中的两种后门攻击:面部生成攻击和面部地标转移攻击。然后,我们展示了使用大间距损失训练的面部特征提取器也受到后门攻击的影响。结合我们的模型,然后我们通过使用20种可能的管道配置和15种攻击情况表明,一个单一的后门可以使攻击者绕过系统的全部功能。最后,我们向利益相关者提供了若干最佳实践和对策。

论文及项目相关链接

Summary

人脸识别领域中深度学习模型被广泛应用引起了安全担忧。本文主要研究深度学习模型下的后门问题,提出一系列研究并开展实证测试。成功绕过系统后发现了多种攻击方式,并提出了一些最佳实践和应对措施。同时本文为应对该问题提供了有效的参考建议。本文的研究成果有助于人脸识别领域的安全性和稳健性提升。

Key Takeaways

以下是文中重要的几个观点和启示:

- 人脸识别领域的深度学习模型普及导致安全隐患提升。这些担忧源自尚未充分研究的后门问题。虽然过去的研究已经指出了一些漏洞,但关于在真实世界无约束系统中进行图像捕获的反面研究仍是一个盲点。此研究进行了首个系统级的关于深度学习人脸识别系统中后门问题的研究。这为深入研究该领域提供了新的视角和方法。同时提供了相关的最佳实践和应对措施,对于提高人脸识别系统的安全性和稳健性具有指导意义。此研究揭示了人脸识别领域中深度学习模型存在后门攻击的风险,提醒研究人员和企业注意防范。这为保障人脸识别系统的安全提供了有力的理论支撑和实践指导。通过深入研究该问题,可以推动人脸识别技术的进一步发展,并推动相关领域的进步。此外,本文还探讨了应对后门攻击的最佳实践和措施,对于防范类似攻击具有指导意义。通过本文对后门问题的深入研究,有助于提高人脸识别系统的安全性和可靠性,对于保障个人信息安全和隐私权益具有重要意义。总之,该论文的多个关键贡献将对人脸识别技术的未来发展产生重要影响,推动行业向前发展。未来应该进一步加强相关领域的研究和探索新的安全防范措施以保护人脸识别系统的安全稳定。同时,也需要关注该领域的技术进步和创新发展以应对日益复杂的安全挑战。

点此查看论文截图