⚠️ 以下所有内容总结都来自于 大语言模型的能力,如有错误,仅供参考,谨慎使用

🔴 请注意:千万不要用于严肃的学术场景,只能用于论文阅读前的初筛!

💗 如果您觉得我们的项目对您有帮助 ChatPaperFree ,还请您给我们一些鼓励!⭐️ HuggingFace免费体验

2025-07-04 更新

AstroECP: towards more practical Electron Channeling Contrast Imaging

Authors:M. Haroon Qaiser, Lukas Berners, Robin J. Scales, Tianbi Zhang, Martin Heller, Jiri Dluhos, Sandra Korte-Kerzel, T. Ben Britton

Electron channeling contrast imaging (ECCI) is a scanning electron microscopy (SEM) based technique that enables bulk-sample characterization of crystallographic defects (e.g. dislocations, stacking faults, low angle boundaries). Despite its potential, ECCI remains underused for quantitative defect analysis as compared to transmission electron microscope (TEM) based methods. Here, we overcome barriers that limit the use of ECCI including optimizing signal-to-noise contrast, precise determination of the incident beam vector with calibrated and easy to use simulations and experimental selected area electron channeling patterns (SA-ECP). We introduce a systematic ECCI workflow, alongside a new open-source software tool (AstroECP), that includes calibration of stage tilting, SA-ECP field of view, and the energy that forms the ECP/ECCI contrast using dynamical simulations. The functionality of this workflow is demonstrated with case studies that include threading dislocations in GaAs and the cross validation of precession based ECCI-contrast, which is otherwise known as Electron Channeling Orientation Determination (eCHORD). To assist the reader, we also provide best practice guidelines for ECCI implementation to promote high-resolution defect imaging in the SEM.

电子通道衬度成像(ECCI)是一种基于扫描电子显微镜(SEM)的技术,能够对晶体缺陷(如位错、层错、小角度边界)进行批量样品表征。尽管其潜力巨大,但与透射电子显微镜(TEM)方法相比,ECCI在定量缺陷分析方面的应用仍然较少。在这里,我们克服了限制ECCI使用的障碍,包括优化信噪比衬度、通过校准的易于使用的模拟和实验选区电子通道图案(SA-ECP)精确确定入射束矢量。我们系统地介绍了ECCI工作流程,以及新的开源软件工具AstroECP,包括校准台倾斜、SA-ECP视野以及形成ECP/ECCI衬度的能量动态模拟。通过包括GaAs中的贯穿位错案例研究在内的案例演示了该工作流程的功能,并对基于精度的ECCI衬度进行了交叉验证,这被称为电子通道取向测定(eCHORD)。为了协助读者,我们还提供了ECCI实施的最佳实践指南,以促进SEM中的高分辨率缺陷成像。

论文及项目相关链接

PDF as submitted version

Summary

本文介绍了电子通道对比成像(ECCI)技术及其在扫描电子显微镜(SEM)中的应用。文章强调了ECCI技术在晶体缺陷表征方面的潜力,并解决了其在实际应用中面临的问题,如信号噪声对比度的优化、入射光束矢量的精确确定等。此外,文章还介绍了一个系统性的ECCI工作流程以及一款新的开源软件工具AstroECP,该工具通过动态模拟校准舞台倾斜、选区电子通道模式(SA-ECP)的视野和产生ECP/ECCI对比度的能量。案例研究证实了这一工作流程的有效性,包括GaAs中的位错以及基于精确度的ECCI对比度的验证,最后还提供了实施ECCI的最佳实践指南,以促进SEM中的高分辨率缺陷成像。

Key Takeaways

- ECCI是一种基于扫描电子显微镜(SEM)的技术,用于表征晶体缺陷,如位错、堆积断层和低角度边界。

- ECCI在定量缺陷分析方面的应用潜力尚未得到充分发掘,与透射电子显微镜(TEM)方法相比仍有待普及。

- 文章克服了ECCI应用中的障碍,包括优化信号噪声对比度、精确确定入射光束矢量等。

- 介绍了一个系统性的ECCI工作流程,包括校准舞台倾斜、选区电子通道模式(SA-ECP)的视野和产生ECP/ECCI对比度的能量的步骤。

- 引入了一款新的开源软件工具AstroECP,用于动态模拟并校准ECCI的关键参数。

- 通过案例研究证实了工作流程的有效性,包括在GaAs中的位错分析以及精确度的ECCI对比度的验证。

点此查看论文截图

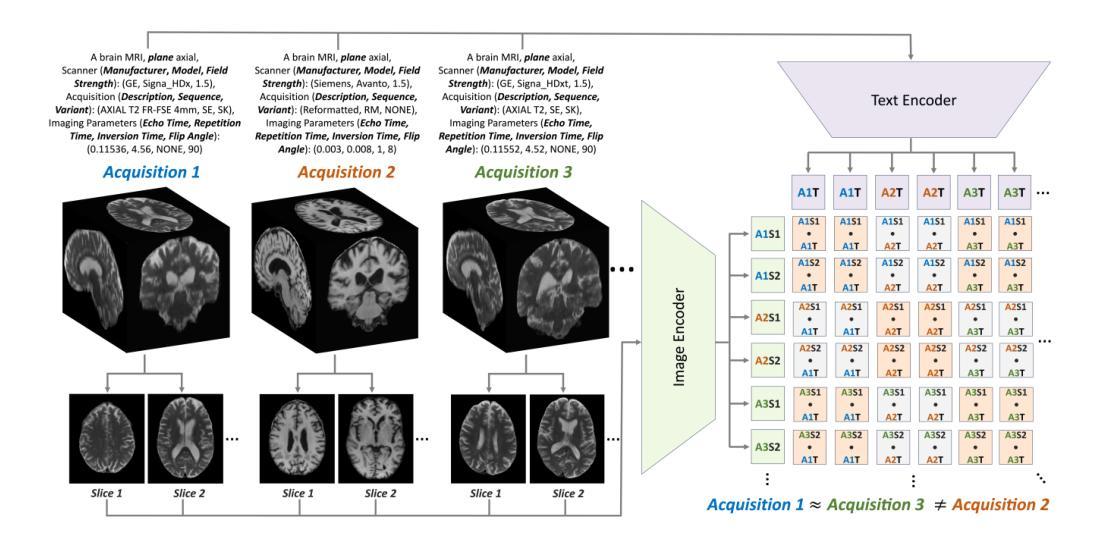

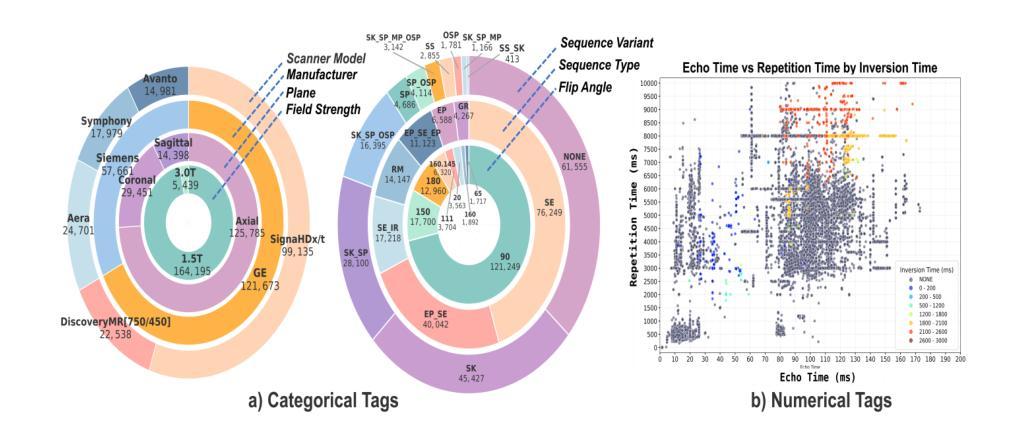

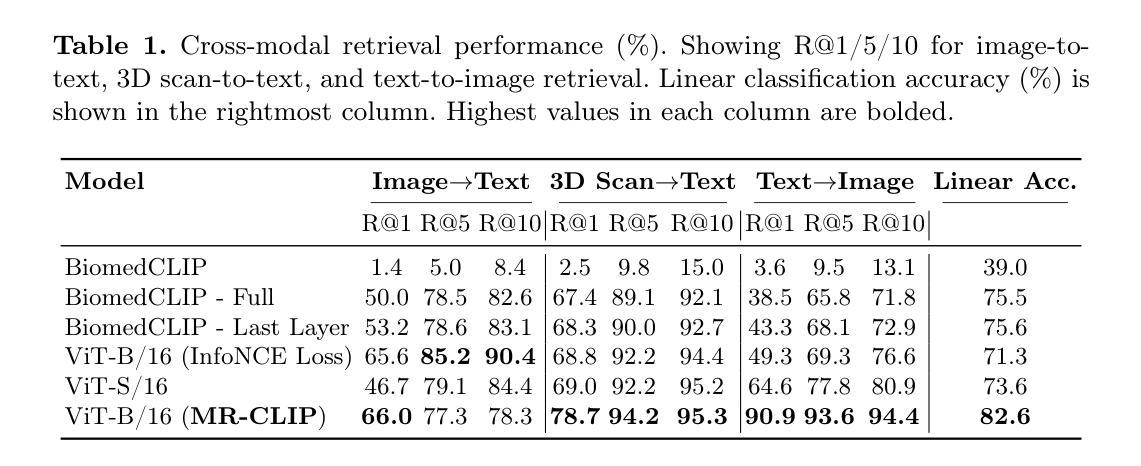

MR-CLIP: Efficient Metadata-Guided Learning of MRI Contrast Representations

Authors:Mehmet Yigit Avci, Pedro Borges, Paul Wright, Mehmet Yigitsoy, Sebastien Ourselin, Jorge Cardoso

Accurate interpretation of Magnetic Resonance Imaging scans in clinical systems is based on a precise understanding of image contrast. This contrast is primarily governed by acquisition parameters, such as echo time and repetition time, which are stored in the DICOM metadata. To simplify contrast identification, broad labels such as T1-weighted or T2-weighted are commonly used, but these offer only a coarse approximation of the underlying acquisition settings. In many real-world datasets, such labels are entirely missing, leaving raw acquisition parameters as the only indicators of contrast. Adding to this challenge, the available metadata is often incomplete, noisy, or inconsistent. The lack of reliable and standardized metadata complicates tasks such as image interpretation, retrieval, and integration into clinical workflows. Furthermore, robust contrast-aware representations are essential to enable more advanced clinical applications, such as achieving modality-invariant representations and data harmonization. To address these challenges, we propose MR-CLIP, a multimodal contrastive learning framework that aligns MR images with their DICOM metadata to learn contrast-aware representations, without relying on manual labels. Trained on a diverse clinical dataset that spans various scanners and protocols, MR-CLIP captures contrast variations across acquisitions and within scans, enabling anatomy-invariant representations. We demonstrate its effectiveness in cross-modal retrieval and contrast classification, highlighting its scalability and potential for further clinical applications. The code and weights are publicly available at https://github.com/myigitavci/MR-CLIP.

磁共振成像在临床系统中的准确解读,是基于对图像对比度的精确理解。这种对比度主要由采集参数决定,例如回声时间和重复时间,这些参数都存储在DICOM元数据中。为了简化对比度的识别,通常使用诸如T1加权或T2加权等广泛标签,但这些仅提供了对基础采集设置的粗略近似。在许多真实世界的数据集中,这些标签完全缺失,只留下原始的采集参数作为对比度的唯一指标。除此之外,现有的元数据通常不完整、嘈杂或不一致。缺乏可靠和标准化的元数据使图像解读、检索和集成到临床工作流程等任务变得复杂。此外,稳健的对比度感知表示对于实现更先进的临床应用至关重要,例如实现模态不变表示和数据调和。为了解决这些挑战,我们提出了MR-CLIP,这是一个多模态对比学习框架,它将MR图像与它们的DICOM元数据对齐,以学习对比度感知表示,而无需依赖手动标签。在涵盖各种扫描器和协议的多样临床数据集上进行训练,MR-CLIP能够捕获跨采集和扫描内的对比度变化,实现解剖结构不变表示。我们在跨模态检索和对比度分类中展示了其有效性,突出了其可扩展性和进一步临床应用的潜力。代码和权重可在https://github.com/myigitavci/MR-CLIP上公开获得。

论文及项目相关链接

Summary

本文探讨了磁共振成像(MRI)在临床系统中的准确解读问题,重点介绍了图像对比度的识别与理解。文章指出,对比度主要由采集参数决定,如回声时间和重复时间,这些参数存储在DICOM元数据中。文章提出MR-CLIP方法,通过多模态对比学习框架对齐MR图像与其DICOM元数据,学习对比度感知表示,无需手动标签。该方法在跨模态检索和对比度分类任务中表现出色,具有可扩展性和潜在的临床应用价值。

Key Takeaways

- 磁共振成像(MRI)在临床系统中的准确解读依赖于对图像对比度的精确理解。

- 对比度主要由采集参数决定,如回声时间和重复时间,这些参数存储在DICOM元数据中。

- 现有的对比度标识方法如T1加权或T2加权只提供粗略的采集设置近似值,且在实际数据集中这些标签可能完全缺失。

- 可用的元数据常常不完整、嘈杂或不一致,使得图像解读、检索和整合到临床工作流程中更加困难。

- 对比度感知表示对于实现更高级的临床应用至关重要,如实现模态不变表示和数据和谐化。

- MR-CLIP方法通过多模态对比学习框架对齐MR图像与DICOM元数据,学习对比度感知表示,无需依赖手动标签。

点此查看论文截图