⚠️ 以下所有内容总结都来自于 大语言模型的能力,如有错误,仅供参考,谨慎使用

🔴 请注意:千万不要用于严肃的学术场景,只能用于论文阅读前的初筛!

💗 如果您觉得我们的项目对您有帮助 ChatPaperFree ,还请您给我们一些鼓励!⭐️ HuggingFace免费体验

2025-08-15 更新

Hybrid Generative Fusion for Efficient and Privacy-Preserving Face Recognition Dataset Generation

Authors:Feiran Li, Qianqian Xu, Shilong Bao, Boyu Han, Zhiyong Yang, Qingming Huang

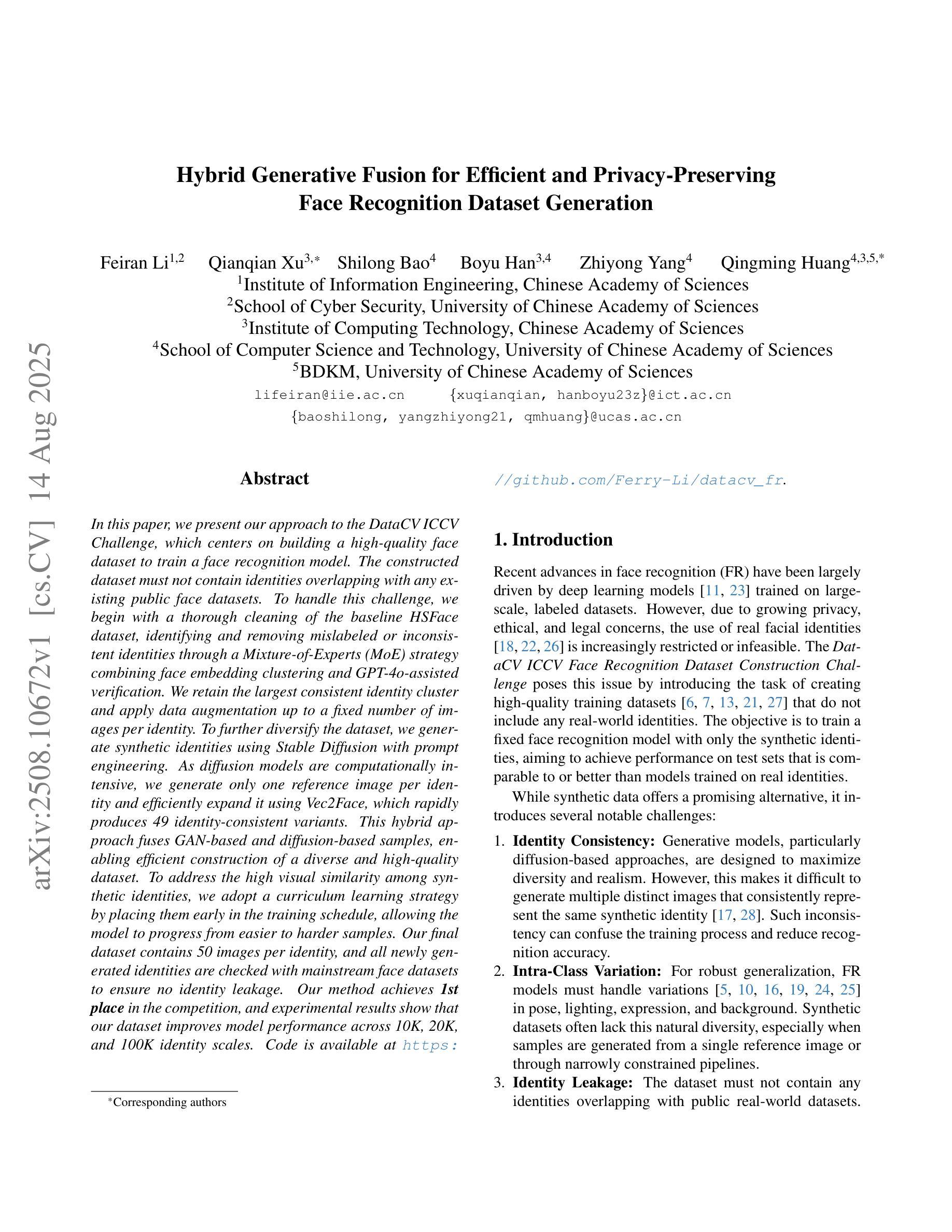

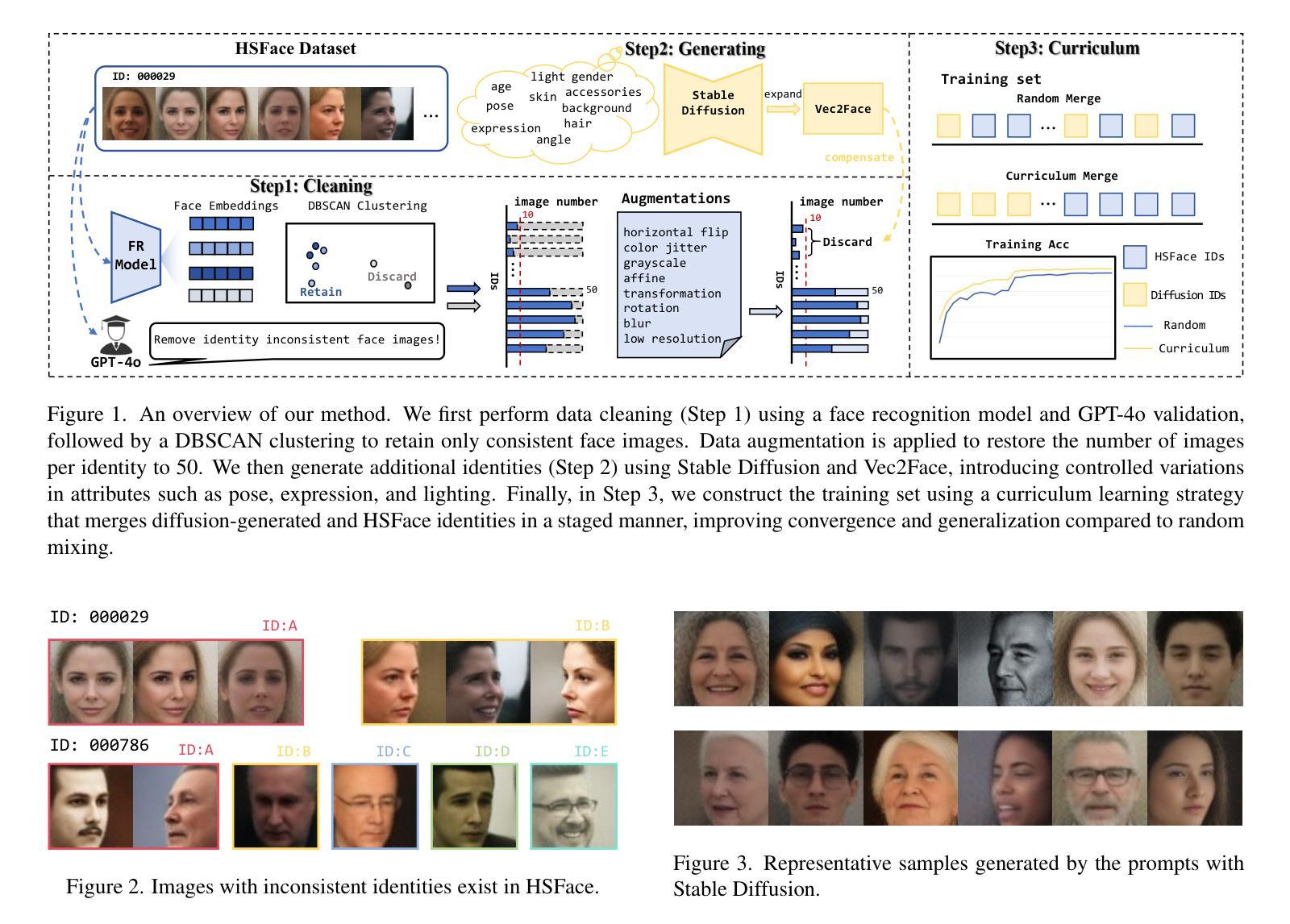

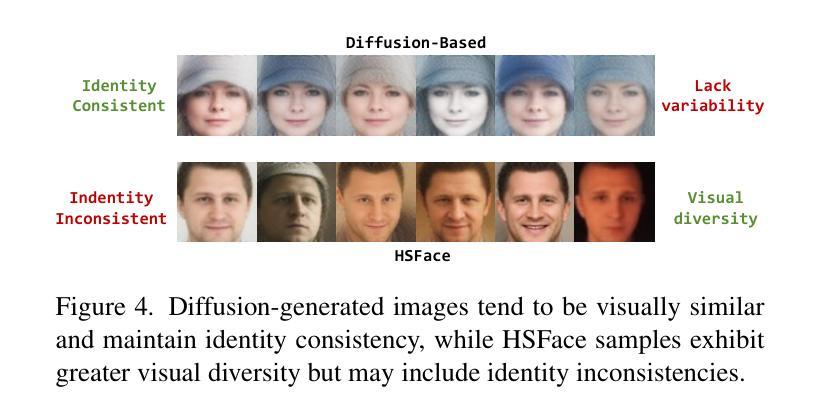

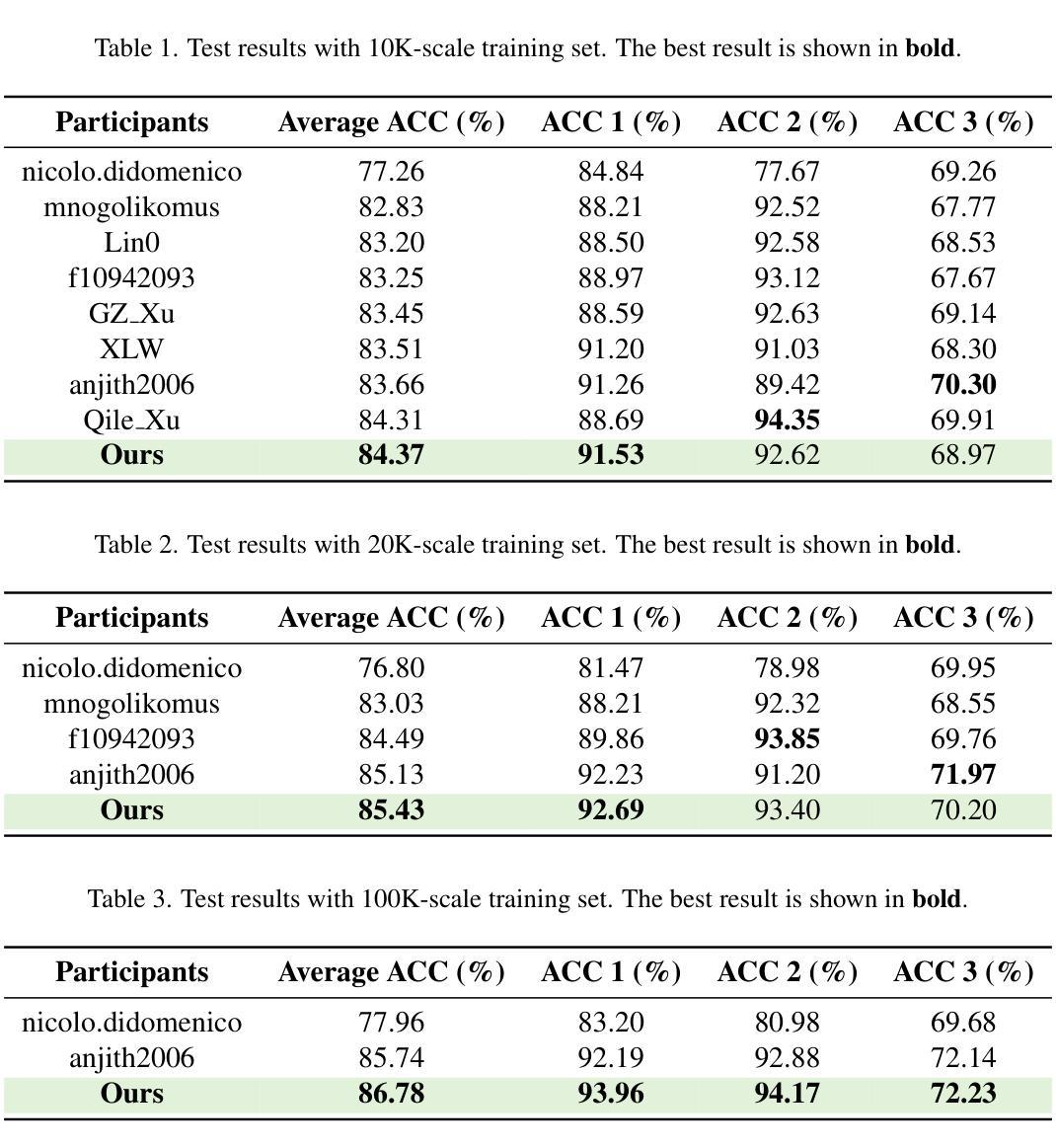

In this paper, we present our approach to the DataCV ICCV Challenge, which centers on building a high-quality face dataset to train a face recognition model. The constructed dataset must not contain identities overlapping with any existing public face datasets. To handle this challenge, we begin with a thorough cleaning of the baseline HSFace dataset, identifying and removing mislabeled or inconsistent identities through a Mixture-of-Experts (MoE) strategy combining face embedding clustering and GPT-4o-assisted verification. We retain the largest consistent identity cluster and apply data augmentation up to a fixed number of images per identity. To further diversify the dataset, we generate synthetic identities using Stable Diffusion with prompt engineering. As diffusion models are computationally intensive, we generate only one reference image per identity and efficiently expand it using Vec2Face, which rapidly produces 49 identity-consistent variants. This hybrid approach fuses GAN-based and diffusion-based samples, enabling efficient construction of a diverse and high-quality dataset. To address the high visual similarity among synthetic identities, we adopt a curriculum learning strategy by placing them early in the training schedule, allowing the model to progress from easier to harder samples. Our final dataset contains 50 images per identity, and all newly generated identities are checked with mainstream face datasets to ensure no identity leakage. Our method achieves \textbf{1st place} in the competition, and experimental results show that our dataset improves model performance across 10K, 20K, and 100K identity scales. Code is available at https://github.com/Ferry-Li/datacv_fr.

本文中,我们介绍了针对DataCV ICCV挑战赛的方法,该挑战赛的重点是构建高质量的人脸数据集来训练人脸识别模型。构建的数据集不应包含与任何现有公共人脸数据集重叠的身份。为了应对这一挑战,我们从彻底清理基线HSFace数据集开始,通过结合人脸嵌入聚类和GPT-4o辅助验证的专家混合(MoE)策略,识别并移除错误标记或身份不一致的情况。我们保留最大的连续身份集群,并对每个身份的图像进行最多数据增强至固定数量。为了进一步完善数据集多样化,我们使用带有提示工程的Stable Diffusion生成合成身份。由于扩散模型计算量大,我们为每个身份只生成一个参考图像,并使用Vec2Face高效地对其进行扩展,Vec2Face可以快速生成49个身份一致的变体。这种混合方法融合了基于GAN和基于扩散的样本,能够高效地构建多样且高质量的数据集。针对合成身份之间的高视觉相似性,我们采用了一种课程学习策略,将它们尽早纳入训练计划,让模型从简单样本过渡到复杂样本。我们的最终数据集每个身份包含50张图像,所有新生成的身份都与主流人脸数据集进行了检查,以确保没有身份泄露。我们的方法在比赛中获得第一名,实验结果表明,我们的数据集在1万、2万和十万个身份规模上均提高了模型性能。代码可通过https://github.com/Ferry-Li/datacv_fr访问。

论文及项目相关链接

PDF This paper has been accpeted to ICCV 2025 DataCV Workshop

Summary

该文介绍了一种针对DataCV ICCV挑战赛的方法,重点是如何构建一个高质量的人脸数据集来训练人脸识别模型。通过清洗HSFace数据集,采用混合专家策略进行人脸嵌入聚类和GPT-4o辅助验证,去除误标或身份不一致的数据。对最大的身份集群进行数据增强,并通过Stable Diffusion生成合成身份以丰富数据集。使用Vec2Face快速生成多个一致性的变体,融合GAN和扩散模型样本。采用课程学习策略解决合成身份视觉相似度高的问题。最终数据集包含每身份50张图像,新生成身份经主流人脸数据集检查无身份泄露。该方法在比赛中获得第一名,实验结果表明数据集在10K、20K和100K身份规模上提高了模型性能。

Key Takeaways

- 该方法针对DataCV ICCV挑战赛,专注于构建高质量人脸数据集以训练人脸识别模型。

- 通过清洗HSFace数据集并去除误标或身份不一致数据来提高数据集质量。

- 采用Mix-of-Experts策略结合人脸嵌入聚类和GPT-4o辅助验证进行数据处理。

- 通过Stable Diffusion生成合成身份并使用Vec2Face快速生成一致性变体来丰富数据集。

- 融合GAN和扩散模型样本,构建高效多样的高质量数据集。

- 采用课程学习策略解决合成身份视觉相似度问题。

点此查看论文截图

When Deepfakes Look Real: Detecting AI-Generated Faces with Unlabeled Data due to Annotation Challenges

Authors:Zhiqiang Yang, Renshuai Tao, Xiaolong Zheng, Guodong Yang, Chunjie Zhang

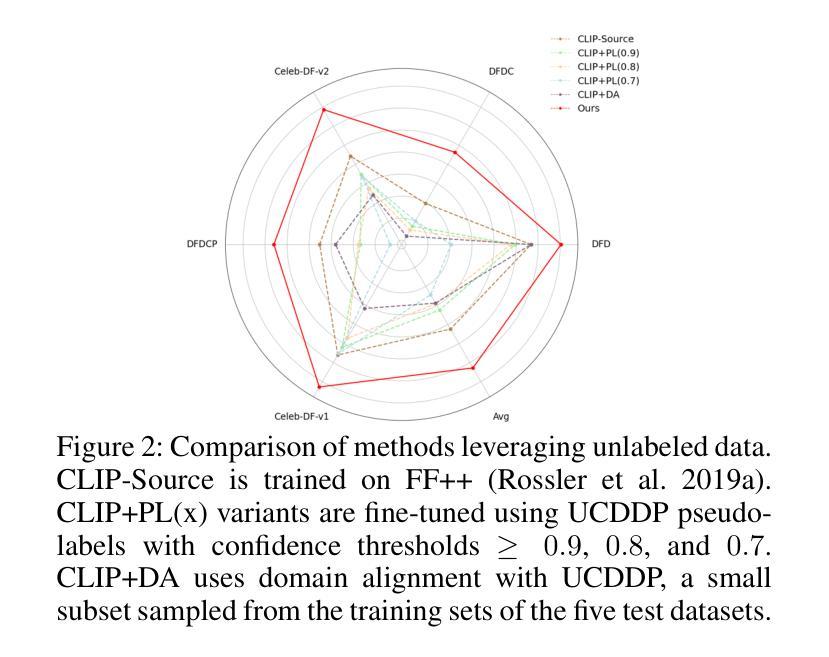

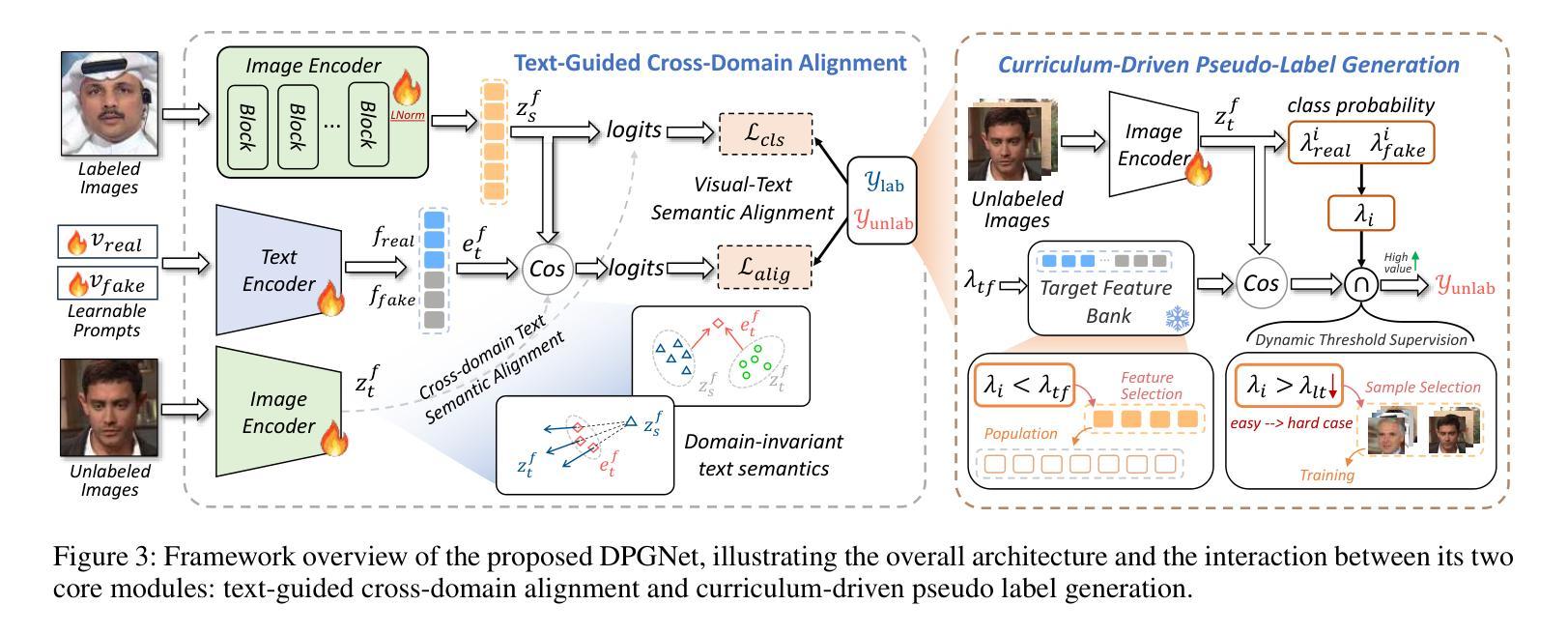

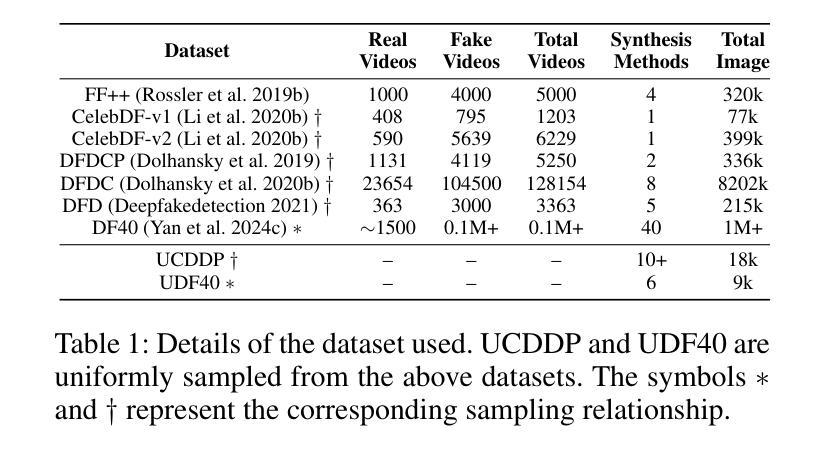

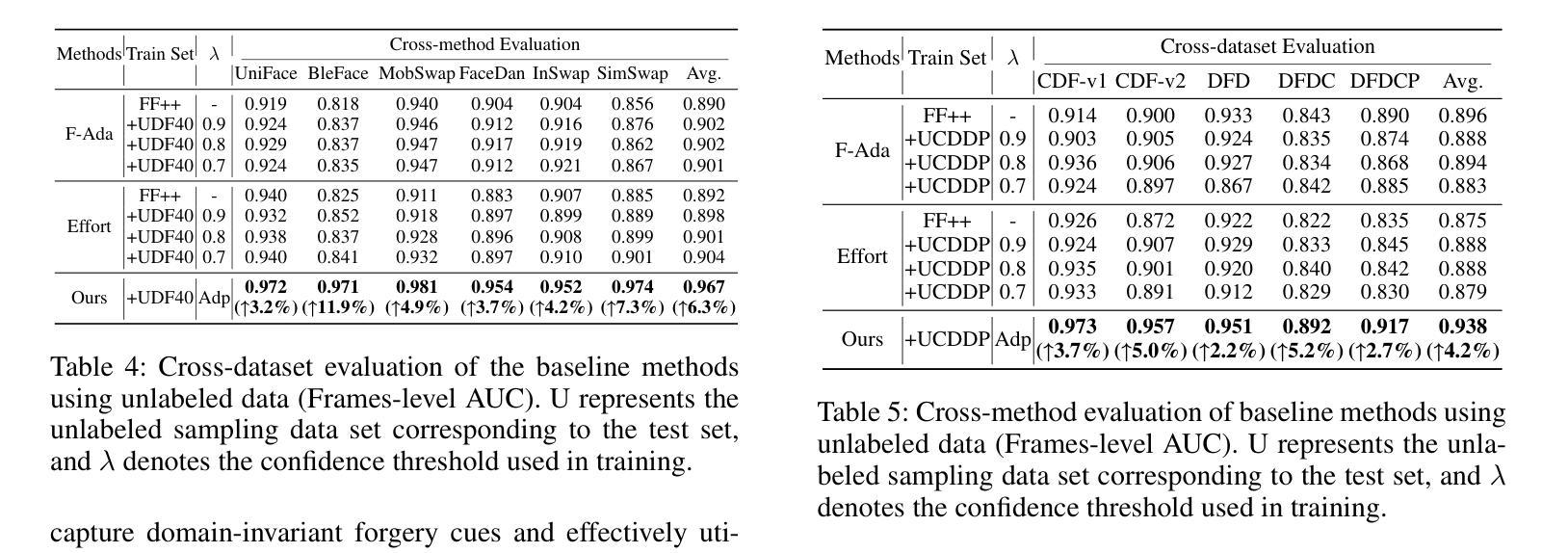

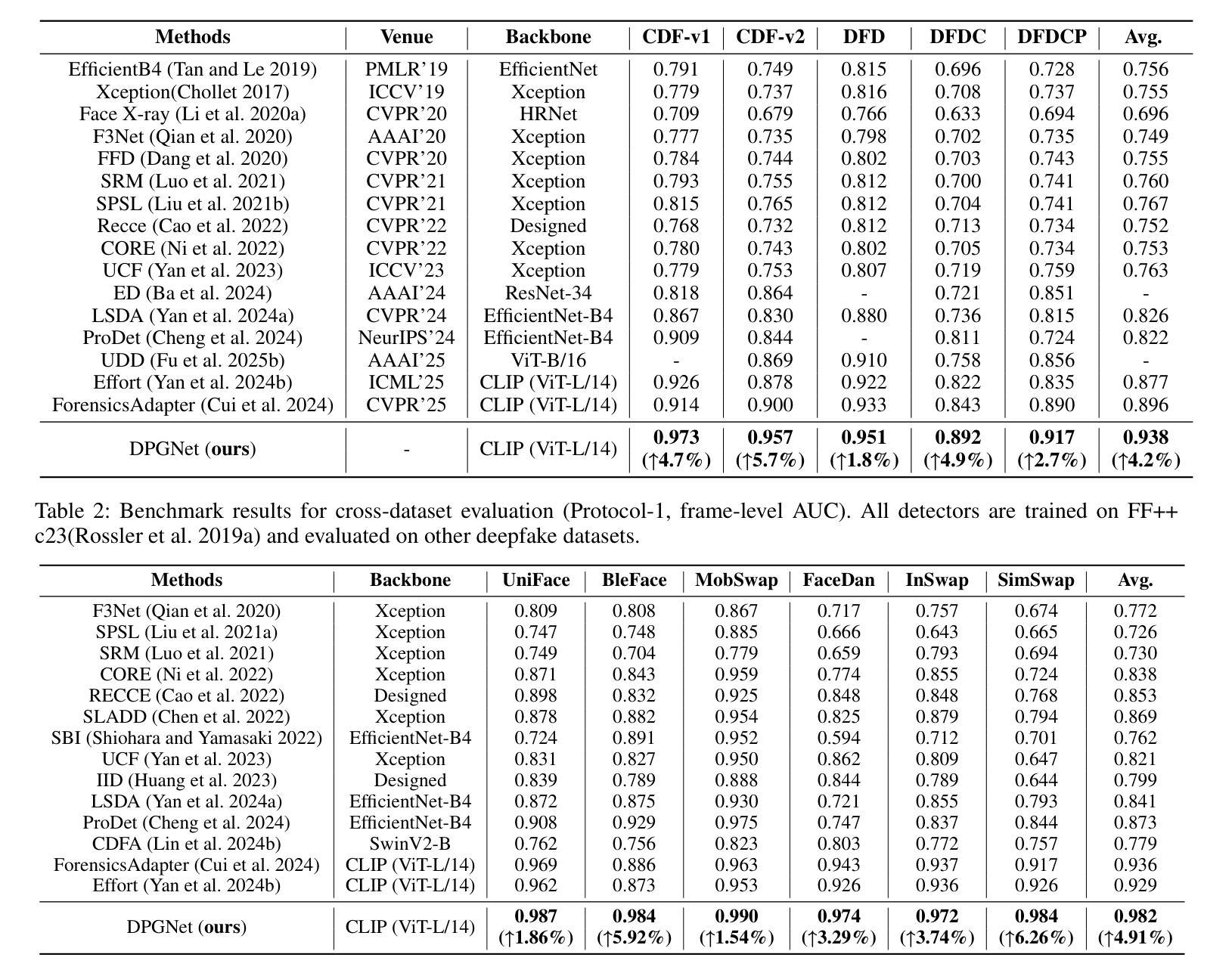

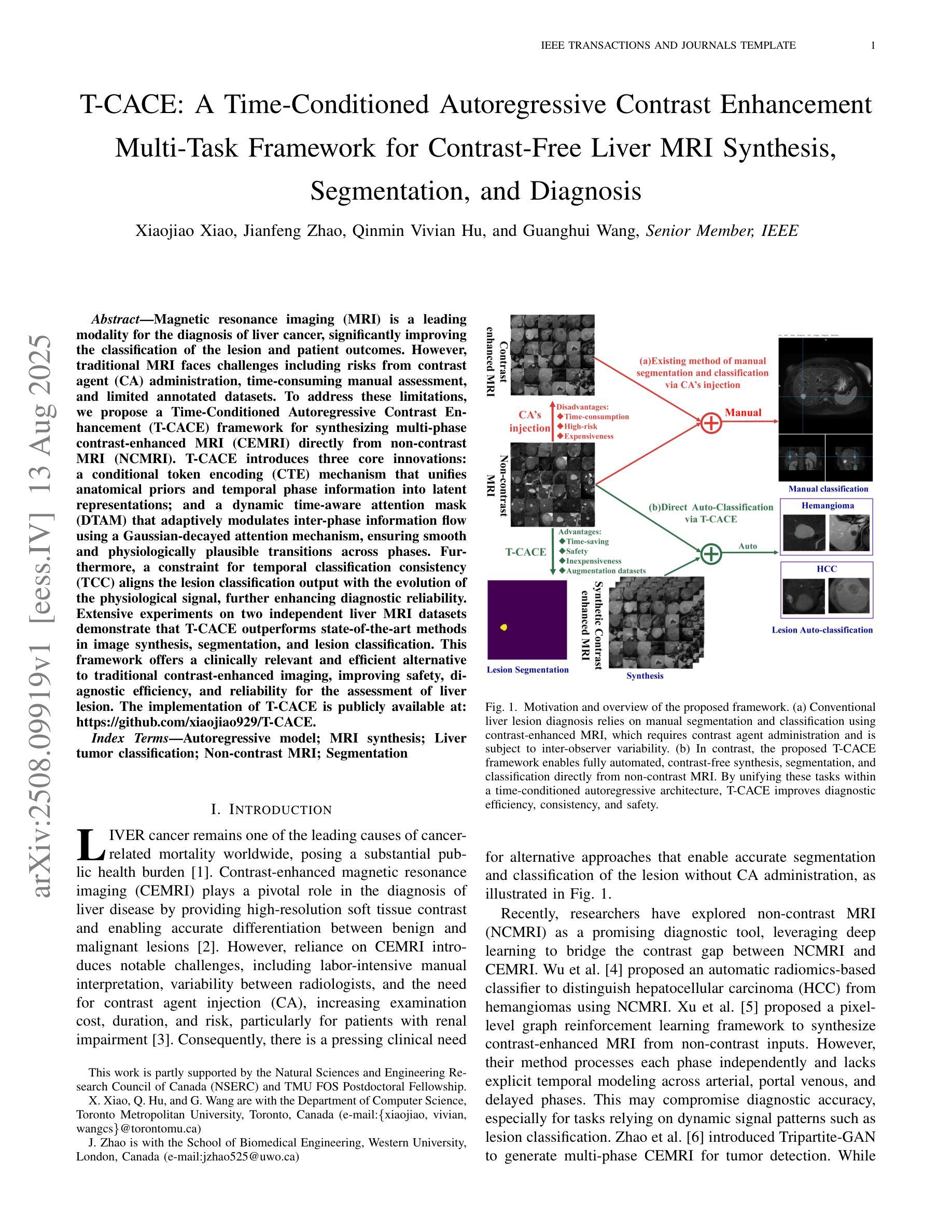

Existing deepfake detection methods heavily depend on labeled training data. However, as AI-generated content becomes increasingly realistic, even \textbf{human annotators struggle to distinguish} between deepfakes and authentic images. This makes the labeling process both time-consuming and less reliable. Specifically, there is a growing demand for approaches that can effectively utilize large-scale unlabeled data from online social networks. Unlike typical unsupervised learning tasks, where categories are distinct, AI-generated faces closely mimic real image distributions and share strong similarities, causing performance drop in conventional strategies. In this paper, we introduce the Dual-Path Guidance Network (DPGNet), to tackle two key challenges: (1) bridging the domain gap between faces from different generation models, and (2) utilizing unlabeled image samples. The method features two core modules: text-guided cross-domain alignment, which uses learnable prompts to unify visual and textual embeddings into a domain-invariant feature space, and curriculum-driven pseudo label generation, which dynamically exploit more informative unlabeled samples. To prevent catastrophic forgetting, we also facilitate bridging between domains via cross-domain knowledge distillation. Extensive experiments on \textbf{11 popular datasets}, show that DPGNet outperforms SoTA approaches by \textbf{6.3%}, highlighting its effectiveness in leveraging unlabeled data to address the annotation challenges posed by the increasing realism of deepfakes.

现有深度伪造检测的方法高度依赖于标记的训练数据。然而,随着人工智能生成的内容越来越逼真,即使是人类标注者也很难区分深度伪造图像和真实图像。这使得标注过程既耗时又不太可靠。具体来说,对于能够有效利用来自在线社交网络的大规模未标记数据的方法的需求不断增长。与典型的无监督学习任务不同,其中类别是明确的,人工智能生成的面部紧密地模仿真实图像分布并具有强烈的相似性,导致传统策略的绩效下降。在本文中,我们介绍了双路径引导网络(DPGNet),以解决两个关键挑战:(1)弥合不同生成模型之间的面部领域差距;(2)利用未标记的图像样本。该方法具有两个核心模块:文本引导跨域对齐,使用可学习的提示来统一视觉和文本嵌入到一个域不变的特征空间;以及课程驱动的伪标签生成,动态利用更多信息丰富的未标记样本。为防止灾难性遗忘,我们还通过跨域知识蒸馏促进不同领域之间的桥梁建立。在\textbf{11个流行数据集上的广泛实验表明,DPGNet比最新技术高出\textbf{6.3%},这突显了其在利用未标记数据解决深度伪造日益逼真的标注挑战方面的有效性。

论文及项目相关链接

PDF 10pages,5figures

Summary

人脸检测新方法研究应对AI生成内容的挑战。当前深度伪造检测依赖标注数据,但面临标注过程耗时、不可靠的问题。提出一种名为DPGNet的双路径指导网络,解决了不同生成模型间人脸域的差距问题,并利用未标记图像样本。通过文本引导跨域对齐和课程驱动伪标签生成两个核心模块实现。实验证明DPGNet在多个数据集上的性能优于现有方法,有效应对深度伪造真实性提升带来的标注挑战。

Key Takeaways

- 当前深度伪造检测依赖于标注数据,但面临标注过程耗时和可靠性问题。

- AI生成的人脸内容越来越逼真,使得人类标注者也难以区分真伪。

- 存在对能利用大量在线社交网络无标签数据的方法的需求。

- DPGNet解决了不同生成模型间人脸域的差距问题,并使用了未标记的图像样本。

- DPGNet通过文本引导跨域对齐和课程驱动伪标签生成两个核心模块实现高效性能。

- 在多个数据集上的实验证明DPGNet性能优于现有方法,能有效应对深度伪造真实性提升带来的挑战。

点此查看论文截图