⚠️ 以下所有内容总结都来自于 大语言模型的能力,如有错误,仅供参考,谨慎使用

🔴 请注意:千万不要用于严肃的学术场景,只能用于论文阅读前的初筛!

💗 如果您觉得我们的项目对您有帮助 ChatPaperFree ,还请您给我们一些鼓励!⭐️ HuggingFace免费体验

2025-09-09 更新

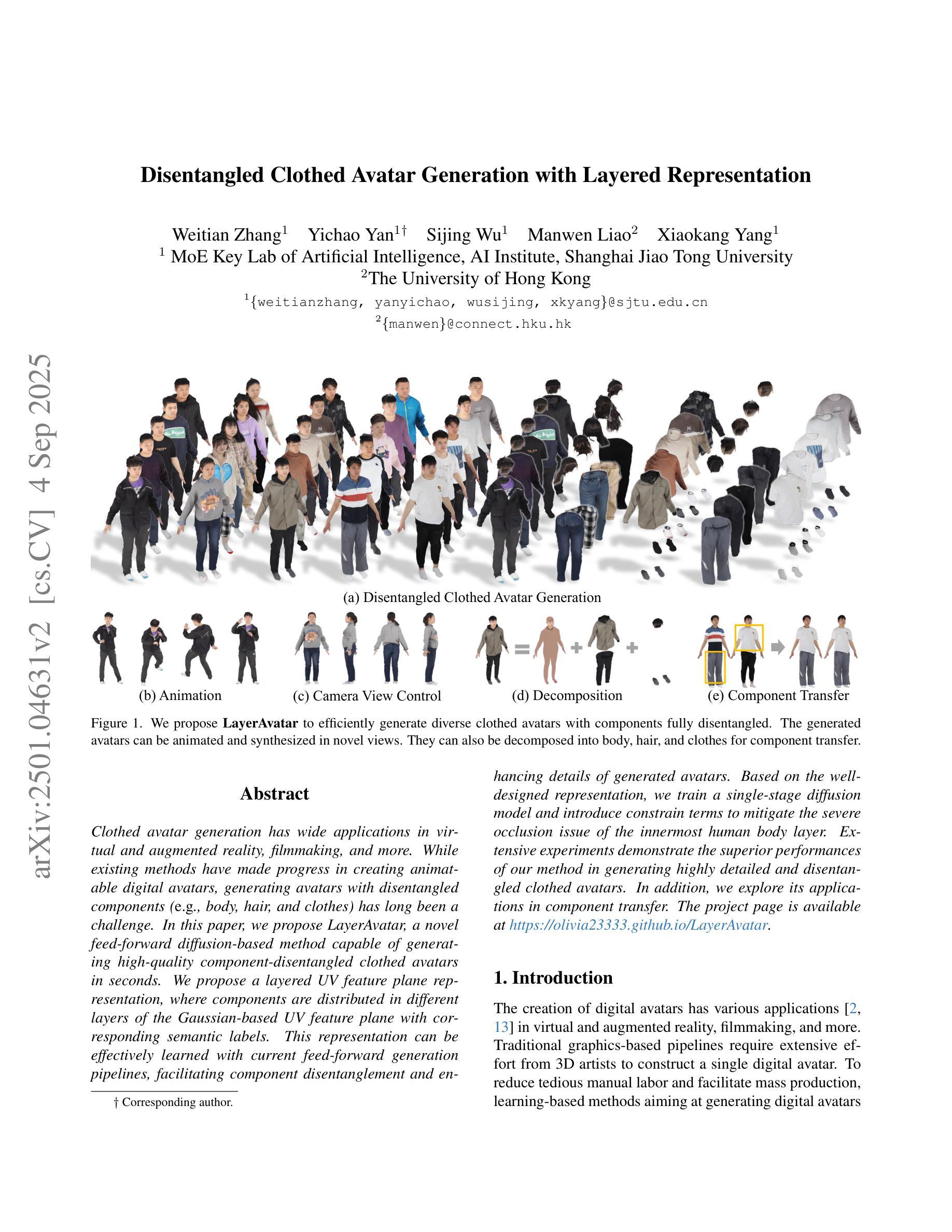

Disentangled Clothed Avatar Generation with Layered Representation

Authors:Weitian Zhang, Yichao Yan, Sijing Wu, Manwen Liao, Xiaokang Yang

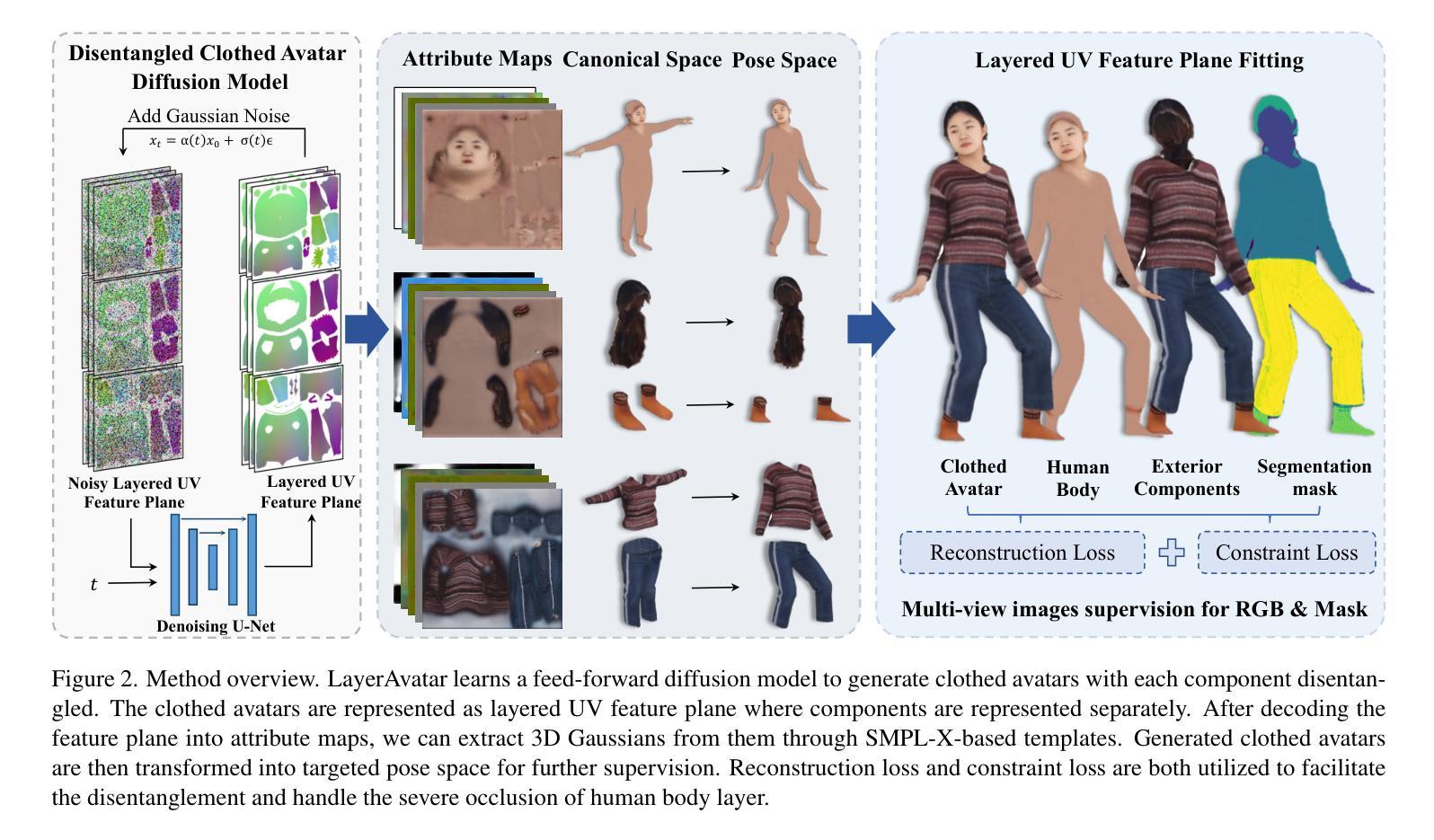

Clothed avatar generation has wide applications in virtual and augmented reality, filmmaking, and more. Previous methods have achieved success in generating diverse digital avatars, however, generating avatars with disentangled components (\eg, body, hair, and clothes) has long been a challenge. In this paper, we propose LayerAvatar, the first feed-forward diffusion-based method for generating component-disentangled clothed avatars. To achieve this, we first propose a layered UV feature plane representation, where components are distributed in different layers of the Gaussian-based UV feature plane with corresponding semantic labels. This representation supports high-resolution and real-time rendering, as well as expressive animation including controllable gestures and facial expressions. Based on the well-designed representation, we train a single-stage diffusion model and introduce constrain terms to address the severe occlusion problem of the innermost human body layer. Extensive experiments demonstrate the impressive performances of our method in generating disentangled clothed avatars, and we further explore its applications in component transfer. The project page is available at: https://olivia23333.github.io/LayerAvatar/

衣物化身生成在虚拟和增强现实、电影制作等领域具有广泛的应用。先前的方法已经在生成多样化的数字化身方面取得了成功,然而,生成具有分离组件(例如身体、头发和衣服)的化身一直是一个挑战。在本文中,我们提出了LayerAvatar,这是一种基于前馈扩散的方法,用于生成组件分离的穿衣化身。为了实现这一点,我们首先提出了一种分层UV特征平面表示法,其中组件根据相应的语义标签分布在基于高斯分布的UV特征平面的不同层中。这种表示法支持高分辨率和实时渲染,以及包括可控手势和面部表情在内的生动动画。基于这种精心设计的设计表示法,我们训练了一个单阶段扩散模型,并引入了约束项来解决最内层人体层的严重遮挡问题。大量实验证明了我们方法在生成分离的穿衣化身方面的出色表现,并进一步探索了其在组件转移中的应用。项目页面可在:[https://olivia23333.github.io/LayerAvatar/] 进行查看。

论文及项目相关链接

PDF ICCV 2025 highlight, project page: https://olivia23333.github.io/LayerAvatar/

Summary

基于层状UV特征平面的表示方法,LayerAvatar通过单一阶段的扩散模型解决了生成组件分离衣物的问题,为虚拟世界和增强现实等领域带来广泛的衣物生成应用。该模型支持高质量渲染和实时动画,具有强大的控制能力。LayerAvatar项目成功应对最内层人物图层严重的遮挡问题,扩展性强并适合应用在未来角色创作的领域。项目详细信息可在LayerAvatar项目网页上找到。

Key Takeaways

一、LayerAvatar提出了一个创新的层状UV特征平面表示方法,实现了组件分离的衣物生成。该方法通过将不同的组件分布在高斯UV特征平面的不同层上,为虚拟角色生成提供了强大的工具。

二、模型可以生成具有丰富细节和真实感的衣物效果,并具备实时渲染能力,可广泛应用于虚拟世界和增强现实等领域。

三、LayerAvatar通过单一阶段的扩散模型解决了衣物生成中的遮挡问题,提高了模型的性能和应用范围。

四、模型支持角色动画的灵活性和可扩展性,能够创造出可控的手势和面部表情。

五、实验证明了LayerAvatar方法在生成分离衣物上的优越性能。

六、该方法的实际应用已经拓展到了角色创作的其他领域,例如虚拟角色的衣物换装等。

点此查看论文截图