⚠️ 以下所有内容总结都来自于 大语言模型的能力,如有错误,仅供参考,谨慎使用

🔴 请注意:千万不要用于严肃的学术场景,只能用于论文阅读前的初筛!

💗 如果您觉得我们的项目对您有帮助 ChatPaperFree ,还请您给我们一些鼓励!⭐️ HuggingFace免费体验

2025-09-09 更新

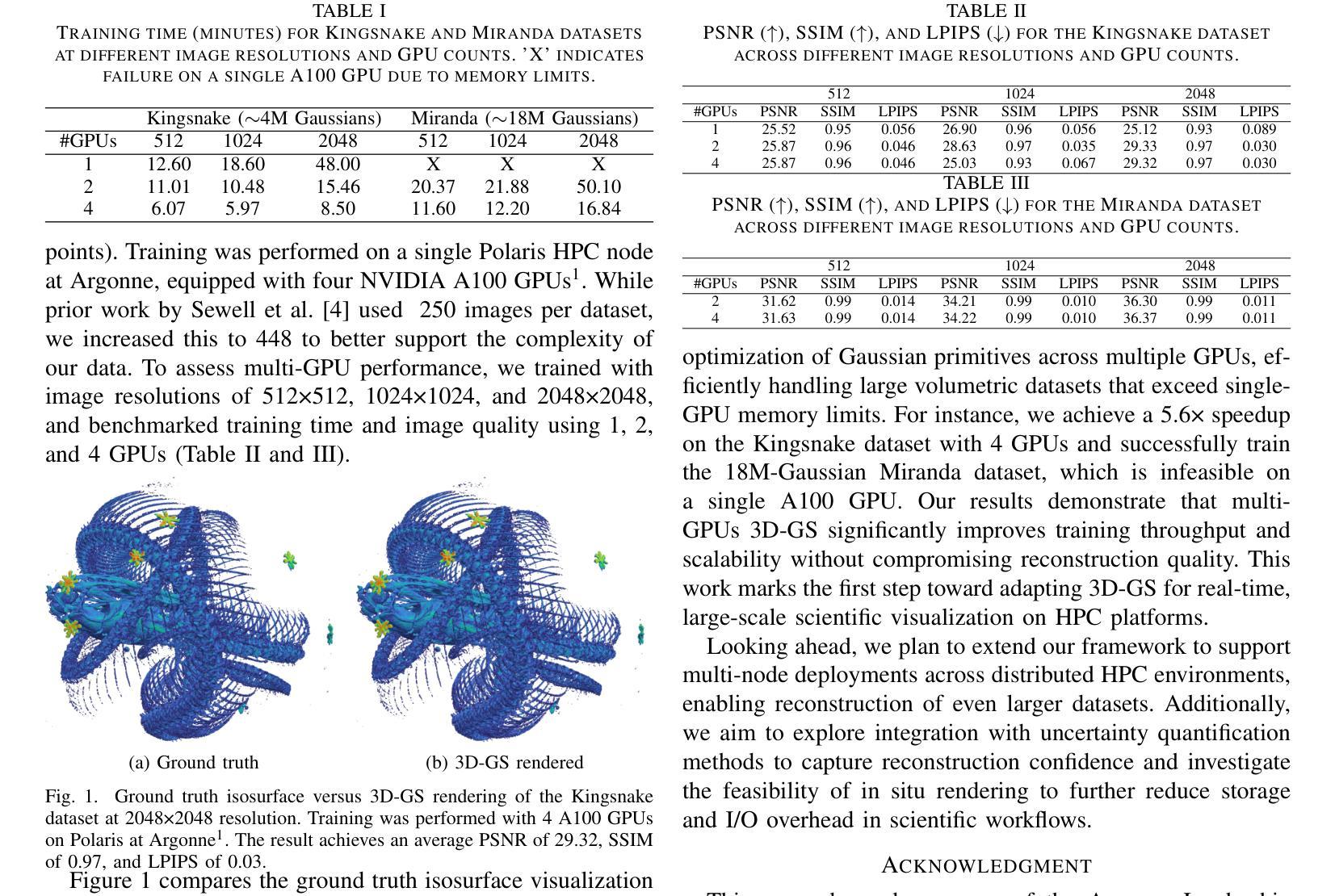

Toward Distributed 3D Gaussian Splatting for High-Resolution Isosurface Visualization

Authors:Mengjiao Han, Andres Sewell, Joseph Insley, Janet Knowles, Victor A. Mateevitsi, Michael E. Papka, Steve Petruzza, Silvio Rizzi

We present a multi-GPU extension of the 3D Gaussian Splatting (3D-GS) pipeline for scientific visualization. Building on previous work that demonstrated high-fidelity isosurface reconstruction using Gaussian primitives, we incorporate a multi-GPU training backend adapted from Grendel-GS to enable scalable processing of large datasets. By distributing optimization across GPUs, our method improves training throughput and supports high-resolution reconstructions that exceed single-GPU capacity. In our experiments, the system achieves a 5.6X speedup on the Kingsnake dataset (4M Gaussians) using four GPUs compared to a single-GPU baseline, and successfully trains the Miranda dataset (18M Gaussians) that is an infeasible task on a single A100 GPU. This work lays the groundwork for integrating 3D-GS into HPC-based scientific workflows, enabling real-time post hoc and in situ visualization of complex simulations.

我们为科学可视化领域提出了一种基于多GPU的3D高斯混合(3D-GS)管道扩展方案。我们以前的工作已经展示了使用高斯原始元素进行高保真等值面重建,在此基础上,我们结合了来自Grendel-GS的多GPU训练后端,以实现大数据集的可扩展处理。通过在各GPU之间进行优化分配,我们的方法提高了训练吞吐量,并支持超过单个GPU容量的高分辨率重建。在我们的实验中,该系统在Kingsnake数据集(400万高斯)上使用四个GPU达到了5.6倍的单GPU基准测试速度提升,并成功训练了Miranda数据集(18亿高斯),这在单个A100 GPU上是不可完成的任务。这项工作为将3D-GS集成到基于高性能计算的科学工作流程中奠定了基础,能够实现复杂模拟的实时事后和现场可视化。

论文及项目相关链接

Summary

本文介绍了对3D高斯描画(3D-GS)管道的多GPU扩展,用于科学可视化。研究团队在先前高斯原始数据的高保真等值面重建研究基础上,融入多GPU训练后端技术,该技术基于Grendel-GS改进而来,可支持大数据集的可扩展处理。通过GPU间的优化分布,该方法提高了训练吞吐量,并支持超越单GPU容量的高分辨率重建。实验表明,该系统在Kingsnake数据集上使用四个GPU相比单GPU基准测试实现了5.6倍的加速效果,并成功训练了Miranda数据集,这是一项在单个A100 GPU上无法完成的任务。该研究为将3D-GS集成到高性能计算(HPC)科学工作流中铺平了道路,实现了对复杂模拟的实时事后和实时可视化。

Key Takeaways

- 研究团队扩展了3D高斯描画(3D-GS)管道,实现了多GPU支持,用于科学可视化。

- 通过融入多GPU训练后端技术,研究提高了训练效率和分辨率重建能力。

- 多GPU分布在优化中起到了关键作用,提高了训练吞吐量。

- 实验显示,使用四个GPU相比单GPU实现了显著加速效果。

- 研究成功训练了Miranda数据集,这是单GPU无法完成的任务。

- 该研究为将3D-GS集成到高性能计算(HPC)科学工作流中提供了可能。

点此查看论文截图

GeoSplat: A Deep Dive into Geometry-Constrained Gaussian Splatting

Authors:Yangming Li, Chaoyu Liu, Lihao Liu, Simon Masnou, Carola-Bibian Schönlieb

A few recent works explored incorporating geometric priors to regularize the optimization of Gaussian splatting, further improving its performance. However, those early studies mainly focused on the use of low-order geometric priors (e.g., normal vector), and they are also unreliably estimated by noise-sensitive methods, like local principal component analysis. To address their limitations, we first present GeoSplat, a general geometry-constrained optimization framework that exploits both first-order and second-order geometric quantities to improve the entire training pipeline of Gaussian splatting, including Gaussian initialization, gradient update, and densification. As an example, we initialize the scales of 3D Gaussian primitives in terms of principal curvatures, leading to a better coverage of the object surface than random initialization. Secondly, based on certain geometric structures (e.g., local manifold), we introduce efficient and noise-robust estimation methods that provide dynamic geometric priors for our framework. We conduct extensive experiments on multiple datasets for novel view synthesis, showing that our framework: GeoSplat, significantly improves the performance of Gaussian splatting and outperforms previous baselines.

最近有一些研究尝试将几何先验知识融入高斯拼贴的优化过程中,以进一步改善其性能。然而,早期的研究主要集中在低阶几何先验的应用上(例如法向量),这些先验知识主要是通过局部主成分分析等对噪声敏感的方法估算出来的,但估计的准确性并不高。为了解决这些问题,我们首先提出了GeoSplat,这是一个通用的几何约束优化框架,它利用一阶和二阶几何量来提高高斯拼贴的整个训练流程,包括高斯初始化、梯度更新和稠密化。例如,我们根据主曲率初始化3D高斯基元的尺度,相较于随机初始化,这能更好地覆盖物体表面。其次,基于某些几何结构(如局部流形),我们引入了高效且对噪声鲁棒的估计方法,为我们的框架提供动态几何先验。我们在多个数据集上进行了关于新型视图合成的广泛实验,结果表明我们的框架GeoSplat能显著提高高斯拼贴的性能,并超越了先前的基线。

论文及项目相关链接

Summary

近期研究尝试将几何先验知识引入高斯涂抹的优化过程中以提高其性能。然而,早期研究主要关注低阶几何先验知识的应用,且通过噪声敏感的方法(如局部主成分分析)进行估计存在不可靠的问题。为解决这些问题,我们提出GeoSplat,一个利用一阶和二阶几何量的通用几何约束优化框架,以改进高斯涂抹的整个训练流程,包括高斯初始化、梯度更新和密集化。通过基于主曲率的3D高斯原始尺度初始化,实现比随机初始化更好的对象表面覆盖。此外,基于某些几何结构(如局部流形),我们引入高效且抗噪声的估计方法,为我们的框架提供动态几何先验。实验表明,GeoSplat显著提高了高斯涂抹的性能并超越了之前的基线。

Key Takeaways

- 近期研究尝试将几何先验知识融入高斯涂抹的优化,以提高其性能。

- 早期研究主要关注低阶几何先验的应用,存在估计不可靠的问题。

- GeoSplat框架利用一阶和二阶几何量改进高斯涂抹的训练流程。

- 主曲率用于初始化3D高斯原始尺度,实现更好的对象表面覆盖。

- 基于某些几何结构,引入高效且抗噪声的估计方法。

- GeoSplat框架显著提高高斯涂抹性能。

点此查看论文截图

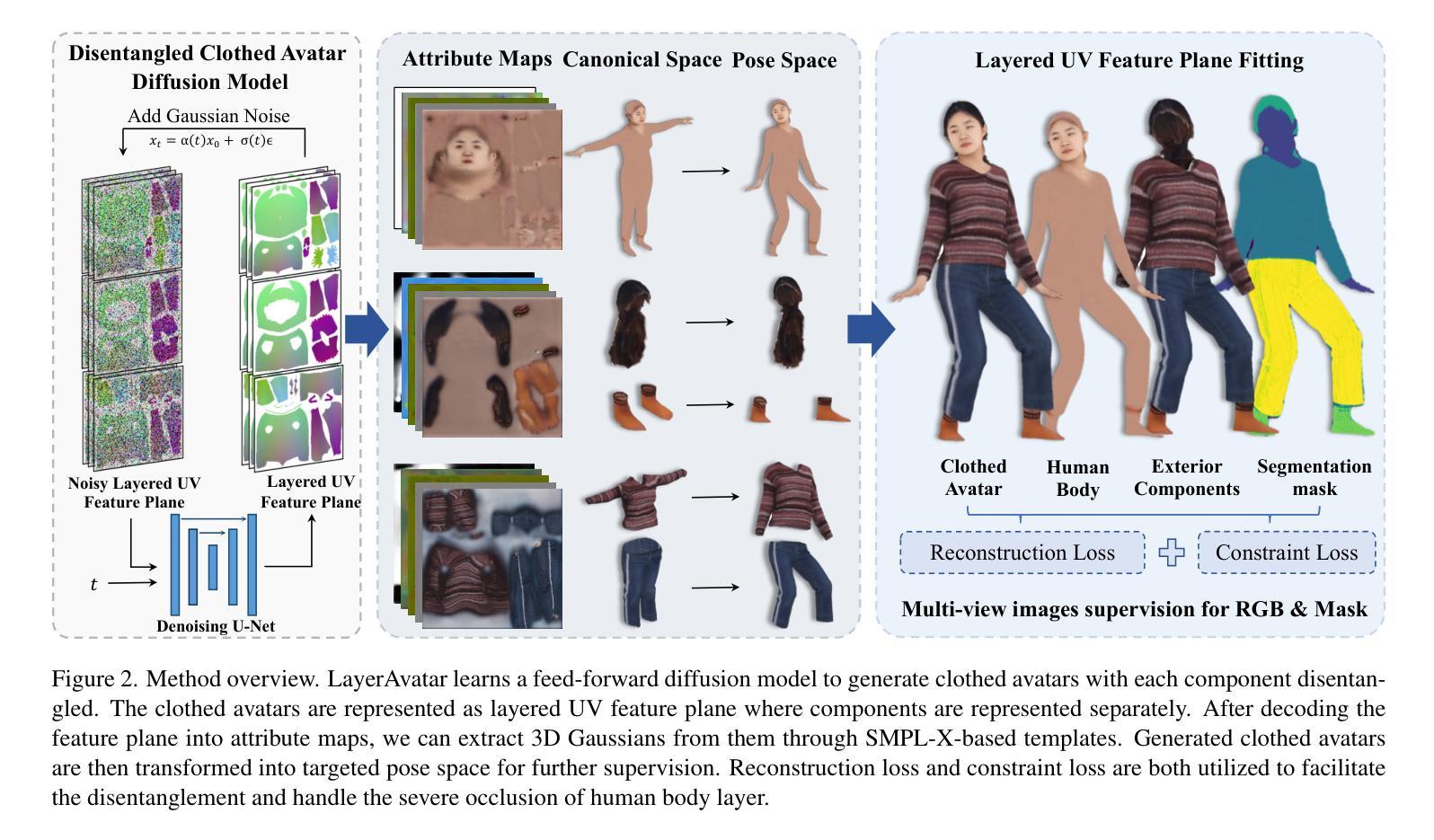

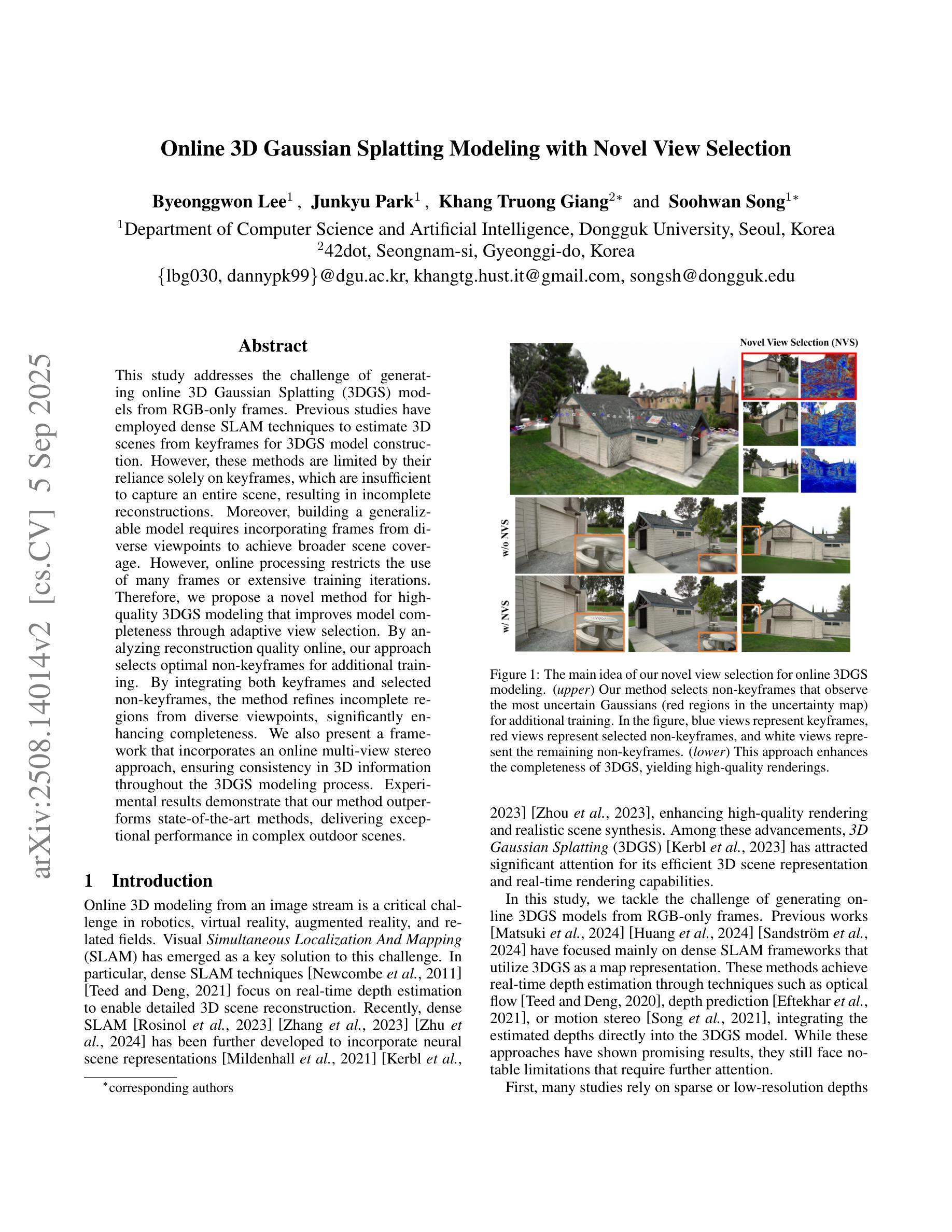

Online 3D Gaussian Splatting Modeling with Novel View Selection

Authors:Byeonggwon Lee, Junkyu Park, Khang Truong Giang, Soohwan Song

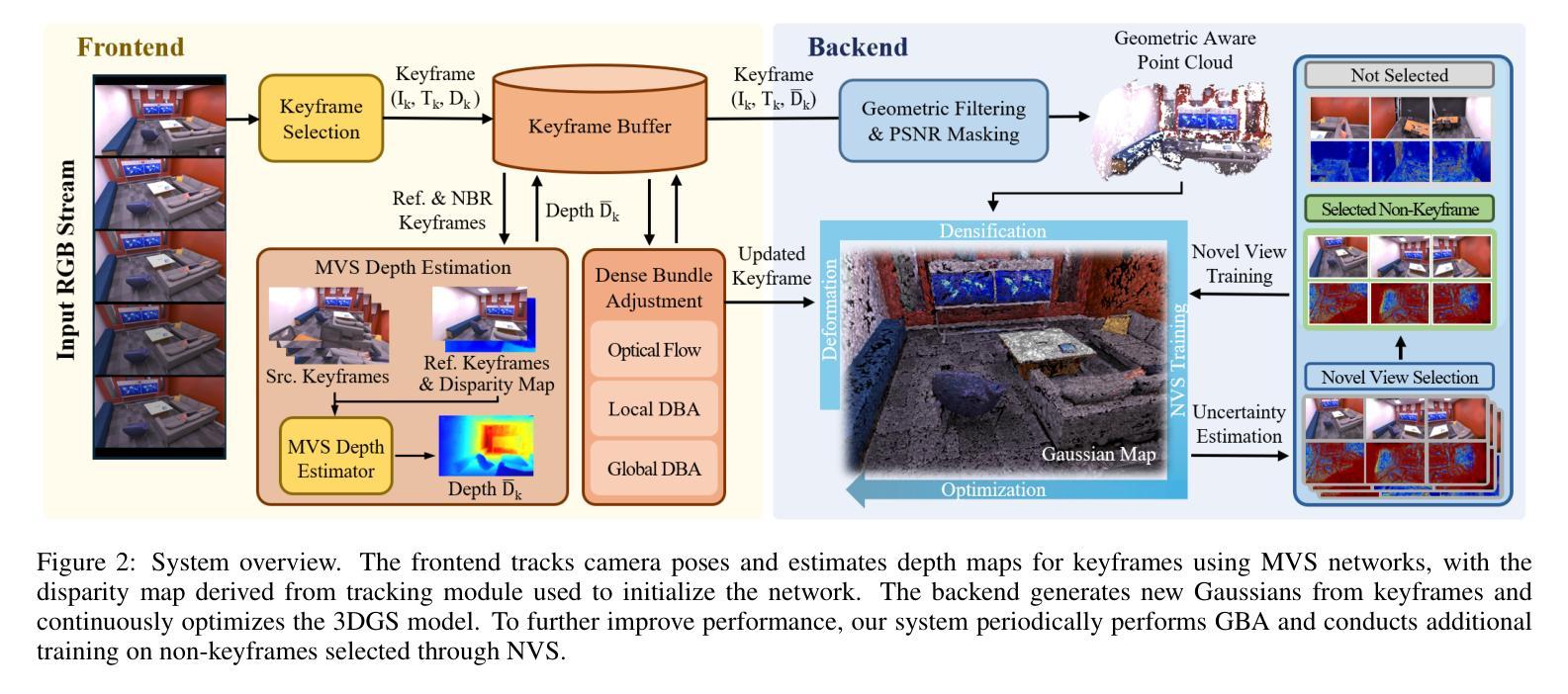

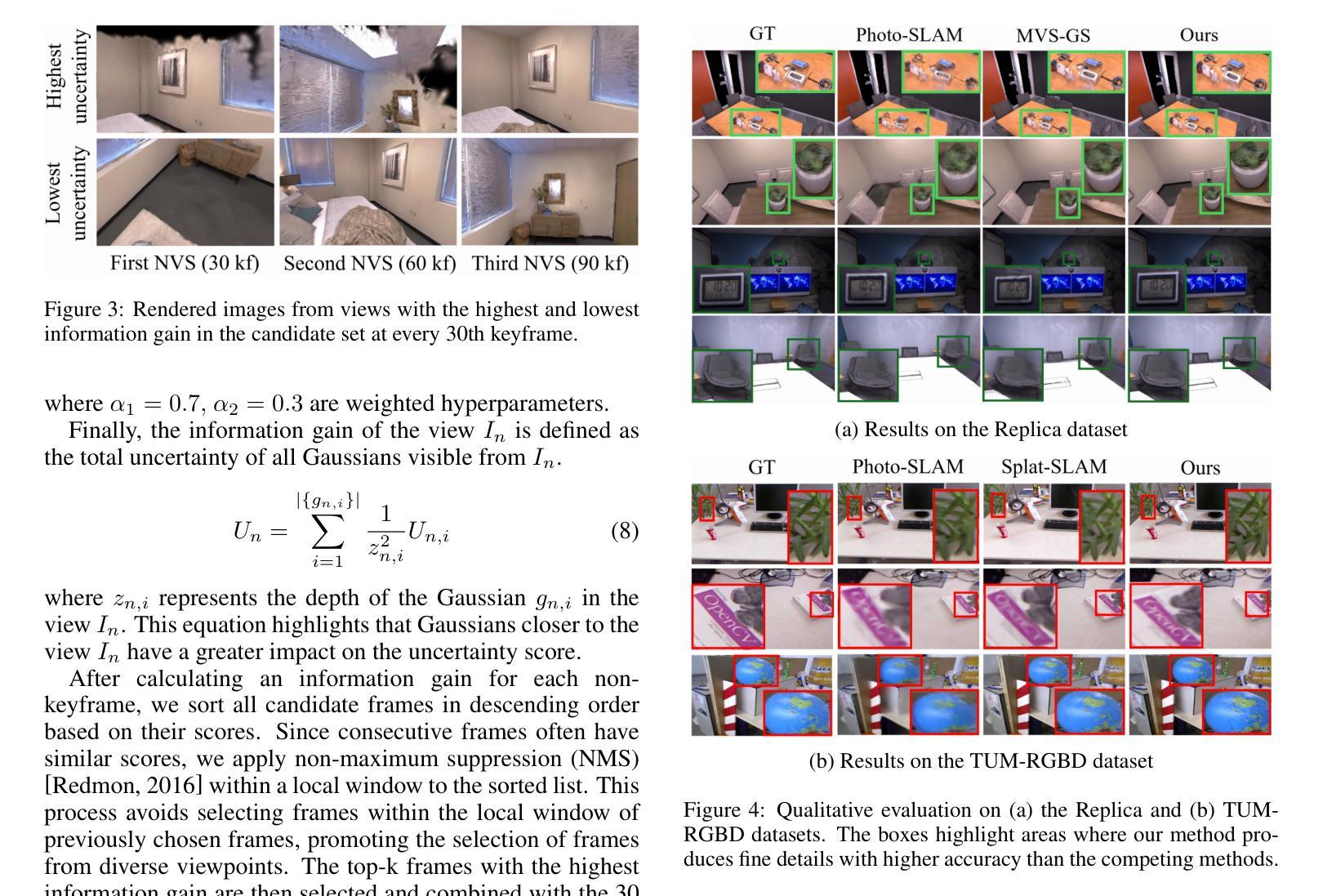

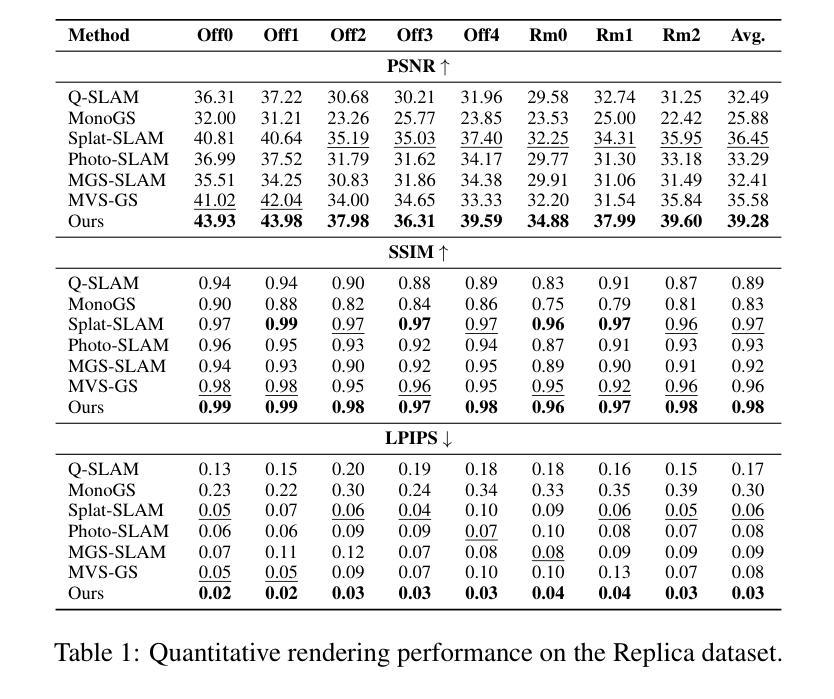

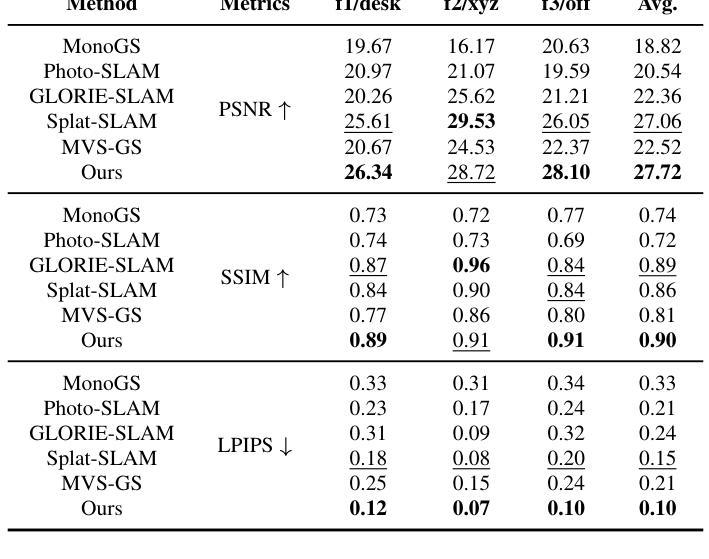

This study addresses the challenge of generating online 3D Gaussian Splatting (3DGS) models from RGB-only frames. Previous studies have employed dense SLAM techniques to estimate 3D scenes from keyframes for 3DGS model construction. However, these methods are limited by their reliance solely on keyframes, which are insufficient to capture an entire scene, resulting in incomplete reconstructions. Moreover, building a generalizable model requires incorporating frames from diverse viewpoints to achieve broader scene coverage. However, online processing restricts the use of many frames or extensive training iterations. Therefore, we propose a novel method for high-quality 3DGS modeling that improves model completeness through adaptive view selection. By analyzing reconstruction quality online, our approach selects optimal non-keyframes for additional training. By integrating both keyframes and selected non-keyframes, the method refines incomplete regions from diverse viewpoints, significantly enhancing completeness. We also present a framework that incorporates an online multi-view stereo approach, ensuring consistency in 3D information throughout the 3DGS modeling process. Experimental results demonstrate that our method outperforms state-of-the-art methods, delivering exceptional performance in complex outdoor scenes.

本研究旨在应对从仅RGB帧生成在线3D高斯融合(3DGS)模型的挑战。先前的研究已经采用密集SLAM技术,从关键帧估计3D场景以进行3DGS模型构建。然而,这些方法仅依赖于关键帧,存在无法捕捉整个场景的局限性,导致重建不完整。此外,为了建立通用模型,需要从不同的视角融入帧以实现更广泛的场景覆盖。然而,在线处理限制了使用许多帧或大量的训练迭代。因此,我们提出了一种新型的高质量3DGS建模方法,通过自适应视角选择来提高模型的完整性。通过在线分析重建质量,我们的方法会选择最佳的非关键帧进行额外的训练。通过融合关键帧和所选的非关键帧,该方法从不同视角对不完整区域进行细化,从而显著提高完整性。我们还提出了一个框架,融入在线多视角立体技术,确保在整个3DGS建模过程中保持一致的3D信息。实验结果表明,我们的方法优于最先进的方法,在复杂的户外场景中表现出卓越的性能。

论文及项目相关链接

摘要

本文研究了仅通过RGB帧在线生成三维高斯喷涂模型(3DGS)的挑战。以前的研究采用密集SLAM技术从关键帧估计三维场景进行三维高斯喷涂模型构建。然而,这些方法仅依赖于关键帧,无法捕获整个场景,导致重建不完整。此外,构建通用模型需要纳入不同视角的帧以实现更广泛的场景覆盖。然而,在线处理限制了许多帧或大量训练迭代的使用。因此,我们提出了一种高质量的三维高斯喷涂建模新方法,通过自适应视角选择提高模型完整性。该方法通过在线分析重建质量,选择最佳的非关键帧进行额外训练。通过结合关键帧和所选的非关键帧,该方法从多个角度细化不完整区域,从而显着提高模型的完整性。我们还提出了一个框架,采用在线多视图立体法,确保在整个三维高斯喷涂建模过程中三维信息的一致性。实验结果表明,我们的方法优于现有技术,在复杂的户外场景中表现出卓越的性能。

要点总结

- 该研究针对仅通过RGB帧在线生成三维高斯喷涂模型(3DGS)的挑战进行了深入探讨。

- 现有方法主要依赖关键帧进行三维场景估计,导致模型构建不完整。

- 提出了一种新的高质量三维高斯喷涂建模方法,通过自适应视角选择来提高模型完整性。

- 该方法结合关键帧和选择的非关键帧,从多个角度细化不完整区域,从而提高模型的完整性。

- 引入了一个在线多视图立体法框架,确保在整个建模过程中三维信息的一致性。

点此查看论文截图

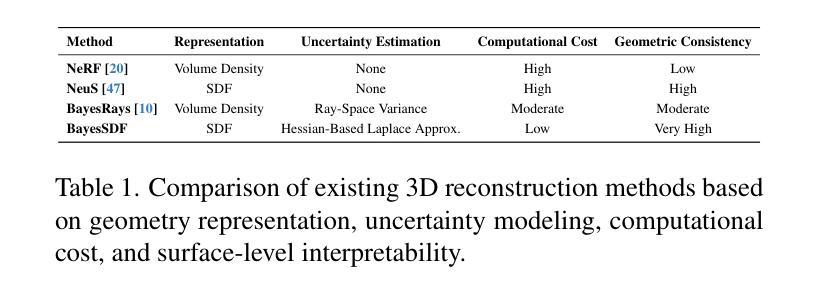

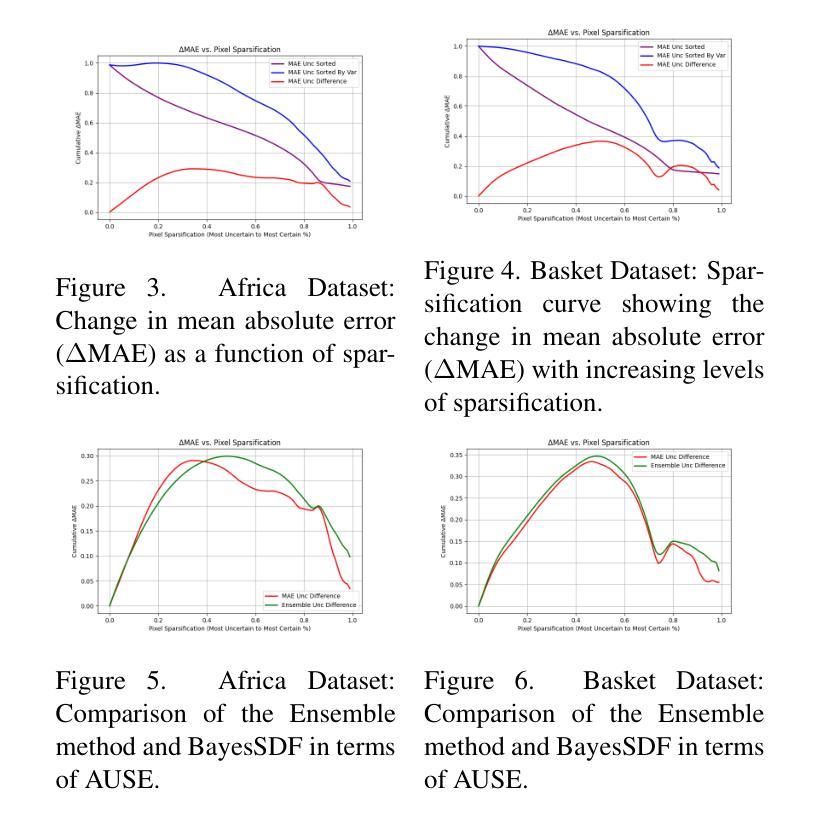

BayesSDF: Surface-Based Laplacian Uncertainty Estimation for 3D Geometry with Neural Signed Distance Fields

Authors:Rushil Desai

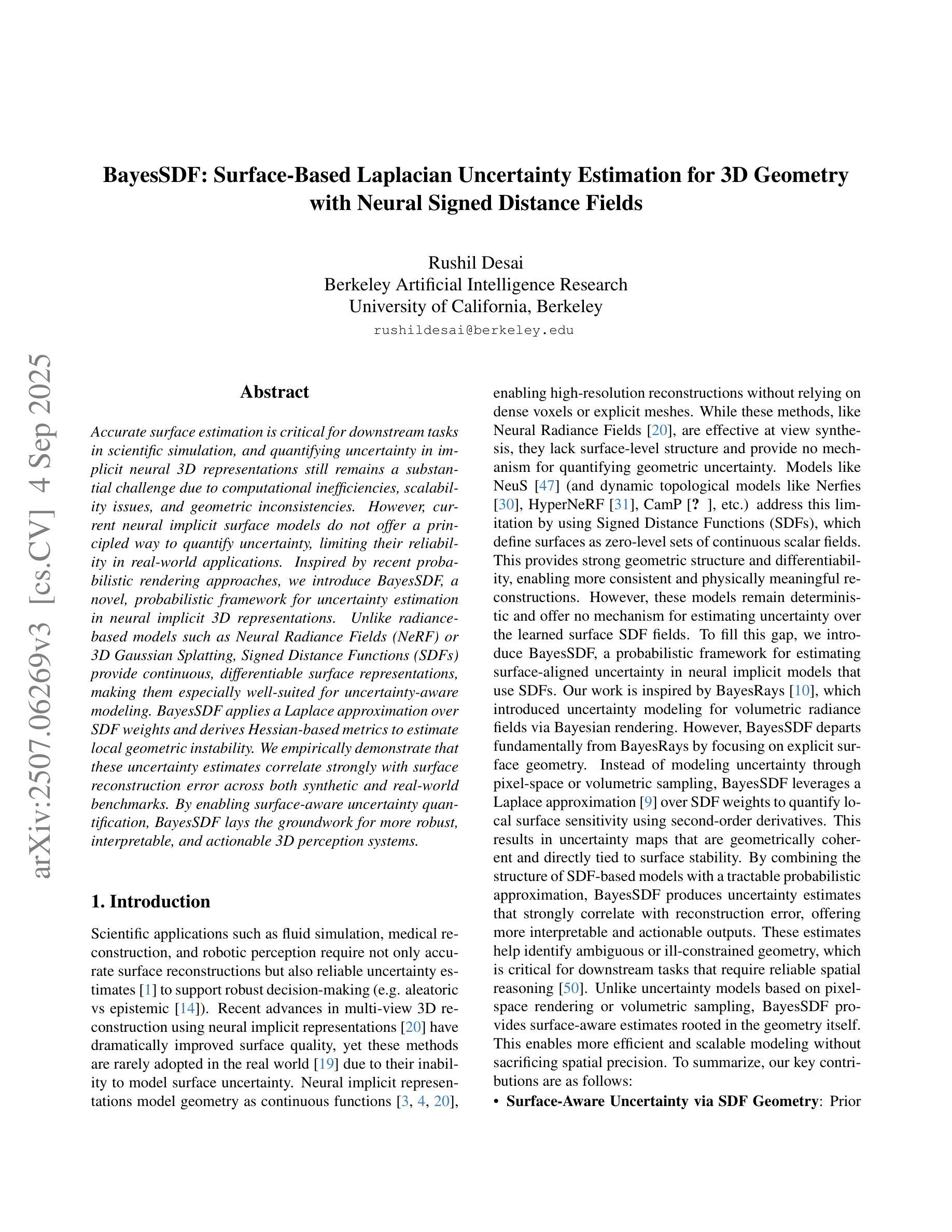

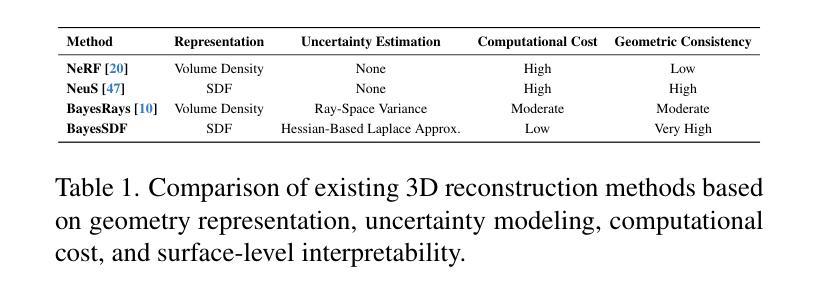

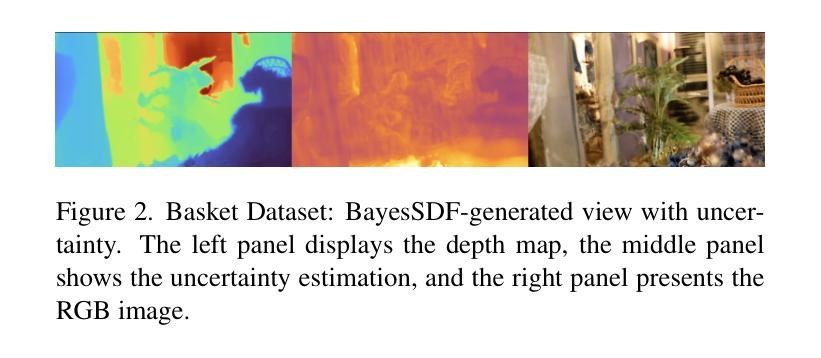

Accurate surface estimation is critical for downstream tasks in scientific simulation, and quantifying uncertainty in implicit neural 3D representations still remains a substantial challenge due to computational inefficiencies, scalability issues, and geometric inconsistencies. However, current neural implicit surface models do not offer a principled way to quantify uncertainty, limiting their reliability in real-world applications. Inspired by recent probabilistic rendering approaches, we introduce BayesSDF, a novel probabilistic framework for uncertainty estimation in neural implicit 3D representations. Unlike radiance-based models such as Neural Radiance Fields (NeRF) or 3D Gaussian Splatting, Signed Distance Functions (SDFs) provide continuous, differentiable surface representations, making them especially well-suited for uncertainty-aware modeling. BayesSDF applies a Laplace approximation over SDF weights and derives Hessian-based metrics to estimate local geometric instability. We empirically demonstrate that these uncertainty estimates correlate strongly with surface reconstruction error across both synthetic and real-world benchmarks. By enabling surface-aware uncertainty quantification, BayesSDF lays the groundwork for more robust, interpretable, and actionable 3D perception systems.

精确的曲面估计是科学模拟中后续任务的关键,而由于计算效率低下、可扩展性问题以及几何不一致性,在隐式神经三维表示中量化不确定性仍然是一个巨大的挑战。然而,当前的神经隐式表面模型并没有提供一种原则性的方法来量化不确定性,这限制了它们在现实世界应用中的可靠性。受最新概率渲染方法的启发,我们引入了BayesSDF,这是一种用于神经隐式三维表示中不确定性估计的新型概率框架。与基于辐射率的模型(如神经辐射场(NeRF)或三维高斯喷涂)不同,符号距离函数(SDF)提供了连续、可微分的表面表示,使其特别适合进行感知不确定性的建模。BayesSDF对SDF权重应用Laplace近似,并推导基于Hessian的度量来估计局部几何不稳定性。我们通过实证证明,这些不确定性估计与合成和真实世界基准测试中的表面重建误差高度相关。通过实现表面感知的不确定性量化,BayesSDF为更稳健、可解释和可操作的3D感知系统奠定了基础。

论文及项目相关链接

PDF ICCV 2025 Workshops (11 Pages, 6 Figures, 2 Tables)

Summary

本文提出了BayesSDF,一种用于神经隐式3D表示中不确定性估计的新型概率框架。该框架利用Sign Distance Functions(SDFs)连续可微的表面表示特性,通过Laplace近似对SDF权重进行估计,并使用Hessian基度量评估局部几何不稳定性。实验表明,这些不确定性估计与合成和真实世界基准的表面重建误差高度相关,为更稳健、可解释和可操作的3D感知系统奠定了基础。

Key Takeaways

- 神经隐式表面模型的不确定性估计在科研模拟中的下游任务中是至关重要的。

- 当前神经隐式表面模型缺乏量化不确定性的原则性方法,限制了其在真实世界应用中的可靠性。

- BayesSDF是一个新型的概率框架,用于神经隐式3D表示中的不确定性估计。

- Signed Distance Functions(SDFs)为不确定性感知建模提供了尤其适合的连续、可微分的表面表示。

- BayesSDF利用Laplace近似对SDF权重进行估计,并使用Hessian基度量评估局部几何不稳定性。

- 实验显示,BayesSDF的不确定性估计与合成和真实世界基准的表面重建误差高度相关。

点此查看论文截图

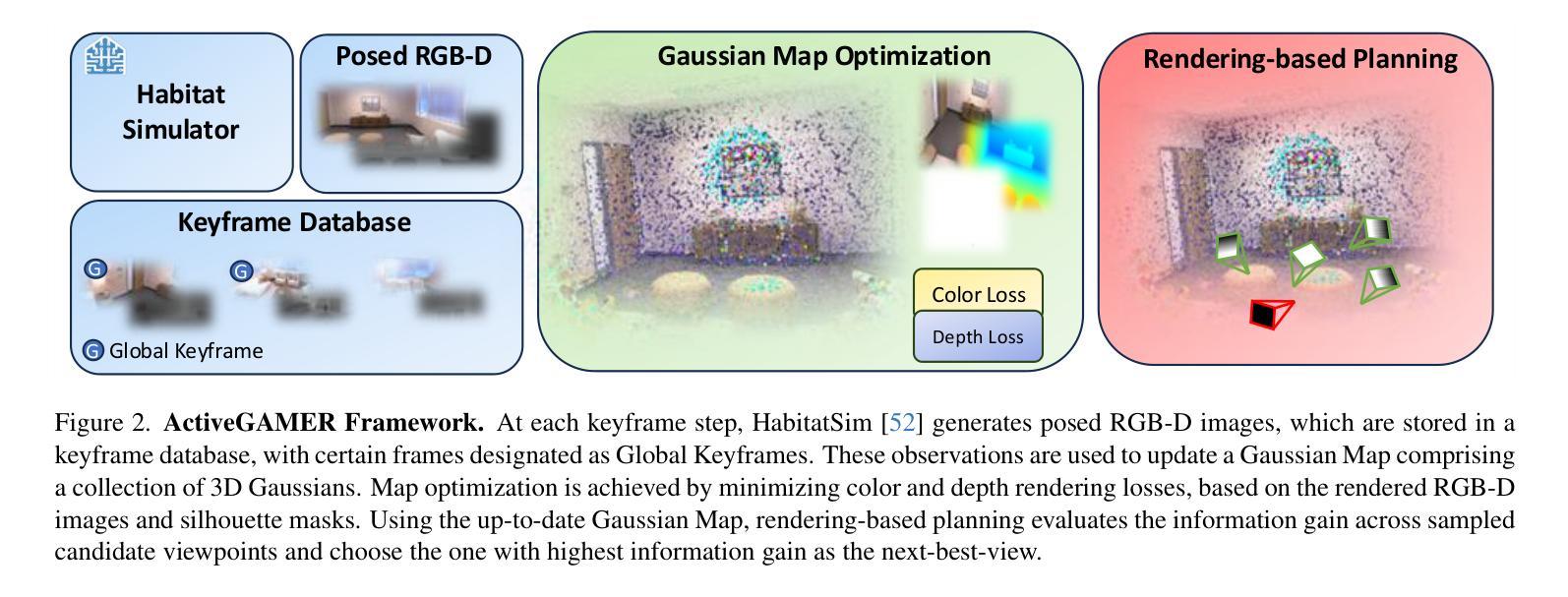

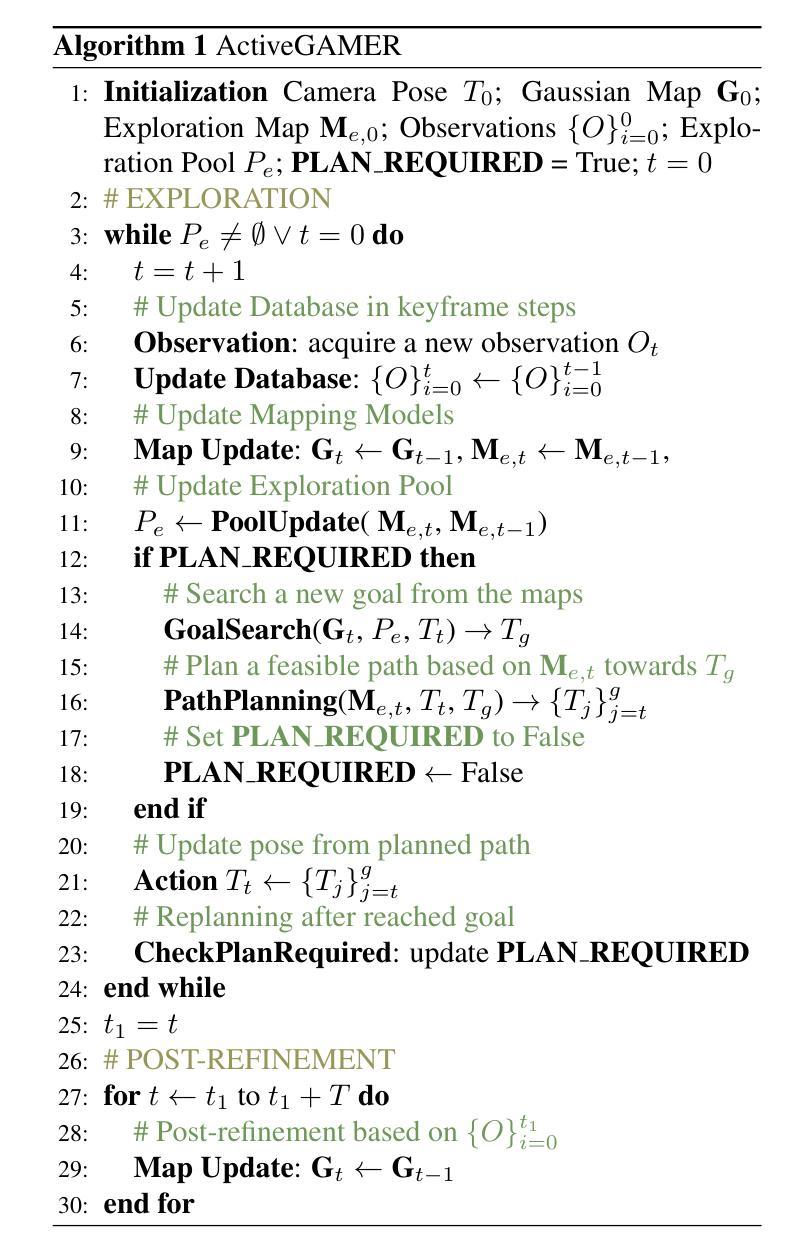

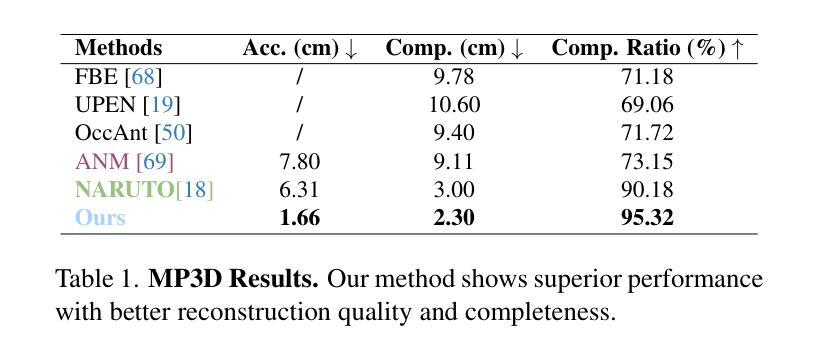

ActiveGAMER: Active GAussian Mapping through Efficient Rendering

Authors:Liyan Chen, Huangying Zhan, Kevin Chen, Xiangyu Xu, Qingan Yan, Changjiang Cai, Yi Xu

We introduce ActiveGAMER, an active mapping system that utilizes 3D Gaussian Splatting (3DGS) to achieve high-quality, real-time scene mapping and exploration. Unlike traditional NeRF-based methods, which are computationally demanding and restrict active mapping performance, our approach leverages the efficient rendering capabilities of 3DGS, allowing effective and efficient exploration in complex environments. The core of our system is a rendering-based information gain module that dynamically identifies the most informative viewpoints for next-best-view planning, enhancing both geometric and photometric reconstruction accuracy. ActiveGAMER also integrates a carefully balanced framework, combining coarse-to-fine exploration, post-refinement, and a global-local keyframe selection strategy to maximize reconstruction completeness and fidelity. Our system autonomously explores and reconstructs environments with state-of-the-art geometric and photometric accuracy and completeness, significantly surpassing existing approaches in both aspects. Extensive evaluations on benchmark datasets such as Replica and MP3D highlight ActiveGAMER’s effectiveness in active mapping tasks.

我们介绍了ActiveGAMER,这是一个利用3D高斯拼贴(3DGS)实现高质量、实时场景映射和探测的主动映射系统。与传统的基于NeRF的方法不同,后者计算量大,限制了主动映射的性能,我们的方法利用3DGS的高效渲染能力,能够在复杂环境中实现有效且高效的探测。我们的系统的核心是基于渲染的信息增益模块,该模块能动态地识别出下一个最佳视角点的信息量最大的视点,从而提高几何和光度重建的准确性。ActiveGAMER还整合了一个精心设计的框架,结合了由粗到细的探测、后期优化以及全局局部关键帧选择策略,以最大化重建的完整性和保真度。我们的系统以最先进的几何和光度准确性和完整性自主探索和重建环境,并在两个方面都超越了现有方法。在Replica和MP3D等基准数据集上的广泛评估凸显了ActiveGAMER在主动映射任务中的有效性。

论文及项目相关链接

PDF Accepted to CVPR2025. Project page: https://oppo-us-research.github.io/ActiveGAMER-website/. Code: https://github.com/oppo-us-research/ActiveGAMER

Summary

ActiveGAMER是一种利用3D高斯映射技术(3DGS)实现高质量实时场景映射和自主探索的主动映射系统。其核心是高效渲染技术的信息增益模块,能动态识别最具信息量的视角进行最佳视点规划,提高几何和光度重建的准确性。该系统整合粗到细探索、后期优化及全局-局部关键帧选择策略,以最大化重建的完整性和保真度。ActiveGAMER在几何和光度准确性和完整性方面达到业界领先,并在基准数据集上表现超越现有方法。

Key Takeaways

- ActiveGAMER系统引入了一种基于3D高斯映射技术(3DGS)的主动映射方法,实现高质量实时场景映射和自主探索。

- 该系统利用高效渲染技术,通过信息增益模块动态识别最具信息量的视角,提高几何和光度重建的准确性。

- ActiveGAMER整合了粗到细探索、后期优化及全局-局部关键帧选择策略,以优化重建的完整性和保真度。

- 系统具有自主探索和重建的能力,达到业界领先的几何和光度准确性和完整性。

- ActiveGAMER显著超越了现有方法在主动映射任务上的表现。

- 基准数据集如Replica和MP3D的广泛评估证明了ActiveGAMER的有效性。

- 该系统特别适用于复杂环境的探索和重建。

点此查看论文截图

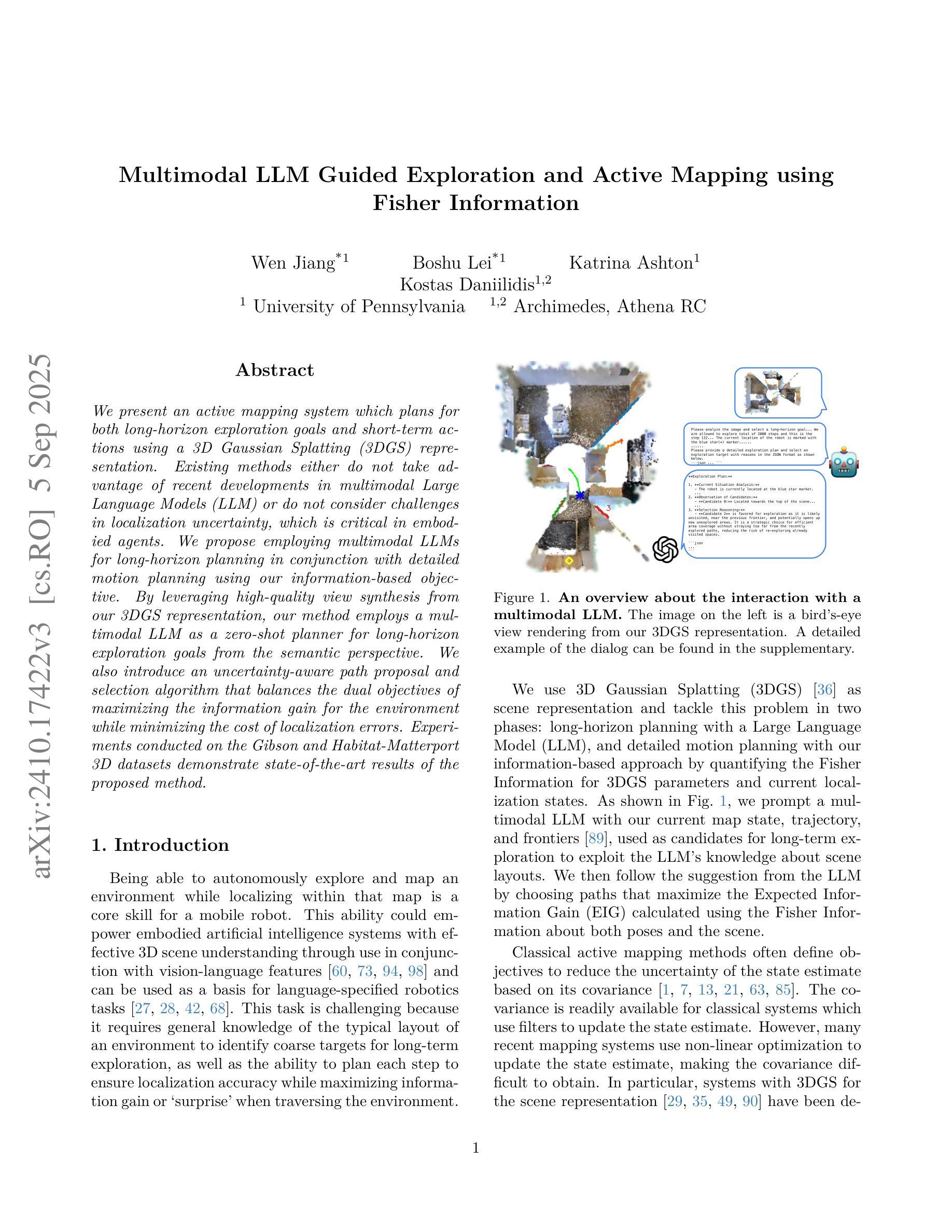

Multimodal LLM Guided Exploration and Active Mapping using Fisher Information

Authors:Wen Jiang, Boshu Lei, Katrina Ashton, Kostas Daniilidis

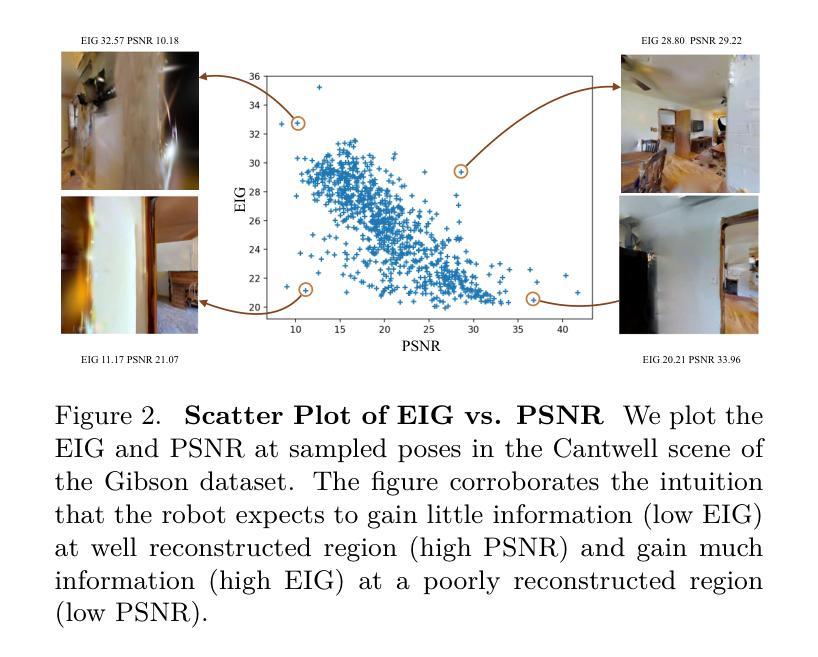

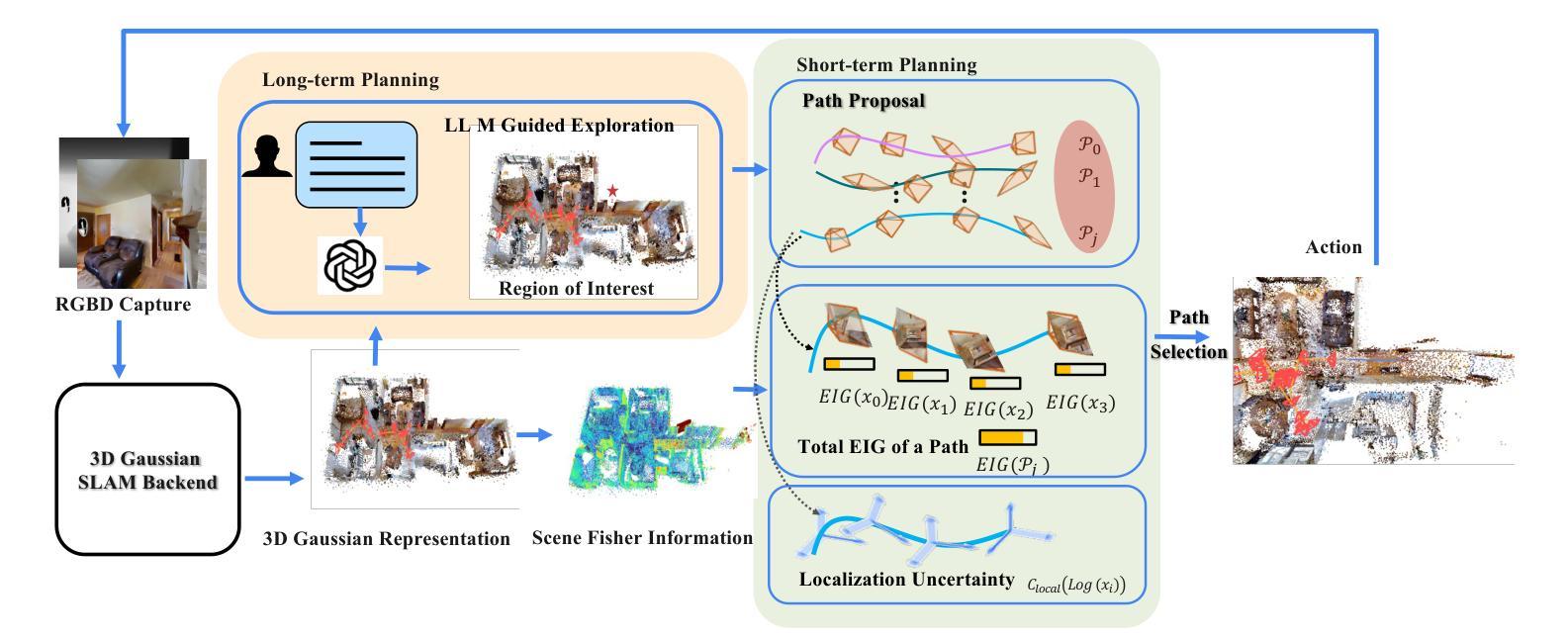

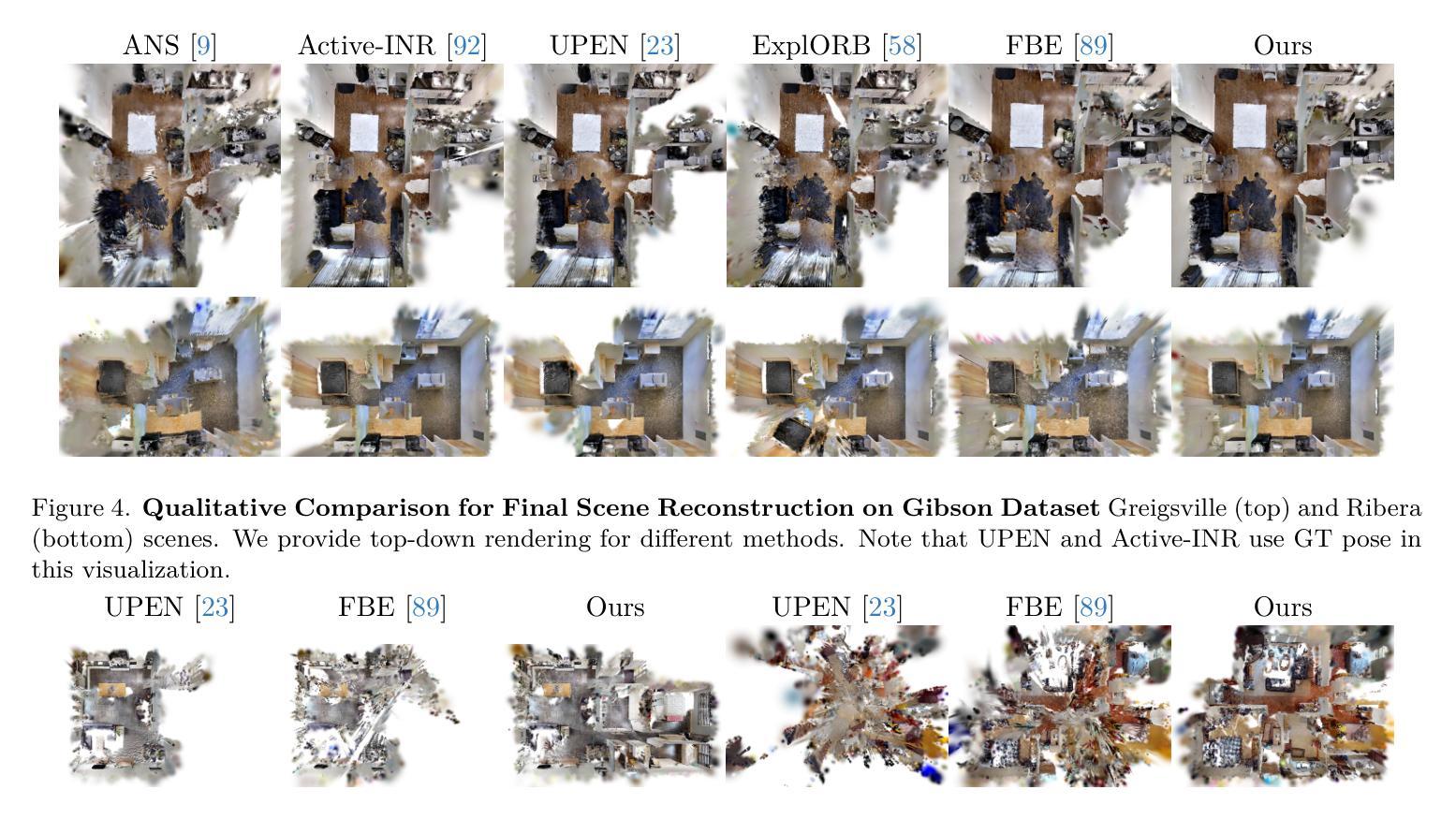

We present an active mapping system that plans for both long-horizon exploration goals and short-term actions using a 3D Gaussian Splatting (3DGS) representation. Existing methods either do not take advantage of recent developments in multimodal Large Language Models (LLM) or do not consider challenges in localization uncertainty, which is critical in embodied agents. We propose employing multimodal LLMs for long-horizon planning in conjunction with detailed motion planning using our information-based objective. By leveraging high-quality view synthesis from our 3DGS representation, our method employs a multimodal LLM as a zero-shot planner for long-horizon exploration goals from the semantic perspective. We also introduce an uncertainty-aware path proposal and selection algorithm that balances the dual objectives of maximizing the information gain for the environment while minimizing the cost of localization errors. Experiments conducted on the Gibson and Habitat-Matterport 3D datasets demonstrate state-of-the-art results of the proposed method.

我们提出了一种主动映射系统,该系统利用三维高斯融合(3DGS)表示法,为长期探索目标和短期行动制定计划。现有方法要么没有利用最近的多模态大型语言模型(LLM)的发展成果,要么没有考虑到定位不确定性的挑战,这在实体代理中至关重要。我们提出将多模态LLM用于长期规划,并结合我们的信息目标进行详细的运动规划。通过利用我们的3DGS表示法的高质量视图合成,我们的方法采用多模态LLM作为零样本规划器,从语义角度为长期探索目标制定计划。我们还引入了一种感知不确定性的路径提议和选择算法,该算法平衡了最大化环境信息增益和最小化定位错误成本这两个目标。在Gibson和Habitat-Matterport 3D数据集上进行的实验证明了所提出方法的最新成果。

论文及项目相关链接

PDF ICCV 2025

Summary

本文介绍了一种使用3D高斯扩展(3DGS)表示的主动映射系统,该系统既能进行长期探索目标的规划,又能进行短期行动的规划。该系统结合了多模态大型语言模型(LLM)和信息基础目标进行长期规划和详细运动规划,并采用多模态LLM进行基于语义的长期探索目标零样本规划。此外,系统还引入了一种不确定性感知路径提议和选择算法,旨在平衡最大化环境信息增益和最小化定位误差成本的目标。在Gibson和Habitat-Matterport 3D数据集上的实验证明了该方法的先进性能。

Key Takeaways

- 系统采用3D高斯扩展(3DGS)表示进行主动映射,支持长期和短期规划。

- 结合多模态大型语言模型(LLM)进行长期规划,与信息基础目标结合进行详细运动规划。

- 利用多模态LLM实现基于语义的长期探索目标零样本规划。

- 引入不确定性感知路径提议和选择算法,旨在平衡环境信息增益和定位误差成本。

- 系统考虑到了定位不确定性的挑战。

- 实验在Gibson和Habitat-Matterport 3D数据集上展开,证明了系统的先进性能。

点此查看论文截图