⚠️ 以下所有内容总结都来自于 大语言模型的能力,如有错误,仅供参考,谨慎使用

🔴 请注意:千万不要用于严肃的学术场景,只能用于论文阅读前的初筛!

💗 如果您觉得我们的项目对您有帮助 ChatPaperFree ,还请您给我们一些鼓励!⭐️ HuggingFace免费体验

2025-10-01 更新

SIE3D: Single-image Expressive 3D Avatar generation via Semantic Embedding and Perceptual Expression Loss

Authors:Zhiqi Huang, Dulongkai Cui, Jinglu Hu

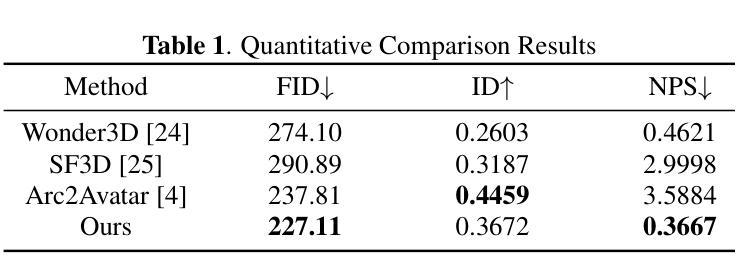

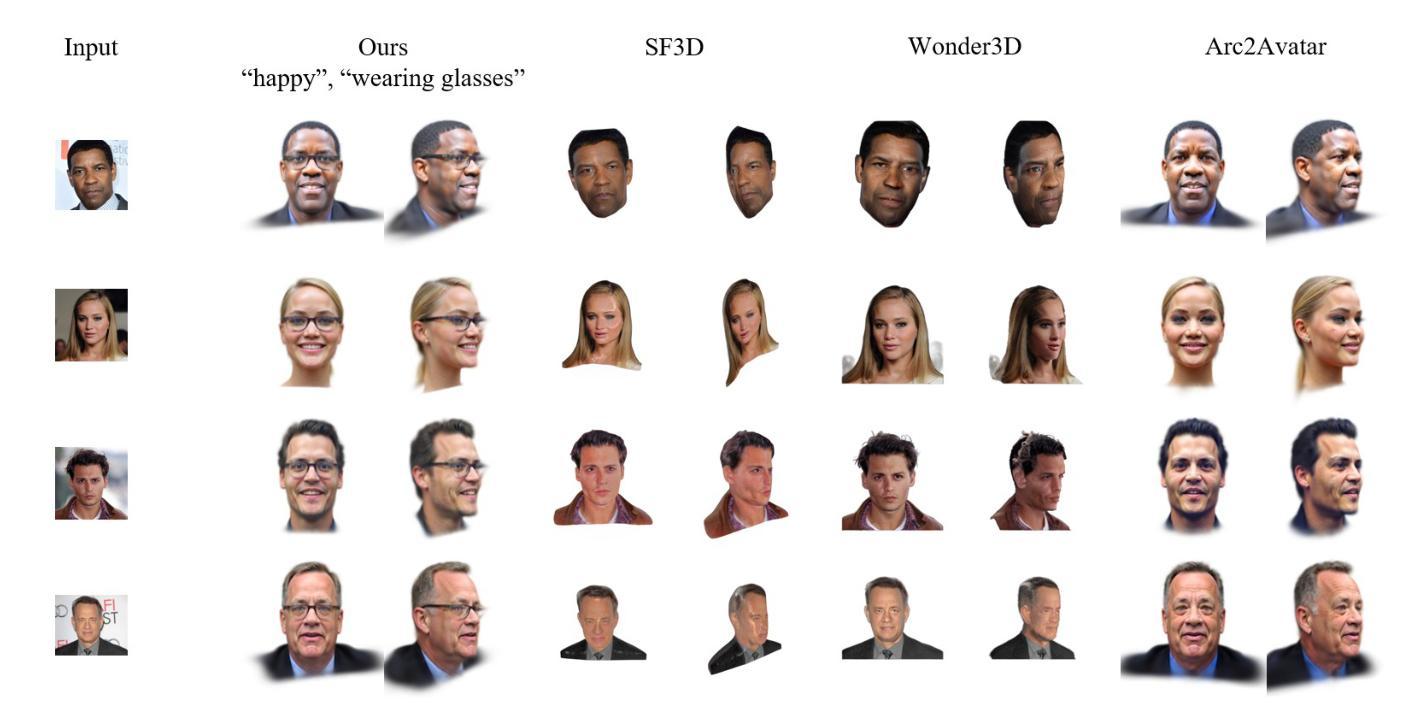

Generating high-fidelity 3D head avatars from a single image is challenging, as current methods lack fine-grained, intuitive control over expressions via text. This paper proposes SIE3D, a framework that generates expressive 3D avatars from a single image and descriptive text. SIE3D fuses identity features from the image with semantic embedding from text through a novel conditioning scheme, enabling detailed control. To ensure generated expressions accurately match the text, it introduces an innovative perceptual expression loss function. This loss uses a pre-trained expression classifier to regularize the generation process, guaranteeing expression accuracy. Extensive experiments show SIE3D significantly improves controllability and realism, outperforming competitive methods in identity preservation and expression fidelity on a single consumer-grade GPU. Project page: https://blazingcrystal1747.github.io/SIE3D/

从单张图像生成高保真3D头像是一项具有挑战性的任务,因为当前的方法缺乏通过文本对表情进行细致、直观的控制。本文提出了SIE3D框架,该框架能够从单张图像和描述性文本生成表现力丰富的3D头像。SIE3D通过一种新的条件方案,将图像中的身份特征与文本中的语义嵌入相结合,实现了对表情的精细控制。为了确保生成的表达式与文本相匹配,它引入了一种创新的感觉表情损失函数。这种损失使用预训练的表情分类器来规范生成过程,保证表情的准确性。大量实验表明,SIE3D在可控性和逼真度方面有了显著的提升,并在单一消费者级GPU上实现了身份保留和表情保真方面的超越竞争对手的表现。项目页面:https://blazingcrystal1747.github.io/SIE3D/

论文及项目相关链接

PDF This work has been submitted to the IEEE for possible publication

Summary

本文提出了一种名为SIE3D的框架,能够从单一图像和描述文本生成具有表情的三维头像。通过创新的条件方案,SIE3D将图像中的身份特征与文本中的语义嵌入相融合,实现了对表情的详细控制。为确保生成的表情与文本相符,引入了一种新型的感知表情损失函数,通过预训练的表情分类器规范生成过程,保证表情的准确性。实验表明,SIE3D在可控性和真实性方面显著提高,在单一消费级GPU上实现了身份保留和表情忠实度方面的超越。

Key Takeaways

- SIE3D框架能够从单一图像和描述文本生成具有表情的三维头像。

- 通过创新的条件方案融合图像身份特征和文本语义嵌入,实现表情的详细控制。

- 引入感知表情损失函数,确保生成的表情与文本描述相符。

- 使用预训练的表情分类器规范生成过程,保证表情准确性。

- 大量实验证明,SIE3D在可控性和真实性方面显著提高。

- SIE3D在身份保留和表情忠实度方面超越了其他方法。

点此查看论文截图

PERSE: Personalized 3D Generative Avatars from A Single Portrait

Authors:Hyunsoo Cha, Inhee Lee, Hanbyul Joo

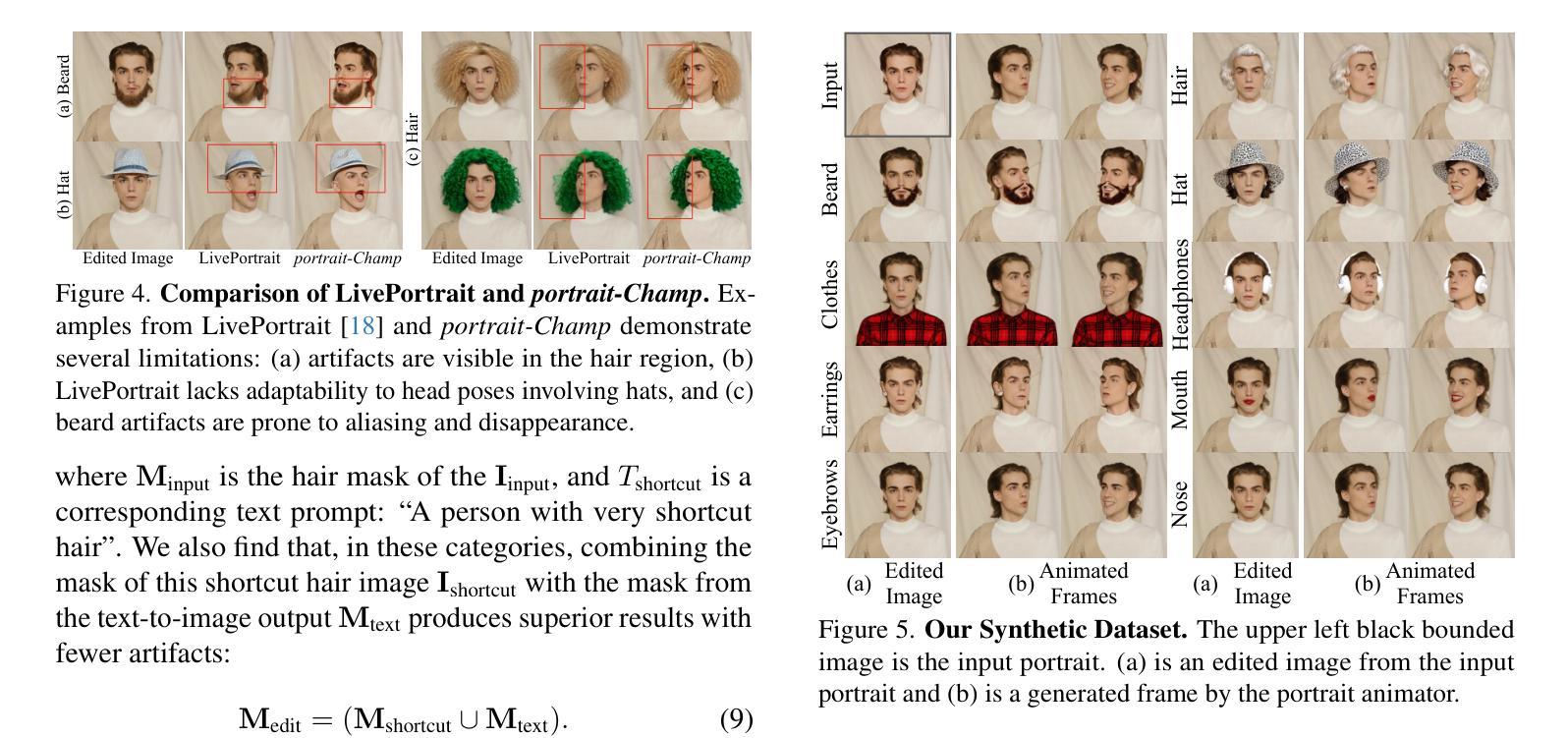

We present PERSE, a method for building a personalized 3D generative avatar from a reference portrait. Our avatar enables facial attribute editing in a continuous and disentangled latent space to control each facial attribute, while preserving the individual’s identity. To achieve this, our method begins by synthesizing large-scale synthetic 2D video datasets, where each video contains consistent changes in facial expression and viewpoint, along with variations in a specific facial attribute from the original input. We propose a novel pipeline to produce high-quality, photorealistic 2D videos with facial attribute editing. Leveraging this synthetic attribute dataset, we present a personalized avatar creation method based on 3D Gaussian Splatting, learning a continuous and disentangled latent space for intuitive facial attribute manipulation. To enforce smooth transitions in this latent space, we introduce a latent space regularization technique by using interpolated 2D faces as supervision. Compared to previous approaches, we demonstrate that PERSE generates high-quality avatars with interpolated attributes while preserving the identity of the reference individual.

我们提出了PERSE方法,一种从参考肖像构建个性化3D生成化身的方法。我们的化身在一个连续且分离的特征空间中实现了面部特征的编辑,可以控制每个面部特征,同时保留个人的身份特征。为了实现这一点,我们的方法首先合成大规模合成二维视频数据集,每个视频都包含面部表情和视角的一致变化,以及来自原始输入的特定面部特征的变化。我们提出了一种新的流程来生成高质量、逼真的二维视频,带有面部特征编辑功能。利用这个合成特征数据集,我们提出了一种基于3D高斯贴图的个性化化身创建方法,学习一个用于直观面部特征操作的连续且分离的特征空间。为了在这个特征空间中实现平滑过渡,我们引入了特征空间正则化技术,使用插值二维面部作为监督。与以前的方法相比,我们证明PERSE在生成具有插值特征的化身时,能够保留参考个人的身份特征。

论文及项目相关链接

PDF Accepted to CVPR 2025, Project Page: https://hyunsoocha.github.io/perse/

Summary

基于参考肖像,我们提出了一种构建个性化3D生成化身的方法PERSE。该方法能够在连续的、分离的特征空间中编辑面部特征,同时保持个人身份。通过合成大规模合成二维视频数据集,我们在其中模拟了面部表情、视角以及特定面部特征的持续变化。基于此数据集,我们提出了基于个性化化身创建方法的3D高斯拼接技术,学习直观面部特征操纵的连续性和分离性特征空间。通过采用插值二维面部作为监督,我们在特征空间中实现了平滑过渡。与以前的方法相比,PERSE生成的化身质量高,属性插值,同时保持了参考个体的身份。

Key Takeaways

- PERSE方法能够构建个性化3D生成化身。

- 面部特征可以在连续的、分离的特征空间中进行编辑。

- 通过合成大规模二维视频数据集模拟面部表情和视角变化。

- 利用3D高斯拼接技术创建个性化化身。

- 学习了直观面部特征操纵的连续性和分离性特征空间。

- 通过插值二维面部实现特征空间中的平滑过渡。

- PERSE生成的化身质量高,属性插值,同时保持参考个体身份。

点此查看论文截图